![[심층분석] 코드 제안을 넘어서: Block의 오픈소스 AI 에이전트 Goose가 그리는 개발자 자동화의 미래](/newsimg/HTsBPfyGJ8cTU2YA.jpg)

들어가며 — AI가 '제안'이 아니라 '실행'하는 시대

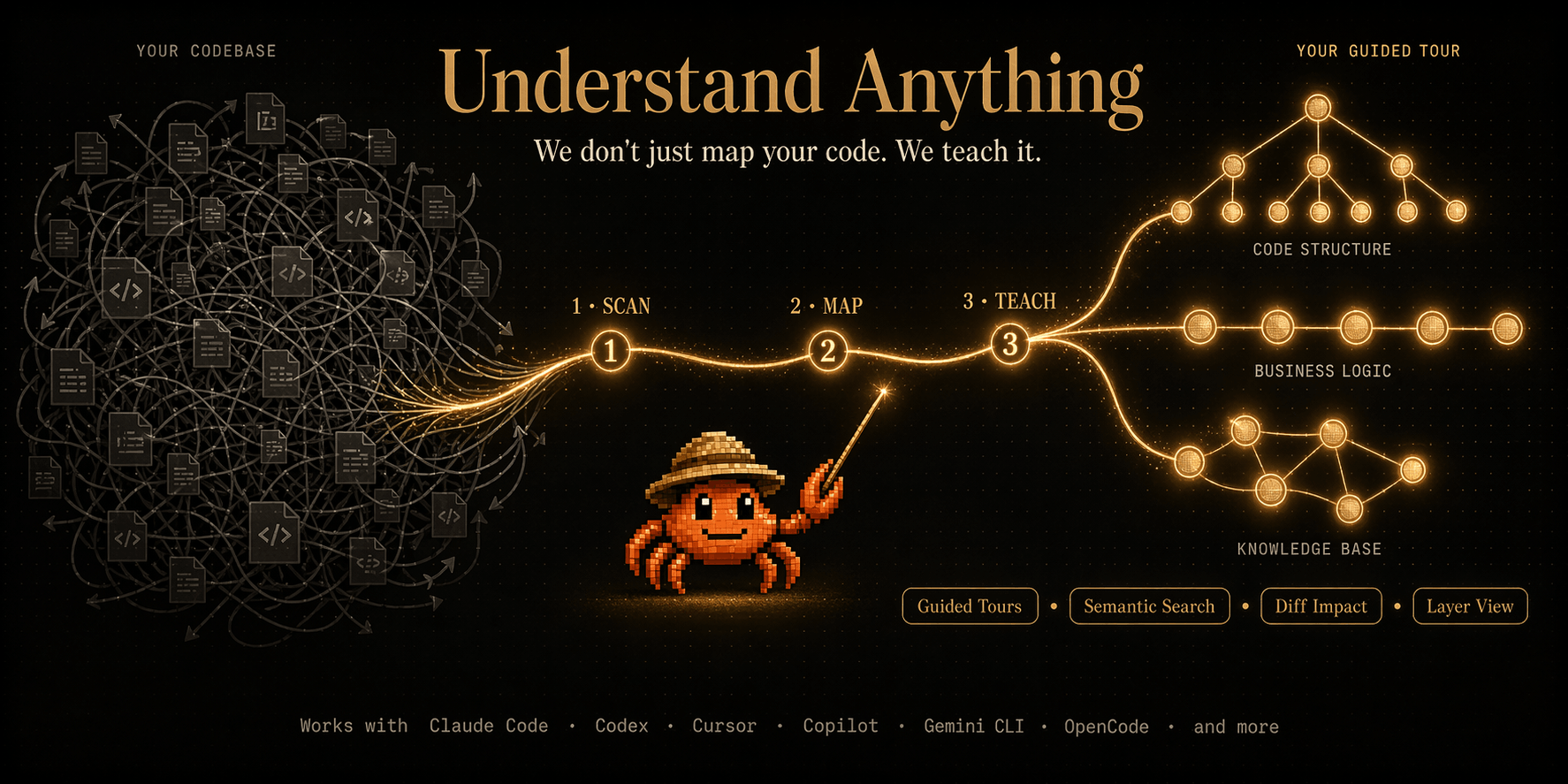

AI 코딩 도구 하면 어떤 게 떠오르시나요? GitHub Copilot처럼 코드를 자동완성해주는 도구, 아니면 ChatGPT에 코드를 물어보는 것 정도가 대부분일 거예요. 그런데 최근 개발자 도구 생태계에서는 한 단계 더 나아간 움직임이 뚜렷해지고 있어요. 단순히 "이 코드 이렇게 써볼래?"라고 제안하는 수준이 아니라, AI가 직접 프로젝트를 만들고, 코드를 실행하고, 테스트까지 돌려주는 에이전트(Agent) 방식이 부상하고 있거든요.

오늘 소개할 Goose는 바로 이 흐름의 한가운데에 있는 프로젝트예요. 핀테크 기업 Block(구 Square)이 오픈소스로 공개한 Goose는 GitHub에서 35,000개 이상의 스타를 받으며 개발자 커뮤니티의 큰 관심을 받고 있는데요, 단순한 코딩 어시스턴트가 아니라 내 컴퓨터에서 돌아가는 자율형 AI 에이전트를 표방하고 있어요.

"에이전트"라는 단어가 요즘 워낙 많이 쓰여서 좀 식상하게 느껴질 수도 있는데, Goose가 주목받는 이유는 명확해요. 어떤 LLM이든 연결할 수 있고, MCP 서버와 통합되며, 데스크톱 앱과 CLI 둘 다 지원한다는 점에서 개발자의 실제 워크플로우에 녹아드는 설계를 했기 때문이에요. 이게 왜 중요한지, 그리고 기존 도구들과 뭐가 다른지 하나씩 뜯어볼게요.

Goose란 무엇인가 — 코딩을 넘어선 AI 에이전트

기본 개념

Goose를 한 마디로 정의하면 "내 컴퓨터에서 돌아가는 로컬 AI 에이전트"예요. 여기서 "로컬"이라는 게 핵심인데요, 클라우드 기반 서비스와 달리 여러분의 코드가 외부 서버로 전송되지 않아요. AI가 여러분의 컴퓨터 환경 위에서 직접 작업을 수행하는 거죠.

"에이전트"라는 개념이 좀 생소할 수 있는데, 쉽게 말해서 이런 거예요. 기존 AI 코딩 도구가 통역사라면, AI 에이전트는 인턴 개발자에 가까워요. 통역사는 여러분이 말하면 번역만 해주지만, 인턴은 "이 기능 만들어줘"라고 하면 직접 파일을 만들고, 코드를 짜고, 실행해보고, 에러가 나면 고치기까지 하잖아요. Goose가 바로 그런 역할을 해요.

핵심 기능 살펴보기

Goose가 할 수 있는 일들을 구체적으로 살펴보면:

- 프로젝트 생성: "React로 투두 앱 만들어줘"라고 하면 프로젝트 구조부터 코드까지 통째로 생성해요

- 코드 실행: 작성한 코드를 직접 돌려보고 결과를 확인해요

- 디버깅: 에러가 나면 로그를 분석하고 원인을 찾아서 수정해요

- 테스트 작성 및 실행: 테스트 코드를 만들고 돌려서 통과 여부까지 확인해요

- 외부 API 연동: 필요하면 외부 서비스의 API를 호출해서 데이터를 가져오거나 작업을 수행해요

- 워크플로우 오케스트레이션: 여러 단계의 작업을 순서대로 자동 수행해요

기술 아키텍처 — Goose의 속을 들여다보면

Rust 기반의 견고한 설계

Goose는 Rust로 작성되어 있어요. Rust는 성능과 안전성 모두를 잡은 프로그래밍 언어인데, 최근 시스템 프로그래밍 분야에서 C/C++의 대안으로 각광받고 있죠. AI 에이전트 도구를 Rust로 만들었다는 건, 단순 프로토타입이 아니라 프로덕션급 품질을 목표로 한다는 뜻이에요.

프로젝트 구조를 보면 crates/라는 디렉토리 아래 여러 크레이트(Rust의 패키지 단위)로 나뉘어 있고, Cargo.toml로 관리되는 전형적인 Rust 워크스페이스 구조를 따르고 있어요. 4,000개가 넘는 커밋 히스토리는 이 프로젝트가 상당히 활발하게 개발되고 있다는 걸 보여주죠.

LLM 독립적 아키텍처

Goose의 가장 큰 기술적 특징 중 하나는 특정 LLM에 종속되지 않는 설계예요. 이게 뭐냐면, OpenAI의 GPT만 쓸 수 있는 게 아니라 Anthropic의 Claude, Google의 Gemini, Meta의 Llama 등 어떤 LLM이든 연결해서 사용할 수 있다는 거예요.

이걸 비유로 설명하면, 보통 AI 도구는 특정 브랜드의 배터리만 넣을 수 있는 리모컨 같아요. 그런데 Goose는 범용 배터리 소켓이 달려있어서 어떤 배터리든 끼울 수 있는 리모컨인 거죠. 심지어 멀티 모델 구성(multi-model configuration)도 지원하는데, 이건 작업 종류에 따라 다른 LLM을 쓸 수 있다는 뜻이에요. 예를 들어 코드 생성은 비싸지만 똑똑한 Claude에게 맡기고, 단순 파일 정리는 저렴한 모델에게 시키는 식으로 비용과 성능을 최적화할 수 있어요.

MCP 서버 통합 — 진짜 확장성의 비밀

여기서 MCP(Model Context Protocol)가 등장해요. MCP는 요즘 AI 도구 생태계에서 가장 뜨거운 키워드 중 하나인데요, 쉽게 말하면 AI가 외부 도구나 서비스와 대화할 수 있는 표준 규약이에요.

비유를 들어볼게요. USB가 나오기 전에는 프린터 케이블, 마우스 케이블, 키보드 케이블이 전부 달랐잖아요. USB가 등장하면서 하나의 포트로 모든 기기를 연결할 수 있게 됐죠. MCP가 AI 세계에서 바로 그 USB 같은 역할을 해요. Goose는 이 MCP를 적극적으로 지원하기 때문에, 다양한 외부 서비스(GitHub, Slack, 데이터베이스, CI/CD 도구 등)와 쉽게 연결할 수 있어요.

이게 실무에서 어떤 의미냐면, Goose에게 "GitHub에서 이슈 목록 가져와서 가장 급한 버그부터 수정해줘"라고 하면, MCP를 통해 GitHub API에 접근하고, 이슈를 분석하고, 코드를 수정하는 일련의 과정을 자동으로 수행할 수 있다는 거예요.

데스크톱 앱 + CLI 이중 인터페이스

프로젝트 구조를 보면 ui/ 디렉토리가 있는데, 이건 데스크톱 앱을 위한 코드예요. Goose는 터미널에서 CLI(명령줄 인터페이스)로 쓸 수도 있고, GUI(그래픽 인터페이스) 데스크톱 앱으로도 쓸 수 있어요. 터미널이 편한 시니어 개발자는 CLI로, 시각적 인터페이스를 선호하는 분들은 데스크톱 앱으로 쓰면 되는 거죠. 사용자 선택의 폭을 넓힌 좋은 설계라고 볼 수 있어요.

경쟁 기술 비교 — Goose vs. Cursor vs. Claude Code vs. Devin

요즘 AI 코딩 에이전트 시장이 정말 뜨거운데요, Goose와 비슷한 포지션에 있는 도구들을 비교해볼게요.

Cursor

Cursor는 VS Code를 포크한 AI 통합 코드 에디터예요. 에디터 안에서 AI가 코드를 제안하고 수정하는 방식이죠. Goose와의 가장 큰 차이는, Cursor는 에디터에 묶여 있다는 점이에요. 코드 편집에는 강력하지만, 에디터 밖의 작업(서버 관리, 배포, 외부 API 호출 등)에는 제한이 있어요.

비유하자면, Cursor는 최고급 연필이에요. 글씨 쓰기(코딩)에는 뛰어나지만, 그 연필로 전화를 걸 순 없잖아요. 반면 Goose는 스마트폰에 가까워요. 글도 쓰고, 전화도 하고, 앱도 실행하는 범용 도구인 거죠.

Claude Code (Anthropic)

Claude Code는 Anthropic이 만든 CLI 기반 AI 코딩 에이전트예요. Goose와 가장 유사한 포지션인데, 핵심 차이는 LLM 선택의 자유도에 있어요. Claude Code는 당연히 Claude 모델만 사용할 수 있지만, Goose는 어떤 LLM이든 연결 가능하죠. 특정 모델에 종속되고 싶지 않은 개발자에게 Goose가 매력적인 이유예요.

다만 Claude Code는 Anthropic이 직접 만든 만큼, Claude 모델과의 궁합이 최적화되어 있다는 장점이 있어요. 모든 것에 뛰어난 만능 도구 vs. 한 가지를 극도로 잘하는 전문 도구의 차이라고 볼 수 있죠.

Devin (Cognition)

Devin은 "세계 최초의 AI 소프트웨어 엔지니어"를 표방하면서 등장해 큰 화제를 모았어요. Goose와의 차이는 로컬 vs. 클라우드에 있어요. Devin은 클라우드에서 독립된 환경을 구성해서 작업하는 반면, Goose는 내 컴퓨터에서 직접 돌아가요.

이건 꽤 중요한 차이인데요, 로컬에서 돌아간다는 건 내 코드가 외부로 나가지 않는다는 뜻이기도 하거든요. 보안에 민감한 기업 환경에서는 이 점이 큰 장점이 될 수 있어요. 반면 Devin은 클라우드 환경 덕분에 더 무거운 작업(대규모 빌드, 복잡한 테스트 환경 구성 등)을 처리할 수 있다는 장점이 있고요.

GitHub Copilot Agent Mode

GitHub Copilot도 최근 에이전트 모드를 도입했는데요, Goose와의 차이는 독립성이에요. Copilot Agent는 GitHub 생태계 안에서 작동하는 반면, Goose는 특정 플랫폼에 종속되지 않아요. MCP를 통해 GitHub뿐 아니라 GitLab, Bitbucket 등 어디든 연결할 수 있죠.

| 특성 | Goose | Cursor | Claude Code | Devin |

|------|-------|--------|-------------|-------|

| 오픈소스 | ✅ | ❌ | ❌ | ❌ |

| LLM 선택 자유 | ✅ 모든 LLM | ❌ 제한적 | ❌ Claude만 | ❌ 자체 모델 |

| 로컬 실행 | ✅ | ✅ | ✅ | ❌ 클라우드 |

| MCP 지원 | ✅ | ✅ | ✅ | ❌ |

| 에디터 독립 | ✅ | ❌ VS Code 기반 | ✅ | ✅ |

| 비용 | 무료(LLM 비용 별도) | 월 구독 | 종량제 | 월 구독 |

Block은 왜 이걸 오픈소스로 공개했을까?

Block(구 Square)은 결제 플랫폼으로 유명한 핀테크 기업이에요. 잭 도시(Jack Dorsey)가 이끄는 회사인데, AI 에이전트 도구를 왜 오픈소스로 풀었을까요?

첫째, 개발자 생태계 확보 전략이에요. Block은 Cash App, Square 등 다양한 개발자 도구를 만드는 회사인데, 개발자 커뮤니티에서의 영향력을 키우는 게 장기적으로 인재 확보와 브랜드 가치에 도움이 되거든요.

둘째, 내부 도구의 외부화예요. Goose는 원래 Block 내부에서 개발 생산성을 높이기 위해 만든 도구였을 가능성이 높아요. 이걸 오픈소스로 공개하면 외부 기여자들의 도움으로 더 빠르게 발전할 수 있고, 유지보수 비용도 분산되죠.

셋째, MCP 생태계 주도권이에요. AI 에이전트의 확장성은 결국 MCP 같은 표준 프로토콜의 보급에 달려있는데, Goose가 널리 쓰이면 Block이 이 생태계에서 유리한 위치를 차지할 수 있어요.

한국 개발자에게 주는 시사점

당장 써볼 수 있는 시나리오

1. 반복적인 보일러플레이트 코드 생성

새 프로젝트를 시작할 때 매번 비슷한 설정 파일, 프로젝트 구조, CI/CD 파이프라인을 만드느라 시간 쓰고 있다면, Goose에게 맡겨보세요. "Spring Boot 프로젝트 만들어줘. Gradle로 빌드하고, PostgreSQL 연결하고, Docker Compose 설정도 추가해줘"라고 하면 뚝딱 만들어줘요.

2. 레거시 코드 분석 및 리팩토링

"이 500줄짜리 서비스 클래스 분석해서 책임별로 분리해줘"처럼 리팩토링 작업을 맡기면, 코드를 읽고 의존성을 파악한 뒤 분리 방안을 제시하고 실제로 코드를 수정해줄 수 있어요.

3. 테스트 커버리지 확보

테스트 코드 작성이 밀려있다면, "이 모듈의 유닛 테스트 작성해줘. 엣지 케이스도 포함해서"라고 하면 테스트를 만들고 실행까지 해봐요.

도입 시 고려할 점

LLM API 비용 관리가 핵심이에요. Goose 자체는 무료지만, 연결하는 LLM의 API 비용은 별도로 나가요. 에이전트 방식은 일반 채팅보다 토큰을 훨씬 많이 소비하거든요. AI가 파일을 읽고, 실행하고, 결과를 분석하고, 다시 수정하는 과정에서 토큰이 계속 쌓이니까요. 멀티 모델 구성을 활용해서 비용 최적화하는 게 중요해요.

보안 정책 확인이 필요해요. 로컬에서 돌아간다고 해도, LLM API를 호출할 때 코드 컨텍스트가 LLM 서버로 전송될 수 있어요. 회사에서 사용하려면 보안팀과 먼저 협의하는 게 좋겠죠. 다만 로컬 모델(예: Ollama로 돌리는 Llama)을 사용하면 코드가 아예 외부로 나가지 않게 구성할 수도 있어요.

Rust 빌드 환경이 필요해요. 소스에서 직접 빌드하려면 Rust 툴체인이 필요한데, 프로젝트에서 설치 스크립트(download_cli.sh)도 제공하고 있어서 사전 빌드된 바이너리를 받으면 더 간편해요.

학습 로드맵 제안

이미 AI 코딩 도구에 관심이 있다면 이런 순서로 접근해보는 걸 추천해요:

1. 설치 및 기본 사용: 공식 Quickstart 문서를 따라 설치하고, 간단한 프로젝트 생성을 시켜보세요

2. MCP 서버 연동: GitHub MCP 서버를 연결해서 이슈 관리 자동화를 경험해보세요

3. 멀티 모델 구성: 작업별로 다른 LLM을 배정해서 비용 대비 효율을 최적화해보세요

4. 레시피(Recipe) 활용: 프로젝트의 workflow_recipes/ 디렉토리를 보면 미리 만들어진 자동화 레시피가 있어요. 이걸 참고해서 나만의 워크플로우를 만들어보세요

5. 기여(Contribute): CONTRIBUTING.md를 읽고 오픈소스에 기여해보는 것도 좋은 경험이 될 거예요

앞으로의 전망 — AI 에이전트 시대의 개막

2025년 들어 AI 코딩 도구의 흐름은 분명해지고 있어요. "제안에서 실행으로", 그리고 "단일 작업에서 워크플로우 자동화로" 진화하고 있죠. Goose는 이 흐름에서 오픈소스 + LLM 독립 + 로컬 실행이라는 독특한 포지션을 잡았어요.

특히 주목할 건, AI 에이전트 도구들이 점점 개발자의 일하는 방식 자체를 바꾸고 있다는 점이에요. 예전에는 코드를 한 줄 한 줄 직접 타이핑하는 게 개발이었다면, 앞으로는 의도를 명확하게 전달하고 AI의 작업 결과를 검증하는 것이 개발자의 핵심 역량이 될 수 있어요. 마치 직접 벽돌을 쌓던 건축가가 설계도를 그리고 시공팀을 관리하는 역할로 변화한 것처럼요.

물론 아직 갈 길은 멀어요. AI 에이전트가 복잡한 비즈니스 로직을 완벽하게 이해하기엔 한계가 있고, 보안이나 코드 품질 측면에서 사람의 검토는 여전히 필수적이에요. 하지만 반복적이고 정형화된 작업을 자동화하는 데는 이미 충분한 수준에 도달했고, 이 영역은 빠르게 확장되고 있어요.

Goose 같은 오픈소스 프로젝트가 중요한 이유는, 이 기술의 발전 방향을 소수의 기업이 독점하지 않도록 균형을 잡아주기 때문이에요. 누구나 코드를 살펴보고, 수정하고, 자기 환경에 맞게 커스터마이징할 수 있다는 건 큰 힘이에요.

여러분은 AI 코딩 에이전트를 실무에서 어떻게 활용하고 계시나요? 아직 시도해보지 않았다면, 가장 먼저 자동화하고 싶은 개발 작업은 무엇인가요? 혹시 이미 Goose나 유사한 도구를 써보신 분이 있다면, 어떤 작업에서 가장 효과적이었는지 경험을 나눠주시면 좋겠어요.

🔗 출처: GitHub

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공