AI가 코드를 짜주는 시대, 우리는 왜 아직 파이썬을 쓰고 있을까

## AI 시대에 다시 던지는 오래된 질문 요즘 코드를 짜다 보면 이상한 경험을 자주 하게 돼요. 머릿속에서 "이건 이렇게 짜야지" 하고 생각하기도 전에, AI 어시스턴트가 먼저 코드를 뱉어내는 거죠. 이런 환경이 일상이 되면서 한 가지 근본적인...

할리우드가 멈춘 자리, AI 학습 노동자가 되었다 - TV 만들던 사람들의 새 직업

## 잘 나가던 할리우드 작가가 왜 AI 데이터를 라벨링하고 있을까 요즘 미국 영상 업계에 묘한 풍경이 벌어지고 있어요. 한때 황금기 드라마의 각본을 쓰고, 다큐멘터리를 편집하고, 리얼리티 쇼를 기획하던 사람들이 지금은 노트북 앞에 앉아서 AI ...

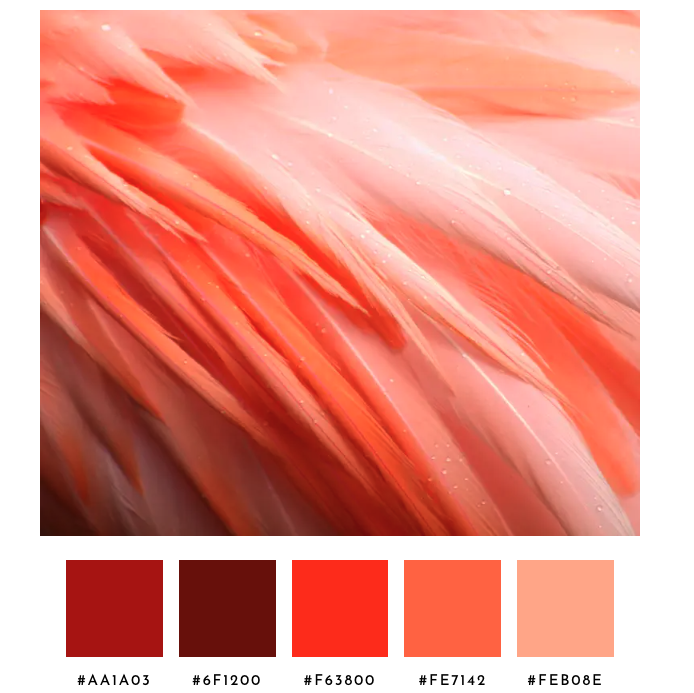

이미지에서 색상 팔레트 뽑아내기, 알고리즘 한 번 제대로 파헤쳐보자

## "이 사진 색감 너무 예쁜데, 그대로 가져다 쓰고 싶다" 디자인 작업하다 보면 한 번쯤 이런 생각 해보셨을 거예요. 어떤 사진을 보면 색감이 정말 마음에 드는데, 그 색들을 정확히 뽑아내서 내 프로젝트에 쓰고 싶다는 마음이요. Adobe C...

Rust로 만든 SQL 엔진 'Rocky' — 데이터에도 Git처럼 브랜치를 만들 수 있다면

## 코드는 브랜치 따는데, 왜 데이터는 못 따나요? 코드 작업할 때 우리는 Git에 너무 익숙해져 있잖아요. 새 기능 만들 때 브랜치 따고, 실험하고, 잘 되면 머지하고, 아니면 그냥 버리고. 그런데 데이터베이스는 어떤가요? 프로덕션 데이터를 ...

테크 뉴스를 읽는 당신,

직접 만들어볼 준비 되셨나요?

17가지 수익 모델 실습 · 144+ 강의 · 자동화 소스코드 제공

Intel Arc Pro B70, 워크스테이션 GPU 시장에 던지는 도전장

## Intel이 워크스테이션 GPU를 진지하게 들고 나왔어요 그동안 워크스테이션용 GPU 시장은 거의 NVIDIA의 RTX A/Ada 시리즈와 일부 AMD Radeon Pro가 점유해 왔어요. 게이밍 GPU와 달리 워크스테이션 GPU는 드라이버...

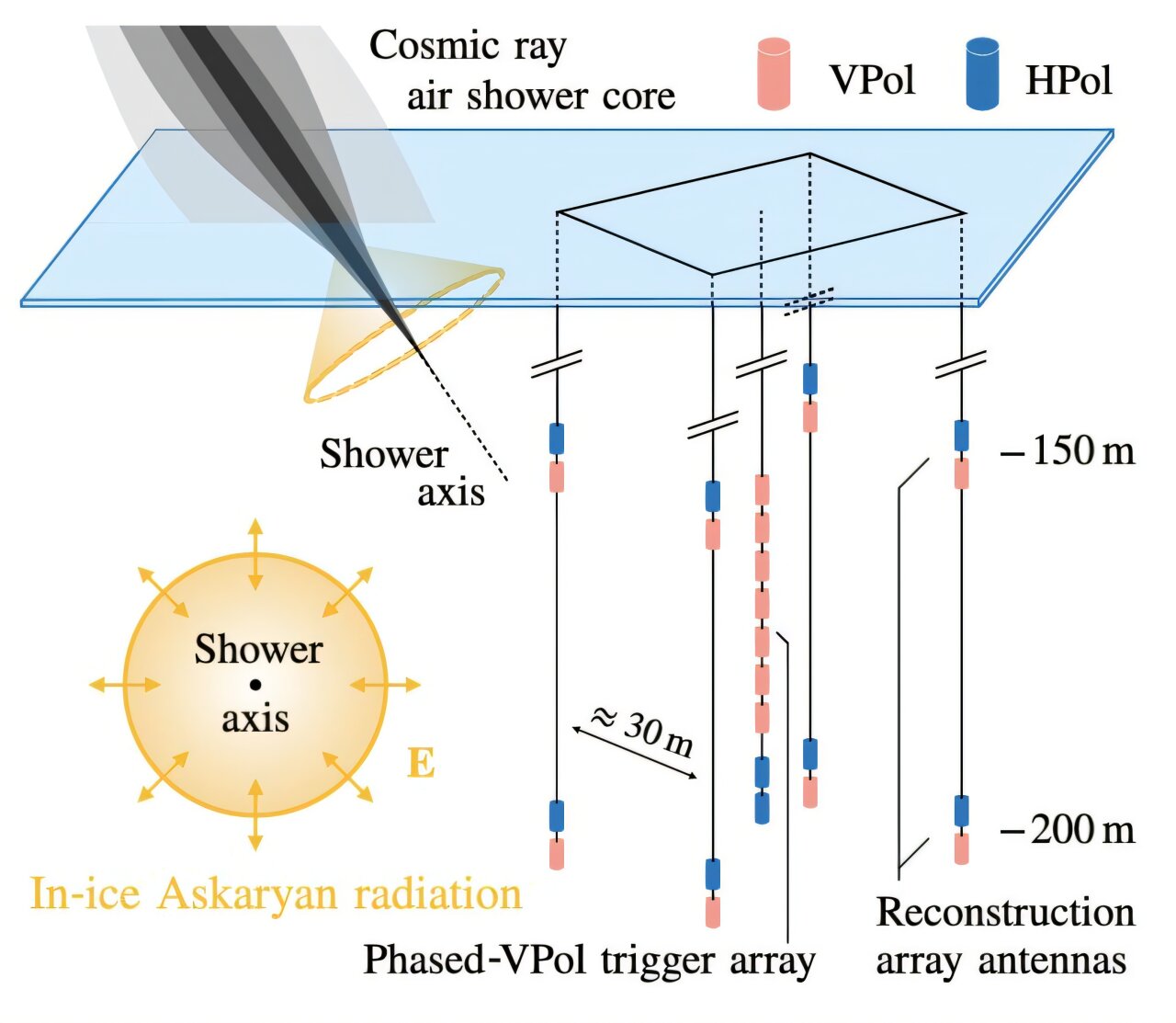

남극 얼음 속에서 잡아낸 우주의 속삭임, 타우 뉴트리노가 드디어 모습을 드러냈다

## 무슨 일이 일어난 건가요? 남극 한복판, 얼음 1세제곱킬로미터를 통째로 검출기로 만들어버린 어마어마한 실험 장치가 있어요. 바로 **IceCube 중성미자 천문대(IceCube Neutrino Observatory)** 입니다. 이름이 좀 ...

조용히 부활하는 RF 엔지니어링: 무선통신 전문가가 다시 귀해지는 이유

## 한동안 잊혀졌던 분야가 다시 떠오르고 있어요 혹시 'RF 엔지니어'라는 직군 들어보셨나요? RF는 Radio Frequency, 그러니까 라디오 주파수를 다루는 무선통신 분야의 엔지니어를 말해요. 이게 뭐냐면, 휴대폰 안테나가 어떻게 신호를...

클라우드에 맡긴 디지털 인생, 어느 날 갑자기 사라진다면

## 사진 한 장도 내 컴퓨터엔 없는 시대 생각해 보면 우리가 만들어내는 거의 모든 데이터가 지금 클라우드 어딘가에 있어요. 결혼식 사진, 아이의 첫걸음마 영상, 10년 치 이메일, 가계부 스프레드시트, 회사 업무 문서, 심지어 비밀번호 매니저까...

OpenAI가 SWE-bench Verified를 버린 이유 - AI 코딩 평가의 한계가 드러나다

## 벤치마크가 "포화"되면 생기는 일 OpenAI가 자사 블로그에 흥미로운 글을 올렸어요. 한동안 AI 코딩 능력의 표준 척도로 쓰이던 **SWE-bench Verified**라는 벤치마크를, 더 이상 자기들 모델 평가의 주요 지표로 쓰지 않겠다는...

VAX의 부동소수점은 왜 그렇게 까다로웠나 - OpenBSD 포팅 비화

## 40년 전 컴퓨터를 아직도 살리는 사람들 혹시 VAX라는 컴퓨터 들어보셨어요? 1977년에 DEC(디지털 이큅먼트 코퍼레이션)이라는 회사가 만든 미니컴퓨터인데요, 당시에는 대학교 전산실이나 기업 연구소의 핵심 장비였어요. 그런데 놀라운 건, O...

미국이 노리는 150GW 지열 혁명: 셰일 기술이 청정에너지를 깨우다

## 갑자기 지열이 핫해진 이유 에너지 이야기 좋아하세요? 보통 청정에너지라고 하면 태양광이나 풍력을 먼저 떠올리잖아요. 그런데 요즘 미국에서 진짜 무서운 속도로 주목받고 있는 게 따로 있어요. 바로 **차세대 지열(Next-generation ...

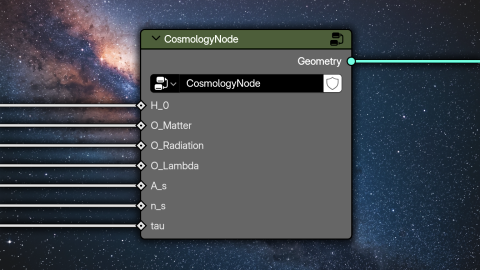

블렌더로 우주를 그리다, Geometry Nodes가 만들어낸 과학 시각화

## 영화용 도구가 우주 연구로 블렌더(Blender)를 아시나요. 무료로 쓸 수 있는 3D 그래픽 소프트웨어인데, 영화나 게임 제작에서 점점 자리를 넓혀가고 있는 도구예요. 이번에 블렌더 공식 사이트에 올라온 사용자 스토리 하나가 흥미로운데요,...

10기가 USB 랜카드, 이제 손가락만 해지고 발열도 잡혔다

## 드디어 10GbE가 'USB 막대기'가 되는 시대 요즘 집에서 NAS 쓰시는 분들, 또는 영상 편집을 위해 공유 스토리지를 굴리시는 분들이라면 한 번쯤 "우리 집 네트워크도 10기가비트로 올려볼까?" 하는 생각, 해보셨을 거예요. 그런데 막상 ...

IBM 양자컴퓨터 백엔드를 /dev/urandom으로 바꿔봤더니 결과가 똑같다는 농담 같은 진담

## 왜 갑자기 이런 프로젝트가 나왔을까 요즘 양자컴퓨팅 뉴스가 꽤 자주 들리죠. "몇 분 만에 슈퍼컴퓨터로 수만 년 걸릴 계산을 해냈다" 같은 헤드라인을 본 적 있을 거예요. 그런데 그 화려한 발표들 뒤에서 일부 연구자와 엔지니어들은 꽤 오래 ...

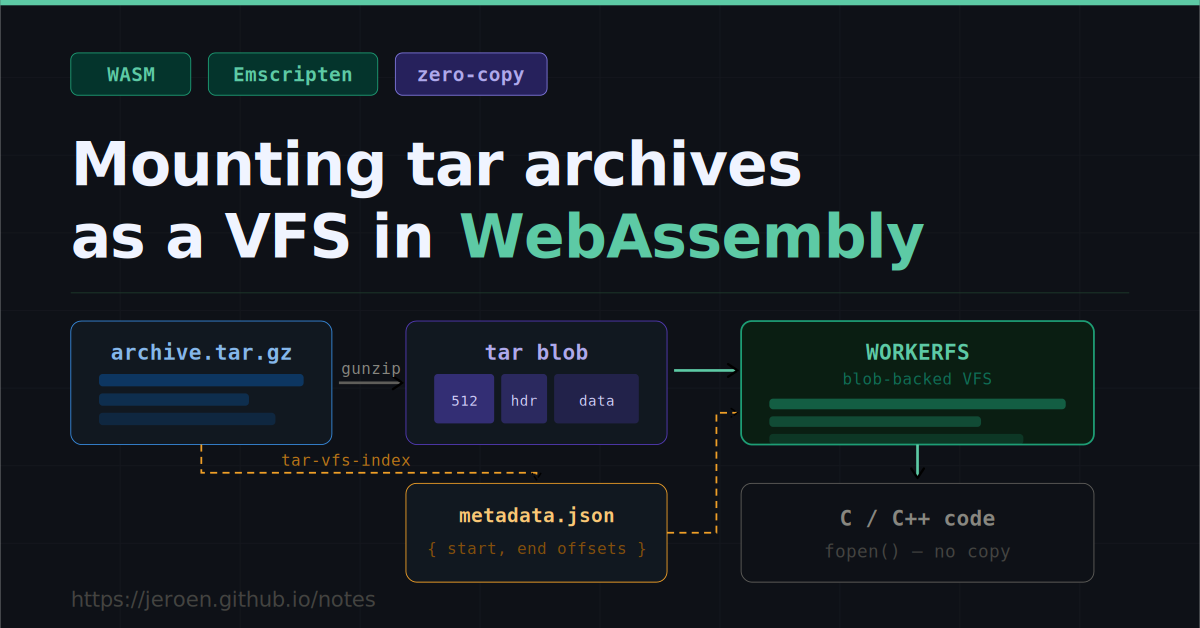

브라우저에서 tar 파일을 '진짜 파일시스템'처럼 마운트하기 - WebAssembly의 재미있는 활용

## 브라우저 안에서 파일시스템을 만든다는 것 Jeroen Ooms라는 개발자가 최근 자신의 블로그에 "WebAssembly에서 tar 아카이브를 파일시스템으로 마운트하기"라는 흥미로운 기술 노트를 올렸어요. 제목만 들으면 "그게 뭐 어쨌다는 거...

PyTorch가 드디어 TPU에서 '네이티브'로 돈다: TorchTPU가 바꿀 AI 학습 지형도

## PyTorch 개발자에게 반가운 소식 GPU에 익숙한 분들이라면 구글의 TPU(Tensor Processing Unit)라는 이름은 들어봤지만 막상 써본 적은 없으실 거예요. TPU는 구글이 머신러닝 전용으로 만든 칩인데요, 엄청나게 빠르지...

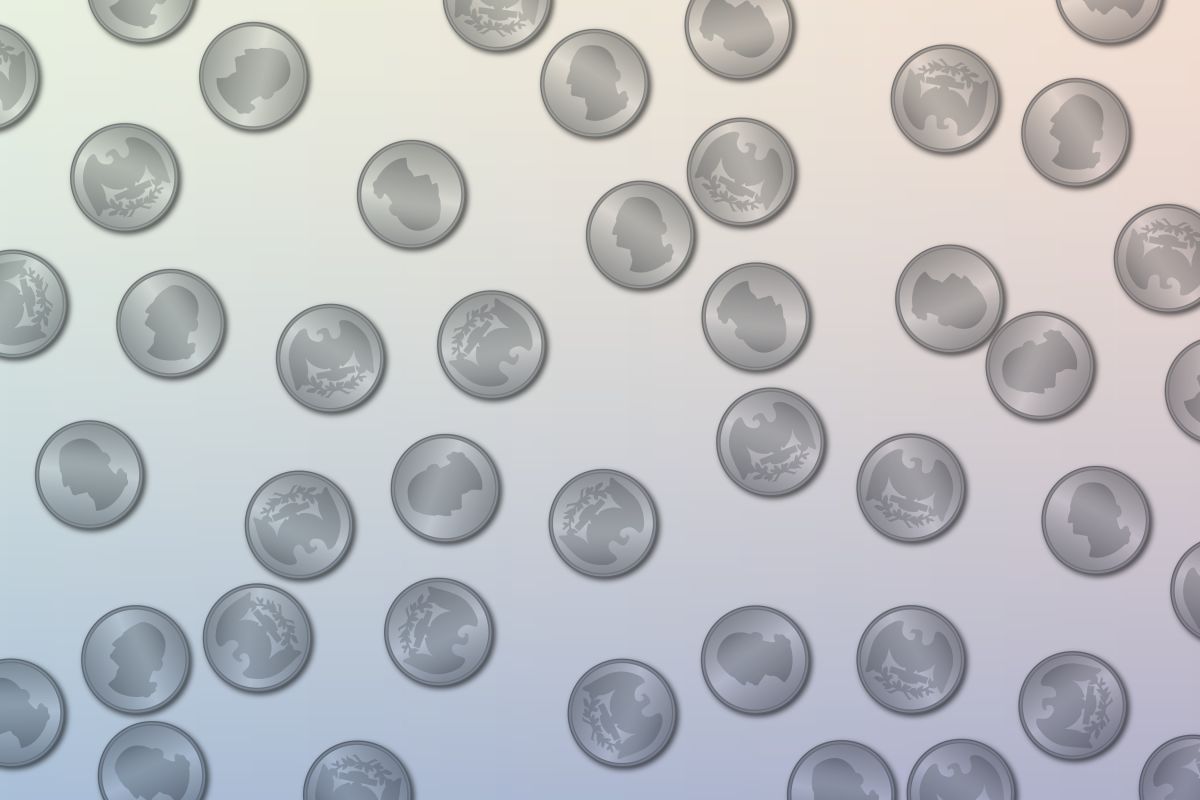

도박 분쟁에서 시작된 확률론 - 수학이 카드 테이블에서 태어난 이야기

오늘은 조금 색다른 이야기 해볼게요. 개발자라면 한 번쯤은 확률, 통계, 베이지안, 머신러닝 같은 단어를 접해봤을 거예요. 그런데 이 모든 개념의 출발점이 **르네상스 시대 이탈리아의 도박판**이었다는 사실 알고 계셨나요? 오늘 소개할 건 바로 그...

쇼핑할 때마다 값이 다르다면? 감시 가격제(Surveillance Pricing)의 실체

요즘 온라인 쇼핑하다가 "어? 어제 봤을 때보다 비싼데?" 싶었던 적 있으시죠. 아니면 친구랑 같은 여행 사이트에서 같은 호텔을 검색했는데 가격이 다르게 나온 경험이요. 우연일 수도 있지만, 그 뒤에는 꽤 정교한 시스템이 돌아가고 있을 가능성이 큽...

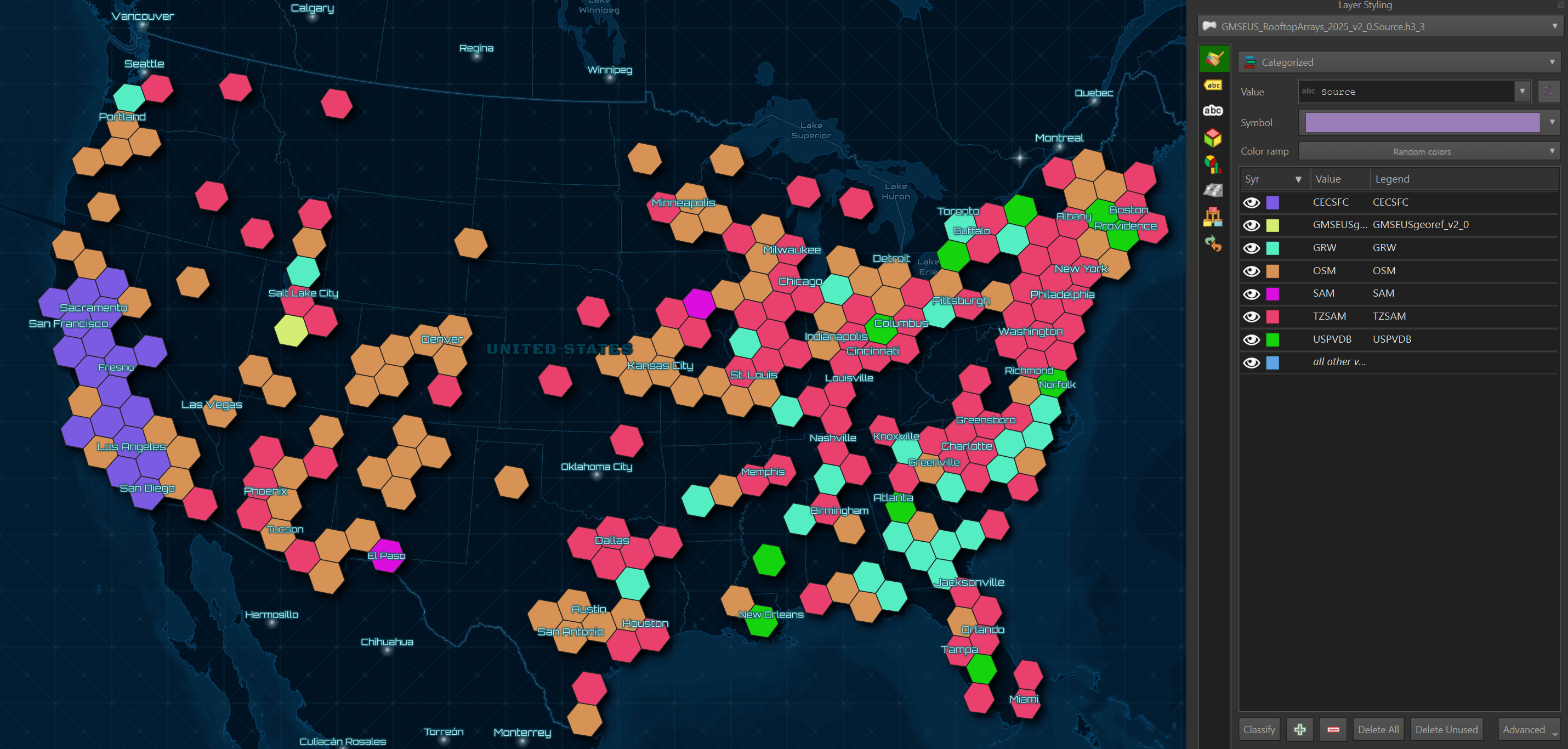

미국의 태양광 패널 340만 장을 데이터로 본다는 것

## 태양광 농장을 지도에 찍어본 엔지니어 데이터 엔지니어 Mark Litwintschik이 재밌는 프로젝트를 공개했어요. 바로 **미국 전역에 설치된 태양광 패널 340만 장의 위치와 정보를 분석한 블로그 포스트**예요. 제목은 간단하게 '3....

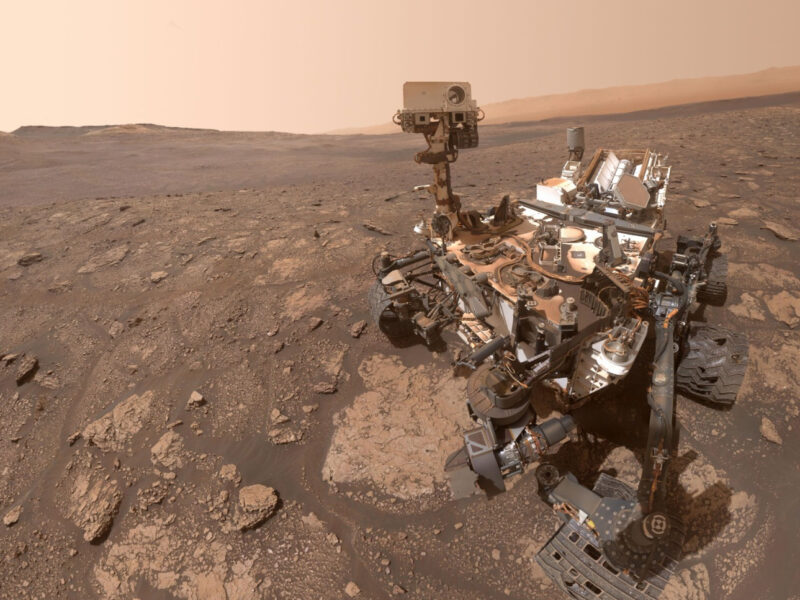

화성에서 수십억 년 묵은 유기 분자가 발견됐어요 - SAM TMAH 실험이 바꾼 판

## 화성에 정말 '생명의 흔적'이 있을 수도 있다고요? 화성 탐사선 큐리오시티(Curiosity)가 이번에 정말 흥미로운 결과를 가져왔어요. 게일 분화구(Gale Crater)의 오래된 진흙암(mudstone)에서 **다양한 유기 분자(orga...