![[심층분석] 상하이교통대가 공개한 '동수학대모형': LLM 실전 교재의 끝판왕을 뜯어보다](/newsimg/AEFHs31BGwVZu2lN.png)

들어가며: 왜 지금 '동수학대모형'인가요?

요즘 주변에서 "나도 LLM(대규모 언어 모델, 쉽게 말해 ChatGPT 같은 거대 AI)을 좀 만져보고 싶은데, 어디서부터 시작해야 할지 모르겠다"는 얘기 많이 들어요. 강의는 넘쳐나는데 정작 손에 잡히는 건 없고, 논문은 읽어도 구현이 막막하고, 그렇다고 회사에서 사수가 친절하게 가르쳐주지도 않고요. 저도 그런 상황이었어서 공감이 많이 되거든요.

그런 와중에 중국 상하이교통대(SJTU)의 장줘성(张倬胜) 교수 연구팀이 공개한 dive-into-llms(동수학대모형, 动手学大模型)이라는 교재가 정말 알찬 내용으로 꽉 차 있어서 소개해드리려고 해요. 이름부터가 "손으로 직접 대모형을 배운다"는 뜻이거든요. 이론만 떠드는 게 아니라, 진짜로 코드를 짜고 모델을 돌려보게 만드는 교재예요.

이게 뭐냐면, 상하이교통대의 《자연어처리 전선기술》(NIS8021)과 《인공지능 보안기술》(NIS3353)이라는 실제 대학 강의 자료를 확장해서 일반인도 볼 수 있게 공개한 거예요. 완전 무료고, 공익 프로젝트로 운영되고 있어요. 2025년 6월에는 화웨이 어센드(昇腾, Ascend) 커뮤니티와 협력해서 《대모형 개발 전 과정》이라는 국산화 버전까지 추가로 내놨고, 최근에는 수학 추론, GUI 에이전트, 모델 정렬, 스테가노그래피(은닉술) 같은 최신 주제들도 계속 업데이트되고 있어요.

한마디로 말해서, "LLM 전 영역을 커리큘럼처럼 체계적으로 쌓아올릴 수 있는 몇 안 되는 자료"라는 점에서 주목해볼 만해요.

이 교재가 다루는 11가지 주제 살펴보기

일단 목차를 한번 훑어볼게요. 각 주제마다 [강의자료 PPT] + [튜토리얼 문서] + [실행 가능한 스크립트], 이렇게 세 세트가 묶여서 제공돼요. 이게 진짜 중요한 포인트인데요, 대부분의 무료 자료는 PPT만 있거나 코드만 있거나 둘 중 하나거든요. 그런데 이 교재는 셋을 다 연결해놨어요.

1. 미세조정(Fine-tuning)과 배포

기초 중의 기초예요. 사전학습된 모델(pretrained model, 이미 대규모 데이터로 훈련이 끝난 모델)을 가져와서, 내가 풀고 싶은 특정 문제에 맞게 추가로 학습시키고, 그걸 실제 웹 데모로 띄우는 것까지 한 번에 해봐요. "내 회사 문서에 특화된 챗봇" 같은 거 만들 때 바로 쓰는 기술이에요.

2. 프롬프트 학습과 사고의 사슬(Chain of Thought)

API 호출로 대형 모델을 다루는 법인데요, 사고의 사슬이라는 게 뭐냐면 모델한테 "답만 내지 말고 푸는 과정을 단계별로 보여줘"라고 시키는 거예요. 신기하게도 이렇게 하면 정답률이 확 올라가거든요. 교재에서는 "AI가 온라인으로 칭찬을 구걸한다"는 재미있는 비유로 설명해요.

3. 지식 편집(Knowledge Editing)

이건 좀 신기한 분야예요. 쉽게 말해서, 모델이 잘못 기억하고 있는 사실을 모델 파라미터 수준에서 직접 수정하는 기술이에요. 예를 들어 모델이 "대한민국의 수도는 평양"이라고 헛소리를 한다면, 전체를 다시 학습시키지 않고 그 특정 지식만 콕 집어서 고치는 거죠. 뇌수술 같은 느낌이에요.

4. 수학 추론과 미니 R1 증류

이 주제가 정말 핫한 이유가 있어요. DeepSeek R1이 등장한 이후로 "추론형 모델"이 업계의 새로운 화두가 됐거든요. 교재에서는 작은 모델에 큰 모델의 추론 능력을 옮겨 심는 지식 증류(Knowledge Distillation) 기법으로 미니 R1을 만들어봐요. 이게 뭐냐면, 똑똑한 선생님(큰 모델)이 푸는 과정을 학생(작은 모델)이 따라 외우게 해서, 학생도 비슷하게 똑똑해지게 만드는 거예요.

5. 모델 워터마크와 스테가노그래피

AI가 만든 콘텐츠가 범람하는 시대에 점점 중요해지는 주제예요. 워터마크는 "이 텍스트는 AI가 만들었음"을 사람 눈에는 안 보이게 표시하는 거고, 스테가노그래피는 한 단계 더 나가서 자연스러운 대화 속에 비밀 메시지를 숨겨 보내는 기술이에요. 교재에서는 이걸 "보이지 않는 잉크"라고 표현하는데, 비유가 찰떡이죠.

6. 탈옥 공격(Jailbreak Attack)

"더 좋은 보안을 원한다면 공격부터 배워라"는 말로 시작하는 챕터예요. ChatGPT나 Claude한테 정상적으로는 대답 못 하게 막혀 있는 것들을, 프롬프트를 교묘하게 짜서 뚫어내는 기법이에요. 레드팀(공격자 입장에서 보안을 테스트하는 사람들) 업무를 하는 분들한테 필수 내용이에요.

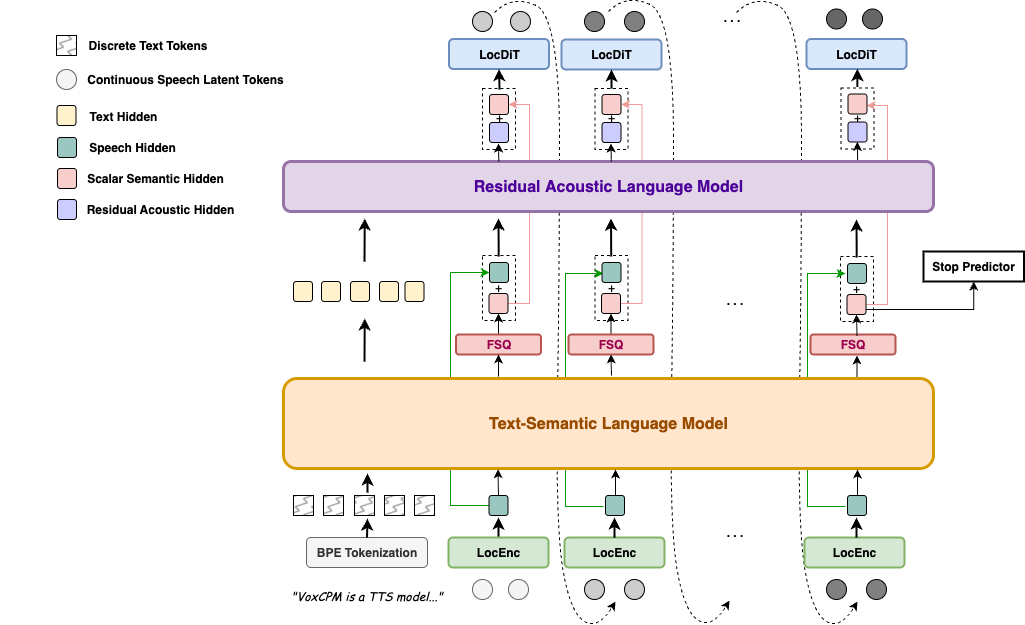

7. 멀티모달 모델

텍스트뿐 아니라 이미지, 음성, 영상까지 함께 이해하는 모델 얘기예요. GPT-4o나 Gemini 같은 모델들이 이 분야죠. "AGI(범용 인공지능)로 가는 길은 결국 멀티모달이다"라는 관점에서 접근해요.

8. GUI 에이전트

요즘 Anthropic의 Computer Use나 OpenAI의 Operator가 화제가 된 그 분야예요. 쉽게 말하면 AI가 사람 대신 마우스 클릭하고 키보드 입력해서 웹사이트 돌아다니는 거예요. 교재에서는 "AI 에이전트한테 배달 주문시키고, 메시지 답장시키고, 가격 비교하게 시켜보자"라고 유쾌하게 설명해요.

9. 에이전트 보안과 RLHF 안전 정렬

AI 에이전트가 자율적으로 행동하기 시작하면 생기는 위험을 다뤄요. RLHF(인간 피드백 기반 강화학습, Reinforcement Learning from Human Feedback)는 ChatGPT를 "말 잘 듣는 AI"로 만든 핵심 기술인데, 교재에서는 PPO 알고리즘 기반으로 직접 구현해봐요. 경고문구가 재밌는데 "이 교재는 매우 위험합니다. 읽고 나서 당신의 대모형이 냉소를 짓는지 확인하세요"라고 쓰여 있어요.

왜 이 커리큘럼 구성이 훌륭한가요?

저는 이 교재의 진짜 가치가 목차 설계 자체에 있다고 봐요. 하나씩 뜯어보면요.

기초 → 응용 → 안전, 이 흐름이 자연스러워요

보통 무료 LLM 강의들은 두 부류로 갈려요. 하나는 "트랜스포머 아키텍처란 무엇인가" 같은 이론 위주, 다른 하나는 "LangChain으로 RAG 앱 만들기" 같은 완전 실전 위주예요. 그런데 이 교재는 미세조정 → 프롬프팅 → 지식 편집 → 추론 → 멀티모달 → 에이전트 → 안전이라는 흐름을 잡았어요.

이게 왜 좋냐면, 실제로 LLM을 프로덕션에 넣을 때 고민하는 순서거든요. 처음엔 "어떻게 내 도메인에 맞추지?"(미세조정), 그다음엔 "비용 줄이려면 프롬프트로 해결 가능한가?"(프롬프팅), 그러다가 "모델이 헛소리하는데 어쩌지?"(지식 편집), "우리 서비스가 공격당하면?"(탈옥/안전 정렬) 이렇게 자연스럽게 흘러가요.

공격과 방어를 함께 가르쳐요

이 부분이 특히 인상적이에요. 대부분의 AI 강의는 "이렇게 만드세요"만 가르치지, "이걸 어떻게 깰 수 있는지"는 잘 안 다루거든요. 그런데 이 교재는 탈옥 공격, 에이전트 보안, 워터마크 우회 같은 걸 정면으로 다뤄요. 보안 업계 표현으로 "레드팀과 블루팀을 함께 키운다"는 접근인데, AI 안전성 연구의 정석이라고 할 수 있어요.

경쟁 자료들과 비교해볼까요?

무료로 공개된 LLM 교재가 이것만 있는 건 아니거든요. 몇 가지 유명한 것들과 비교해볼게요.

Hugging Face의 NLP Course / LLM Course

Hugging Face 것은 자사의 transformers 라이브러리 중심이라 "생태계 몰입형" 느낌이에요. 비유하자면 "우리 집 도구로 요리하는 법" 같은 거죠. 완성도는 굉장히 높지만 Hugging Face 바깥 기술은 잘 안 나와요. 반면 dive-into-llms는 "주제별 개론서" 같아서 도구에 덜 매여 있어요.

Andrej Karpathy의 "Zero to Hero" 시리즈

카파시 형님 강의는 "밑바닥부터 GPT 만들기" 장인의 길이에요. PyTorch로 어텐션을 한 줄씩 구현하는 거죠. 깊이는 타의 추종을 불허하지만, 에이전트나 RLHF 같은 응용 주제는 다루지 않아요. dive-into-llms는 반대로 응용과 생태계 쪽을 넓게 다뤄요. 둘은 보완재에 가깝다고 봐요.

Stanford CS336 / CS224N 같은 대학 강의

스탠퍼드 강의들은 학술적 깊이가 최고지만 솔직히 주니어가 따라가기엔 진입장벽이 높아요. dive-into-llms는 대학 강의를 기반으로 하되 공개 교재로 다듬어서 조금 더 친절한 편이에요. 중국어라는 장벽이 있긴 하지만, 코드와 주석은 대부분 영어라 읽을 만해요.

DeepLearning.AI의 짧은 코스들

Andrew Ng의 DeepLearning.AI 코스들은 1-2시간짜리 스낵형 콘텐츠예요. 특정 주제를 빠르게 훑기엔 좋은데, 시스템적으로 쌓아올리기엔 부족하죠. dive-into-llms는 반대로 한 학기 분량의 커리큘럼이에요.

정리하자면, 이 교재의 독특한 포지셔닝은 "대학 강의의 체계성" + "실전 코드의 구체성" + "보안/안전 주제의 중요도"를 한 번에 잡았다는 거예요.

한국 개발자에게 주는 시사점

그럼 이걸 어떻게 활용하면 좋을까요? 상황별로 나눠서 얘기해볼게요.

신입/주니어 개발자: 3개월 학습 로드맵으로 써보기

지금 AI 쪽으로 커리어 전환하려고 하거나, 회사에서 LLM 프로젝트에 투입될 예정이라면 이런 순서를 추천해요.

- 1개월 차: 미세조정과 배포 + 프롬프트 학습. 이 두 개만 제대로 이해해도 어지간한 실무는 다 쳐낼 수 있어요.

- 2개월 차: 지식 편집 + 수학 추론 + 멀티모달. 본인이 관심 있는 분야 하나를 깊게 파세요.

- 3개월 차: 에이전트 + RLHF + 보안. 여기까지 오면 주니어를 벗어나는 단계예요.

시니어/팀리드: 사내 스터디나 온보딩 자료로 활용

AI 팀을 꾸리거나 기존 팀원들 역량을 끌어올려야 하는 분들이라면, 이 교재를 사내 스터디 커리큘럼의 뼈대로 삼아볼 만해요. 매주 한 챕터씩 발제하면 대략 3개월짜리 스터디가 나오거든요. 특히 에이전트 보안이나 탈옥 공격 같은 주제는 회사 자체 자료로 준비하려면 시간이 엄청나게 드는데, 이 교재가 출발점을 제공해줘요.

도입 시 주의할 점

솔직히 말씀드리면 몇 가지 허들은 있어요.

첫째, 언어 문제예요. 강의자료와 설명이 주로 중국어라서, 크롬 번역기나 DeepL을 띄워놓고 봐야 해요. 다행히 기술 용어는 거의 영어라 맥락 이해엔 큰 지장이 없어요.

둘째, 환경 세팅이 만만치 않아요. 특히 RLHF나 큰 모델 미세조정은 GPU가 꽤 필요하거든요. 회사 GPU가 없다면 Colab Pro나 RunPod 같은 클라우드 GPU를 빌려 쓰는 걸 고려하세요. 교재 일부는 소형 모델로도 돌아가게 설계돼 있어서 노트북으로도 시도해볼 수 있어요.

셋째, 일부 내용은 화웨이 어센드 NPU 기반이에요. 국산화 버전은 엔비디아 GPU가 아닌 화웨이 칩을 기준으로 해서, 그대로 따라 하기 어려울 수 있어요. 원본 교재 위주로 보시면 NVIDIA 환경에 맞는 내용이에요.

이 흐름이 앞으로 뭘 바꿀까요?

저는 이런 오픈 커리큘럼이 계속 나오는 흐름 자체가 중요하다고 봐요. 2023년만 해도 LLM을 제대로 배우려면 OpenAI나 Google 같은 빅테크 출신들의 블로그 조각을 주워 모아야 했거든요. 그런데 2025년을 거치면서 대학 강의, 기업 협업 자료, 오픈소스 튜토리얼이 합쳐진 형태의 공개 교재들이 계속 쏟아지고 있어요.

이게 의미하는 건 "LLM이 더 이상 빅테크의 비밀이 아니라 학부 4학년 선택과목 수준으로 내려왔다"는 거예요. 10년 전 딥러닝이 그랬고, 15년 전 빅데이터가 그랬죠. 이제는 "내가 LLM을 안 배웠으니까"가 아니라 "얼마나 깊이 활용할 수 있는가"가 경쟁력이 되는 시대가 왔어요.

특히 이 교재가 공격/방어, 안전 정렬, 에이전트 보안을 비중 있게 다루는 건 의미심장해요. 앞으로 AI 관련 법규(EU AI Act나 국내 AI 기본법)가 강화되면, 모델의 안전성을 검증하고 공격을 방어하는 역량이 단순히 "있으면 좋은" 게 아니라 "없으면 서비스 못 내는" 필수 역량이 될 테니까요.

마무리하며

만약 제가 2026년에 LLM 커리어를 처음 시작하는 주니어라면, 저는 이 교재를 북마크해두고 주말마다 한 챕터씩 씹어 먹을 것 같아요. 무료인데 퀄리티는 대학 강의 수준이고, 최신 주제(R1 증류, GUI 에이전트, 스테가노그래피)까지 커버하는 자료는 생각보다 많지 않거든요.

그래서 질문을 몇 개 던지면서 마무리할게요. 여러분은 지금 LLM을 어떻게 배우고 계신가요? Hugging Face 튜토리얼파? 카파시 장인 스쿨파? 아니면 그냥 회사 업무하면서 필요할 때마다 구글링파? 댓글로 각자의 학습 경로 공유해주시면 재밌을 것 같아요.

그리고 하나 더, 공격 기법(탈옥, 워터마크 우회 같은)까지 기본 교재에 포함시키는 것에 대해 어떻게 생각하세요? 저는 필수라고 보는 쪽인데, "악용될 수 있으니 선별적으로 공개해야 한다"는 의견도 있거든요. 이 부분은 커뮤니티에서 토론이 더 필요한 영역 같아요. 여러분의 생각이 궁금해요.

🔗 출처: GitHub

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공