사진 한 장 없이 몸을 모델링한다는 발상

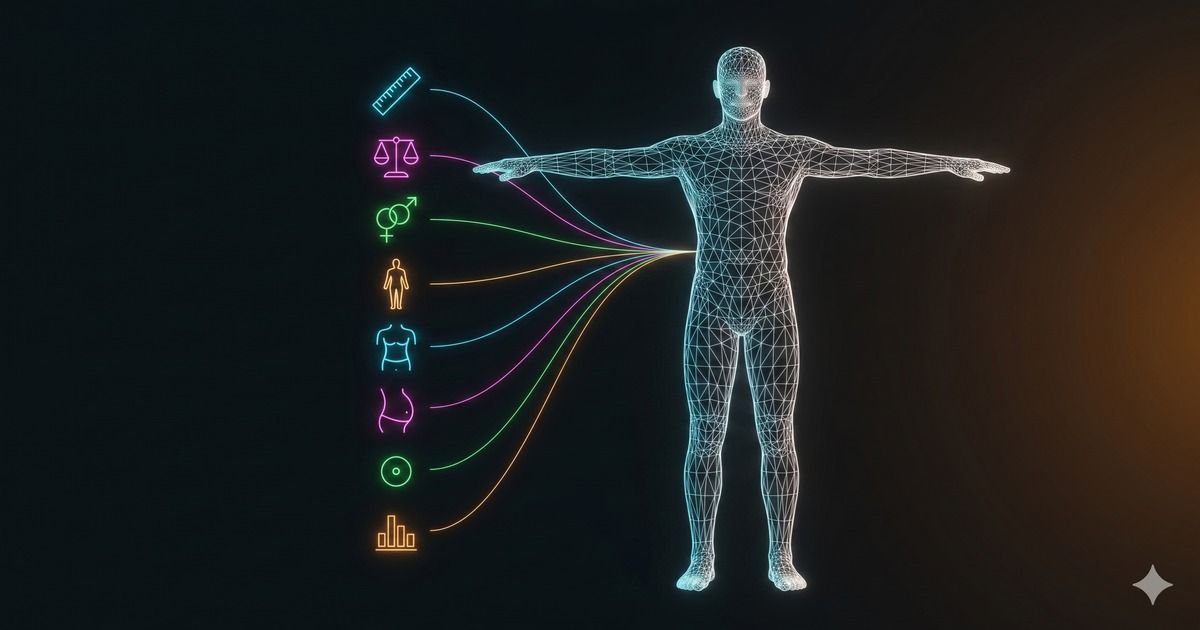

3D 인체 모델링이라고 하면 보통 어떤 그림이 떠오르세요? 스튜디오에서 수십 대 카메라로 둘러싼 풀바디 스캔, 아니면 최소한 스마트폰으로 한 바퀴 돌면서 찍은 영상 같은 걸 떠올리실 거예요. 옷이 몸에 잘 맞는지 보여주는 가상 피팅이나, 체형 분석 같은 서비스들이 다 그런 방식이거든요. 그런데 이번에 소개할 "clad.you" 블로그의 글은 완전히 다른 접근을 보여줘요. "사진 한 장 없이, 그냥 8개 질문에 답하는 것만으로 꽤 그럴듯한 3D 인체 메시를 만든다" 는 거예요. 게다가 GPU도 필요 없어요.

언뜻 들으면 "그게 가능해?" 싶죠. 하지만 곰곰이 생각해보면 우리 몸의 형태는 키, 몸무게, 성별, 어깨너비, 허리둘레 같은 몇 개의 굵직한 변수로 상당 부분 결정돼요. 사람들이 옷을 살 때 사이즈표만 보고도 대충 맞는 옷을 고르는 게 그 증거죠. 이 글의 저자는 이 직관을 ML 모델로 옮긴 거예요.

어떻게 동작하나: SMPL과 작은 MLP의 조합

핵심 아이디어를 풀어볼게요. 인체 3D 모델링 분야엔 SMPL(Skinned Multi-Person Linear model)이라는 유명한 통계 모델이 있어요. 이게 뭐냐면, 수천 명의 실제 인체를 스캔한 데이터로 "인간 몸"을 약 10개 안팎의 주성분(shape parameter)으로 압축한 모델이에요. 이 10개 숫자만 잘 정해주면 SMPL이 알아서 6890개 정점으로 된 인체 메시를 출력해줘요. 키 큰 사람, 마른 사람, 어깨 넓은 사람 등등을 다 표현할 수 있죠.

그동안 이 "shape parameter"를 추정하려면 보통 사진 → 신경망 → 파라미터 흐름이 필요했어요. 그래서 GPU와 큰 모델이 동원되곤 했죠. 이 글의 저자는 발상을 뒤집어요. "사람이 직접 답할 수 있는 8개 질문 → 작은 MLP → SMPL 파라미터" 로 가자는 거예요. 질문은 키, 몸무게, 성별 같은 기본 정보에 더해서, 어깨/가슴/허리/엉덩이 둘레 같은 자가측정 가능한 항목들로 구성돼 있어요.

학습은 합성 데이터로 해요. SMPL로 가상의 사람들을 잔뜩 만들어내고, 그 가상 인체에서 키와 둘레 등을 측정해서 "질문 답변 → SMPL 파라미터" 쌍을 무한히 뽑아낼 수 있거든요. 그리고 그걸로 아주 작은 MLP(다층 퍼셉트론, 가장 기본적인 신경망 구조예요)를 학습시켜요. 모델이 워낙 작아서 학습도 추론도 노트북 CPU에서 순식간에 끝나요. 그래서 "No GPU"라는 부제가 붙은 거고요.

결과의 정확도도 흥미로워요. 사진 기반 방법이 옷이나 자세, 조명 때문에 종종 엉뚱한 추정을 내놓는 데 비해, 자가측정 기반 방법은 사용자가 정직하게 답하는 만큼 "평균적으로" 더 안정적인 결과를 낸다고 해요. 물론 답변의 정확성이 떨어지면 결과도 떨어지지만, 그건 사진 방식도 마찬가지죠.

업계 흐름 속 위치

3D 휴먼 분야에선 그동안 PIFu, ICON, ECON 같은 사진 기반 고정밀 방법론이 화려한 결과로 주목을 받았어요. Meta의 Codec Avatar나 Apple Vision Pro의 Persona 같은 것도 결국 비싼 캡처 장비나 깊이 센서를 활용한 방향이고요. 한쪽에선 NeRF, 가우시안 스플래팅 같은 신기술로 더 사실적인 인체를 만들려는 흐름이 강해요.

반대로 이번 접근은 "덜 화려하지만 훨씬 실용적"인 쪽이에요. 가상 피팅, 체형 추적, 헬스케어 앱 같은 분야는 사실 "멋진 디테일"보다 "치수가 맞는 평균 인체"가 훨씬 중요하거든요. 게다가 사진을 받지 않으면 프라이버시 부담이 사라져요. 사용자도 옷 벗고 사진 찍는 부담이 없고, 서비스 제공자도 민감한 신체 이미지를 저장하지 않아도 되죠. GDPR이나 한국의 개인정보보호법 측면에서도 훨씬 유리해요.

한국 개발자에게는 어떤 기회가

한국은 의류 이커머스, 피트니스 앱, 헬스케어 시장이 세계적으로도 활발한 곳이에요. 그동안 "가상 피팅"이 제대로 자리잡지 못한 큰 이유 중 하나가 사용자가 사진을 찍어서 올리는 단계의 마찰이었어요. 무신사, 29CM, 지그재그 같은 플랫폼이 "내 체형에 맞는 추천"을 하려면 결국 체형 데이터가 필요한데, 카메라를 켜야 한다는 단계가 있는 순간 전환율이 뚝 떨어지거든요.

이 글에서 보여주는 접근은 "질문 몇 개 → 즉시 3D 미리보기" 라는 매우 가벼운 UX를 가능하게 해요. 정확도가 사진 방식보다 살짝 떨어지더라도, 0% 사용자 → 30% 사용자로 전환율을 끌어올릴 수 있다면 비즈니스적으로 훨씬 의미 있는 거예요. 또 SMPL 자체는 학술용 라이선스 이슈가 있어서, 상용에선 SMPL-X 또는 STAR, 혹은 자체 통계 모델을 검토할 필요가 있다는 점은 실무 도입 시 주의하셔야 해요.

마무리

"화려한 모델보다 잘 정의된 작은 모델 하나가 실제 문제를 더 잘 푼다" — 이 글이 주는 메시지는 결국 그거예요. 여러분이라면 사진 기반 정밀 모델과 질문 기반 가벼운 모델 중 어느 쪽을 먼저 프로덕트에 붙여보시겠어요? 정확도와 사용자 마찰 사이의 트레이드오프, 한 번 얘기 나눠봐요.

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공