브라우저만 열면 AI가 동작한다고요?

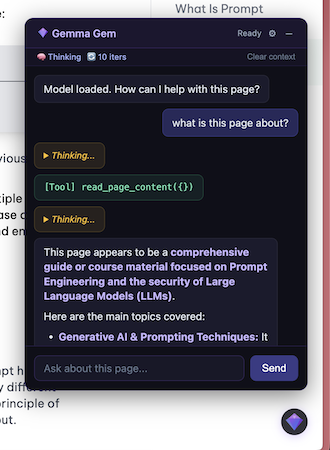

보통 AI 모델을 쓰려면 어떻게 하나요? OpenAI API 키를 발급받거나, 클라우드 서버에 모델을 올려서 요청을 보내야 하죠. 그런데 "Gemma Gem"이라는 프로젝트는 접근 방식이 완전히 달라요. Google의 경량 AI 모델인 Gemma를 브라우저 안에 직접 내장해서, 서버 통신 없이 사용자의 기기에서 바로 추론(inference)을 실행하는 거예요.

이게 뭐냐면, 여러분이 웹페이지를 열면 AI 모델이 함께 다운로드되어서 브라우저 내에서 돌아가는 거예요. 카페에서 와이파이 끊겨도, 비행기 안에서도, 인터넷 없이도 AI를 쓸 수 있다는 뜻이에요. API 키를 관리할 필요도 없고, 서버 비용도 안 들고, 내 데이터가 외부로 나가지도 않아요.

어떻게 가능한 건가요?

이 프로젝트의 기술적 핵심은 WebGPU와 WebAssembly(WASM) 기반의 브라우저 내 모델 실행이에요. 하나씩 풀어볼게요.

WebGPU는 브라우저에서 GPU(그래픽 처리 장치)에 직접 접근할 수 있게 해주는 비교적 새로운 웹 표준이에요. 예전에는 브라우저에서 무거운 연산을 하려면 한계가 많았는데, WebGPU 덕분에 브라우저에서도 GPU 가속을 활용한 고성능 연산이 가능해졌어요. AI 모델의 추론이라는 게 결국 엄청난 양의 행렬 곱셈이거든요. GPU가 이걸 아주 잘하죠.

Gemma는 Google DeepMind가 만든 경량 오픈소스 AI 모델이에요. GPT-4나 Claude 같은 대형 모델과 비교하면 크기가 훨씬 작아요. 그래서 브라우저에서 돌릴 수 있는 거예요. 작다고 성능이 나쁜 건 아니고, 크기 대비 꽤 괜찮은 성능을 보여주는 모델이에요.

Gemma Gem은 이 둘을 결합해서, 웹 컴포넌트(Web Component) 형태로 AI 모델을 웹페이지에 임베딩할 수 있게 만들었어요. 웹 컴포넌트가 뭐냐면, HTML 태그처럼 쓸 수 있는 재사용 가능한 UI 요소예요. 즉, HTML에 커스텀 태그 하나 넣으면 AI 채팅 인터페이스가 뚝딱 생기는 구조라는 거예요.

기존 방식과 뭐가 다른가요?

지금까지 웹 애플리케이션에 AI를 넣으려면 대부분 이런 구조였어요. 사용자가 입력을 하면 서버로 요청이 가고, 서버에서 AI 모델을 돌려서 결과를 받아오는 클라이언트-서버 구조요. 이 방식의 문제점은 명확해요.

서버 비용이 계속 발생하고, API 호출 수에 따라 과금되고, 네트워크 지연(latency)이 있고, 사용자의 데이터가 외부 서버로 전송되니 프라이버시 이슈도 있어요. 특히 개인 프로젝트나 프로토타입 단계에서 API 비용은 꽤 부담이 되죠.

반면 Gemma Gem 같은 브라우저 내 실행 방식은 이런 문제들을 구조적으로 해결해요. 모든 처리가 사용자 기기에서 일어나니까 서버 비용이 제로이고, 데이터가 기기를 떠나지 않으니 프라이버시가 완벽하게 보장되고, 네트워크 지연도 없어요.

물론 한계도 있어요. 브라우저에서 돌릴 수 있는 모델 크기에는 제약이 있기 때문에, GPT-4급의 복잡한 추론을 기대하기는 어려워요. 또 초기 모델 다운로드에 시간이 걸리고, 사용자 기기의 GPU 성능에 따라 속도 차이가 클 수 있어요. WebGPU를 지원하지 않는 구형 브라우저에서는 아예 동작하지 않을 수도 있고요.

비슷한 프로젝트들과 비교하면?

브라우저에서 AI를 돌리려는 시도는 Gemma Gem이 처음이 아니에요. llama.cpp의 WASM 빌드, Transformers.js (Hugging Face가 만든 자바스크립트용 트랜스포머 라이브러리), Web LLM 같은 프로젝트들이 이미 비슷한 방향을 탐색해왔어요.

Gemma Gem의 차별점은 "웹 컴포넌트로서의 간편한 임베딩"에 초점을 맞추고 있다는 거예요. 다른 프로젝트들은 좀 더 범용적이고 유연하지만 설정이 복잡할 수 있는 반면, Gemma Gem은 HTML 태그 하나로 바로 쓸 수 있는 단순함을 추구하고 있어요. 마치 YouTube 영상을 iframe으로 임베딩하듯이, AI 채팅을 웹페이지에 임베딩할 수 있다고 생각하면 돼요.

넓게 보면 이건 "엣지 AI" 또는 "온디바이스 AI"라는 큰 흐름의 일부예요. Apple이 iPhone에서 로컬 AI를 강조하고, Google이 Gemini Nano를 기기에서 돌리는 것과 같은 맥락이에요. 클라우드에 의존하지 않는 AI, 프라이버시를 지키는 AI가 점점 중요해지고 있는 거죠.

한국 개발자에게 어떤 의미가 있을까요?

당장 써볼 수 있는 시나리오가 몇 가지 있어요. 먼저, 프라이버시가 중요한 서비스에요. 건강 데이터, 금융 정보, 개인 일기 같은 민감한 데이터를 다루는 앱에서, 데이터를 서버로 보내지 않고 AI 기능을 제공할 수 있으면 큰 경쟁력이 되겠죠. 한국은 개인정보보호법이 꽤 엄격한 편이라 이런 온디바이스 접근이 더 매력적일 수 있어요.

또 오프라인 지원이 필요한 서비스에서도 유용해요. 산업 현장이나 네트워크가 불안정한 환경에서 AI 기능이 필요한 경우, 브라우저 내 실행이 답이 될 수 있어요.

그리고 사이드 프로젝트를 만들 때 API 비용 걱정 없이 AI 기능을 넣을 수 있다는 것도 매력적이에요. 토이 프로젝트에 월 몇만 원씩 API 비용 내기는 좀 아깝잖아요.

정리하자면

Gemma Gem은 "AI를 쓰려면 반드시 클라우드가 필요하다"는 고정관념에 도전하는 프로젝트예요. 아직 대형 모델을 대체할 수준은 아니지만, 특정 유스케이스에서는 충분히 실용적인 선택지가 될 수 있어요.

여러분이 만들고 있는 서비스에서 "서버 없이 브라우저에서만 돌아가는 AI"가 쓸 만한 곳이 있을까요? 어떤 기능에 적용해보고 싶은지 이야기 나눠봐요.

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공