10억 번의 충돌, 그 중 의미 있는 건 극소수

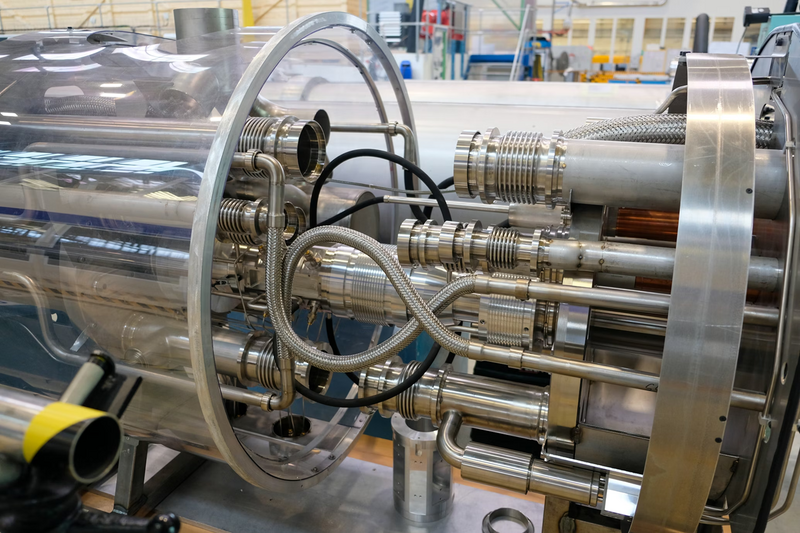

CERN(유럽입자물리연구소)에는 LHC(Large Hadron Collider, 대형 강입자 충돌기)라는 거대한 장치가 있어요. 둘레가 27km에 달하는 지하 터널에서 양성자를 거의 빛의 속도로 가속시켜 충돌시키는 장치인데요, 이 충돌을 통해 물질의 근본 구조를 연구하는 거예요. 2012년에 힉스 보손(Higgs boson)을 발견한 것도 바로 이 LHC 덕분이었죠.

그런데 여기서 엄청난 데이터 문제가 생겨요. LHC에서는 초당 약 10억 번(!)의 양성자 충돌이 일어나거든요. 각 충돌에서 수많은 입자가 쏟아져 나오고, 이걸 다 기록하면 초당 수백 테라바이트의 데이터가 발생해요. 세상의 어떤 저장장치도 이 양을 다 감당할 수 없어요.

다행히 물리학적으로 흥미로운 충돌, 그러니까 새로운 입자가 생성되었을 수 있는 "특별한" 충돌은 극히 일부예요. 그래서 CERN에는 트리거 시스템(trigger system)이라는 게 있어요. 이게 뭐냐면, 실시간으로 충돌 데이터를 분석해서 "이건 저장할 가치가 있다" 또는 "이건 버려도 된다"를 즉석에서 판단하는 필터링 시스템이에요. 초당 10억 건을 걸러서 실제로 저장하는 건 초당 약 1,000건 정도로 줄이는 거죠.

왜 AI 모델을 칩 안에 '태워 넣어야' 했을까

기존 트리거 시스템은 물리학자들이 직접 규칙을 정해서 만든 알고리즘으로 동작했어요. "에너지가 이 기준 이상이면 저장, 아니면 버림" 같은 방식이죠. 하지만 LHC가 업그레이드되면서 충돌 빈도와 복잡도가 점점 올라가고 있고, 단순한 규칙만으로는 정말 흥미로운 이벤트를 놓칠 수 있다는 문제가 생겼어요.

그래서 CERN이 선택한 방법이 머신러닝 모델을 사용한 필터링이에요. 근데 여기서 핵심적인 제약이 있어요. 이 판단을 수 마이크로초(100만분의 1초) 이내에 해야 한다는 거예요. GPU에 모델을 올려서 추론하는 일반적인 방식으로는 이 지연 시간(latency) 요구사항을 절대 맞출 수가 없어요.

그래서 CERN이 택한 해법이 정말 독특한데요. AI 모델을 소프트웨어가 아니라 FPGA(Field Programmable Gate Array)나 ASIC(Application-Specific Integrated Circuit) 같은 하드웨어에 직접 구현하는 거예요. 이걸 "실리콘에 태워 넣는다"고 표현하는 건데, 모델의 가중치와 연산 로직이 칩의 회로 자체로 구현되기 때문에 소프트웨어적인 오버헤드가 전혀 없어요. 전기 신호가 회로를 지나가는 것 자체가 추론이 되는 거죠.

hls4ml: 머신러닝 모델을 하드웨어로 변환하는 도구

CERN에서 이 작업을 위해 개발한 오픈소스 도구가 hls4ml(High-Level Synthesis for Machine Learning)이에요. 이 도구가 하는 일은 TensorFlow나 PyTorch로 학습시킨 모델을 받아서, FPGA에 올릴 수 있는 하드웨어 설계 코드(HLS, 고수준 합성)로 자동 변환해주는 거예요.

여기서 "작은(tiny) AI 모델"이라는 표현이 중요한데요. FPGA의 자원은 제한적이기 때문에, GPT 같은 수십억 파라미터 모델은 당연히 못 올려요. 수백에서 수천 개의 파라미터를 가진 아주 작은 신경망을 쓰는 거예요. 하지만 이 작은 모델이 특정 물리 패턴을 감지하는 데는 충분히 정확하거든요. 범용성은 포기하고, 한 가지 일을 극한의 속도로 하는 거죠.

또 흥미로운 기술이 양자화(quantization)와 가지치기(pruning)예요. 양자화는 모델의 가중치를 32비트 부동소수점 대신 6비트나 심지어 2비트로 표현하는 건데, 이렇게 하면 정확도는 약간 떨어지지만 필요한 하드웨어 자원이 극적으로 줄어들어요. 가지치기는 모델에서 영향이 적은 연결을 잘라내서 모델을 더 가볍게 만드는 기법이고요.

일반 개발 세계에 주는 영감

CERN의 사례가 일반 소프트웨어 개발자에게 직접적으로 적용되는 경우는 드물겠지만, 몇 가지 중요한 인사이트가 있어요.

첫째, "AI = 거대 모델"이라는 고정관념에 도전하는 사례예요. 지금 업계 트렌드가 모델을 크게 만드는 쪽이잖아요. 하지만 CERN은 정반대로 극도로 작은 모델이 실제 물리적 한계 상황에서 엄청난 가치를 만들어내고 있어요. 엣지 컴퓨팅이나 IoT 분야에서도 비슷한 접근이 점점 중요해지고 있고요.

둘째, hls4ml은 오픈소스예요. GitHub에 공개되어 있고, 물리학뿐 아니라 의료 영상, 자율주행, 산업 센서 등 초저지연 추론이 필요한 모든 분야에서 활용할 수 있어요. 한국에서도 반도체 설계를 하시는 분들이나 임베디드 AI에 관심 있는 분들이라면 한번 살펴볼 만해요.

셋째, TinyML이라는 분야가 있는데요, 마이크로컨트롤러 같은 초소형 기기에서 머신러닝을 돌리는 연구 분야예요. CERN의 접근은 TinyML의 극단적인 사례라고 볼 수 있고, 이 분야가 앞으로 어떤 방향으로 발전할지 보여주는 좋은 선행 사례예요.

마무리

핵심 한줄: 때로는 가장 작은 모델이 가장 극한의 환경에서 빛나요. CERN은 수 마이크로초 안에 판단을 내려야 하는 문제를 "AI를 하드웨어로 만들어버리는" 방법으로 풀었어요.

여러분은 AI 모델의 크기를 줄여서 특정 환경에 최적화해본 경험이 있으신가요? 혹시 FPGA나 하드웨어 가속 쪽을 다뤄보신 분이 계시다면 경험을 공유해주세요!

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공