![[심층분석] 구글이 만든 'AI Edge Gallery', 내 폰에서 LLM을 돌리는 시대가 정말 왔다](/newsimg/7S9weIUSVoiB8D0i.jpg)

클라우드 없이, 내 손 안에서 AI가 돌아간다고?

요즘 AI 하면 ChatGPT, Claude, Gemini 같은 클라우드 기반 서비스를 먼저 떠올리잖아요. 인터넷에 연결해서 서버에 질문을 보내고, 서버가 답변을 만들어서 돌려보내주는 구조요. 그런데 이 방식에는 몇 가지 근본적인 한계가 있어요. 인터넷이 안 되면 못 쓰고, 내 데이터가 외부 서버로 나가니 프라이버시 걱정이 있고, 응답이 올 때까지 네트워크 지연(latency)도 생기죠.

그래서 업계에서는 "온디바이스 AI(On-Device AI)"라는 흐름이 점점 커지고 있어요. 이게 뭐냐면, AI 모델을 클라우드 서버가 아니라 내 스마트폰이나 노트북 같은 로컬 기기에서 직접 실행하는 거예요. 쉽게 말해서, AI가 내 주머니 속 폰 안에 통째로 들어있는 거죠.

구글이 이 흐름의 한가운데에서 공개한 프로젝트가 바로 Google AI Edge Gallery예요. 이름 그대로 온디바이스 ML(머신러닝)과 GenAI(생성형 AI) 활용 사례를 모아놓은 "갤러리"인데, 단순한 데모가 아니라 실제로 내 폰에 앱을 설치해서 오픈소스 LLM(대규모 언어 모델)을 바로 돌려볼 수 있게 만들어둔 프로젝트예요. Google Play와 App Store에서 바로 설치할 수 있고, APK 파일로도 제공하고 있어서 접근성도 좋아요.

특히 이번 업데이트에서는 구글의 최신 경량 모델인 Gemma 4 패밀리를 공식 지원하기 시작했는데요, 이게 왜 중요한지, 어떤 기능이 있는지, 그리고 한국 개발자에게 어떤 의미가 있는지 깊이 들여다보겠습니다.

온디바이스 AI, 왜 이렇게 뜨거운 걸까?

온디바이스 AI가 주목받는 배경을 먼저 이해하면 이 프로젝트의 가치가 더 잘 보여요.

프라이버시가 기본값이 된다

클라우드 AI를 쓰면 내 질문, 내 사진, 내 음성이 전부 외부 서버로 전송돼요. 물론 대부분의 서비스가 데이터를 안전하게 처리한다고 하지만, 민감한 업무 데이터나 개인 정보를 다룰 때는 아무래도 찜찜하잖아요. 온디바이스 AI는 데이터가 아예 기기 밖으로 나가지 않으니까, 프라이버시가 "설정"이 아니라 "구조"로 보장되는 거예요.

오프라인에서도 작동한다

비행기 안에서, 지하철 터널 안에서, 산속 캠핑장에서도 AI를 쓸 수 있어요. 인터넷 연결 상태와 무관하게 작동하니까, 네트워크 인프라가 불안정한 환경에서도 안정적으로 쓸 수 있죠.

응답이 빠르다

서버까지 왕복하는 네트워크 시간이 없으니, 모델 추론(inference) 자체만큼의 시간만 걸려요. 특히 실시간 번역이나 카메라 기반 인식 같은 기능에서는 이 차이가 체감될 정도로 크고요.

비용이 줄어든다

클라우드 AI API는 호출할 때마다 비용이 들어요. 토큰 단위로 과금되는 구조라서, 사용자가 많아지면 서버 비용이 기하급수적으로 늘어나죠. 온디바이스로 옮기면 이 비용을 대폭 줄일 수 있어요.

이런 이유들 때문에 애플(Apple Intelligence), 삼성(Galaxy AI), 퀄컴(Snapdragon AI), 구글(Gemini Nano, Gemma) 등 주요 테크 기업들이 앞다퉈 온디바이스 AI 생태계를 구축하고 있는 거예요.

Google AI Edge Gallery, 뭘 할 수 있나?

이 프로젝트의 핵심은 "오픈소스 LLM을 내 폰에서 바로 체험해볼 수 있는 앱"이에요. 그냥 데모 영상을 보여주는 게 아니라, 실제로 모델을 다운로드해서 내 기기에서 실행하는 거죠. 주요 기능들을 하나씩 살펴볼게요.

1. AI Chat with Thinking Mode (AI 채팅 + 사고 과정 보기)

일반적인 챗봇처럼 대화를 주고받을 수 있는 건 기본이고, 여기에 Thinking Mode라는 재밌는 기능이 추가됐어요. 이게 뭐냐면, AI가 답변을 만들어내는 과정을 단계별로 보여주는 거예요. 마치 수학 문제를 풀 때 풀이 과정을 보여주는 것처럼요.

예를 들어 "서울에서 부산까지 가는 가장 빠른 방법은?"이라고 물으면, 모델이 내부적으로 "교통수단 비교 → KTX 소요시간 확인 → 비행기 소요시간 확인 → 종합 판단"처럼 사고 단계를 밟아가는 걸 실시간으로 볼 수 있어요. 이 기능은 현재 Gemma 4 패밀리에서 지원되고 있어요.

이 기능이 개발자에게 특히 유용한 이유는, 모델이 왜 그런 답변을 했는지 디버깅할 수 있기 때문이에요. 프롬프트를 어떻게 바꿔야 더 좋은 결과가 나올지 힌트를 얻을 수 있죠.

2. Agent Skills (에이전트 스킬)

이 기능이 제가 보기에 가장 흥미로운 부분이에요. 단순히 채팅만 하는 게 아니라, LLM에 "도구(tool)"를 연결해서 실제로 뭔가를 할 수 있게 만드는 거거든요.

에이전트(Agent)라는 개념이 요즘 AI 업계에서 엄청 핫한데요, 이게 뭐냐면 쉽게 말해서 AI가 스스로 판단해서 필요한 도구를 골라 쓰는 것이에요. 예를 들어 "파리의 에펠탑 높이가 몇 미터야?"라고 물으면, AI가 "아, 이건 위키피디아에서 찾아봐야겠다"고 판단해서 위키피디아 도구를 호출하고, 그 결과를 가져와서 정리해주는 식이에요.

AI Edge Gallery에서는 위키피디아 검색, 인터랙티브 지도, 시각적 요약 카드 같은 도구들이 기본 제공되고, URL로 커스텀 스킬을 로드하거나 GitHub Discussions에서 커뮤니티가 만든 스킬을 가져다 쓸 수도 있어요. 이건 마치 브라우저 확장 프로그램처럼 AI의 능력을 모듈 방식으로 확장할 수 있다는 뜻이에요.

3. Ask Image (이미지 질문)

멀티모달(multimodal)이라는 건, 텍스트뿐만 아니라 이미지, 음성 같은 여러 종류의 입력을 함께 처리할 수 있다는 뜻이에요. Ask Image 기능을 쓰면 카메라로 사진을 찍거나 갤러리에서 사진을 골라서, 그 사진에 대해 질문할 수 있어요.

"이 식물 이름이 뭐야?", "이 영수증에서 총 금액이 얼마야?", "이 에러 메시지가 뭘 의미하는 거야?" 같은 질문을 사진과 함께 던질 수 있는 거죠. 이 모든 게 서버 전송 없이 폰 안에서 처리된다는 게 핵심이에요.

4. Audio Scribe (음성 기록)

음성을 텍스트로 변환하는 기능인데요, 역시 온디바이스로 동작해요. 회의 녹음을 텍스트로 바꾸거나, 외국어 음성을 실시간 번역하는 데 쓸 수 있어요. 인터넷 없이도 되니까 보안이 중요한 회의에서도 편하게 쓸 수 있겠죠.

5. Prompt Lab (프롬프트 실험실)

다양한 프롬프트를 테스트해볼 수 있는 전용 공간이에요. 개발자가 프롬프트 엔지니어링을 할 때, 같은 질문을 여러 방식으로 바꿔보면서 어떤 프롬프트가 더 좋은 결과를 내는지 실험할 수 있어요. 이걸 클라우드 API로 하면 매번 비용이 드는데, 로컬에서 하면 무제한으로 테스트할 수 있으니까 정말 편리하죠.

Gemma 4, 온디바이스 AI의 게임체인저

이번 업데이트의 주인공은 단연 Gemma 4예요. Gemma는 구글이 공개한 오픈소스 경량 AI 모델 시리즈인데, Gemini의 기술을 기반으로 하되 크기를 줄여서 개인 기기에서도 돌릴 수 있게 만든 모델이에요.

비유하자면, Gemini가 대형 트럭이라면 Gemma는 경차예요. 트럭만큼 짐을 못 싣지만, 좁은 골목도 다니고 기름도 적게 들고 주차도 쉽죠. 마찬가지로 Gemma는 거대 모델만큼의 성능은 아니지만, 스마트폰이라는 제한된 환경에서 효율적으로 돌아가도록 최적화되어 있어요.

Gemma 4가 특별한 이유는 몇 가지가 있어요:

- 추론(Reasoning) 능력 강화: 단순 질문-응답을 넘어서, 논리적으로 생각하고 단계적으로 문제를 풀 수 있어요. Thinking Mode와 결합하면 그 과정을 눈으로 확인할 수 있고요.

- 멀티모달 지원: 텍스트만이 아니라 이미지도 이해할 수 있어서, Ask Image 같은 기능이 가능해진 거예요.

- 효율적인 크기: 모바일 기기의 RAM과 스토리지 제약 안에서도 의미 있는 성능을 낼 수 있도록 설계됐어요.

- Android: 앱의 네이티브 코드가 들어있어요

- model_allowlists: 사용 가능한 모델 목록을 JSON으로 관리해요. 어떤 모델이 이 앱과 호환되는지 정의하는 거죠

- skills: 에이전트 스킬 모듈이 들어있어요. 위키피디아 검색, 지도 연동 같은 도구들이 여기 정의돼요

- 고객 상담 앱: 인터넷이 불안정한 매장에서도 작동하는 FAQ 챗봇

- 현장 점검 앱: 공장이나 건설 현장에서 사진을 찍으면 이상 징후를 판별하는 기능

- 의료 기록 앱: 환자 데이터가 외부로 나가면 안 되는 환경에서의 음성-텍스트 변환

- 기기 호환성: 모든 폰에서 잘 되는 건 아니에요. 최소 8GB RAM 이상의 비교적 최신 기기가 필요해요

- 모델 다운로드 크기: 양자화된 모델이라도 수백 MB에서 수 GB까지 될 수 있어서, 저장 공간과 초기 다운로드 시간을 고려해야 해요

- 배터리 소모: AI 추론은 연산량이 많아서 배터리를 꽤 소모해요. 장시간 사용하는 기능이라면 전력 관리 전략도 함께 고민해야 해요

- 성능 한계: 클라우드 모델 대비 응답 품질이 낮을 수 있어요. 온디바이스가 적합한 유스케이스와 아닌 유스케이스를 구분하는 게 중요해요

경쟁 기술과의 비교: 온디바이스 AI 전쟁

온디바이스 AI 영역에서 구글만 뛰고 있는 건 아니에요. 주요 경쟁자들과 비교해볼게요.

Apple Intelligence vs Google AI Edge

애플은 자사 기기에 AI를 통합하는 데 집중하고 있어요. 시리(Siri) 강화, 이미지 생성, 텍스트 요약 같은 기능을 iOS/macOS에 녹여넣고 있죠. 하지만 애플의 접근은 폐쇄적이에요. 애플이 정한 기능만 쓸 수 있고, 개발자가 직접 모델을 바꾸거나 커스터마이징하기 어려워요.

반면 Google AI Edge Gallery는 오픈소스 기반이에요. 어떤 모델을 쓸지, 어떤 스킬을 붙일지를 개발자가 자유롭게 결정할 수 있죠. 이건 마치 애플이 완성된 가전제품을 파는 거라면, 구글은 부품과 설계도를 공개해서 "너희가 직접 만들어봐"라고 하는 것과 비슷해요.

llama.cpp / Ollama vs AI Edge Gallery

오픈소스 진영에서 온디바이스 LLM 실행 도구로 유명한 것들이 있어요. llama.cpp는 Meta의 Llama 모델을 C/C++로 최적화해서 로컬에서 돌리는 프로젝트이고, Ollama는 이걸 좀 더 쉽게 쓸 수 있게 포장한 도구예요. 이 둘은 주로 PC나 Mac에서 쓰이는데요.

AI Edge Gallery의 차별점은 모바일 최적화에 있어요. llama.cpp도 모바일에서 돌릴 수는 있지만, 직접 빌드하고 설정하는 과정이 꽤 복잡해요. AI Edge Gallery는 앱스토어에서 다운로드 한 번이면 바로 쓸 수 있으니까, 진입 장벽이 훨씬 낮죠.

또한 AI Edge Gallery는 구글의 LiteRT(구 TensorFlow Lite) 런타임을 활용해서 Android 기기의 GPU와 NPU(Neural Processing Unit, 신경망 처리 전용 칩)를 효율적으로 활용해요. 쉽게 말해서 폰 안에 있는 AI 전용 하드웨어를 제대로 활용한다는 뜻이에요.

삼성 Galaxy AI vs AI Edge Gallery

삼성의 Galaxy AI는 통역, 요약, 이미지 편집 같은 기능을 갤럭시 기기에 내장해서 제공해요. 사용자 입장에서는 편리하지만, 개발자 입장에서는 삼성이 정해준 기능만 쓸 수 있다는 제약이 있어요.

AI Edge Gallery는 개발자가 다양한 오픈소스 모델을 자유롭게 실험하고, 자기만의 기능을 만들 수 있는 플레이그라운드(놀이터) 역할을 해요. 프로덕션 앱에 바로 탑재하기보다는, 어떤 모델이 내 유스케이스에 맞는지 평가하고 프로토타이핑하는 데 최적화된 도구인 거죠.

| 구분 | Apple Intelligence | Galaxy AI | llama.cpp/Ollama | AI Edge Gallery |

|------|-------------------|-----------|-----------------|----------------|

| 플랫폼 | Apple 기기 전용 | Galaxy 기기 전용 | PC/Mac 중심 | Android + iOS |

| 오픈소스 | X | X | O | O |

| 커스터마이징 | 제한적 | 제한적 | 높음 | 높음 |

| 진입 장벽 | 낮음 | 낮음 | 중간~높음 | 낮음 |

| 모델 선택 | 고정 | 고정 | 자유 | 자유 |

| 에이전트 기능 | 제한적 | 제한적 | 직접 구현 | 기본 제공 |

기술적으로 들여다보기: 어떻게 폰에서 LLM이 돌아갈까?

"폰에서 AI 모델을 돌린다"는 말이 잘 와닿지 않을 수 있어요. 조금 더 구체적으로 설명해볼게요.

LLM은 기본적으로 수십억 개의 파라미터(매개변수)로 이루어져 있어요. GPT-4 같은 모델은 수천억 개 수준이라 일반 PC에서도 돌리기 힘들죠. 하지만 Gemma 같은 경량 모델은 파라미터 수를 2B(20억)~9B(90억) 수준으로 줄여서, 최신 스마트폰의 RAM(8~16GB)으로도 감당할 수 있게 만들었어요.

여기에 양자화(Quantization)라는 기술이 핵심적으로 쓰여요. 양자화가 뭐냐면, 모델의 각 파라미터를 표현하는 데 쓰는 숫자의 정밀도를 낮추는 거예요. 비유하자면, 고화질 사진(32비트)을 적당한 화질(4비트)로 압축하는 것과 비슷해요. 화질이 약간 떨어지지만 파일 크기가 확 줄어들어서 폰에 저장하고 처리할 수 있게 되는 거죠.

또한 구글은 LiteRT 런타임을 통해 Android 기기의 하드웨어 가속기를 활용해요. 최신 스마트폰 칩(퀄컴 Snapdragon, 삼성 Exynos, 구글 Tensor 등)에는 AI 연산 전용 칩인 NPU가 들어있는데, 일반적인 CPU보다 AI 연산을 훨씬 빠르고 전력 효율적으로 처리할 수 있어요. AI Edge Gallery는 이 NPU를 최대한 활용하도록 설계되어 있어요.

프로젝트 구조를 보면 Android 디렉토리, model_allowlists 디렉토리, skills 디렉토리 등으로 나뉘어 있는데요:

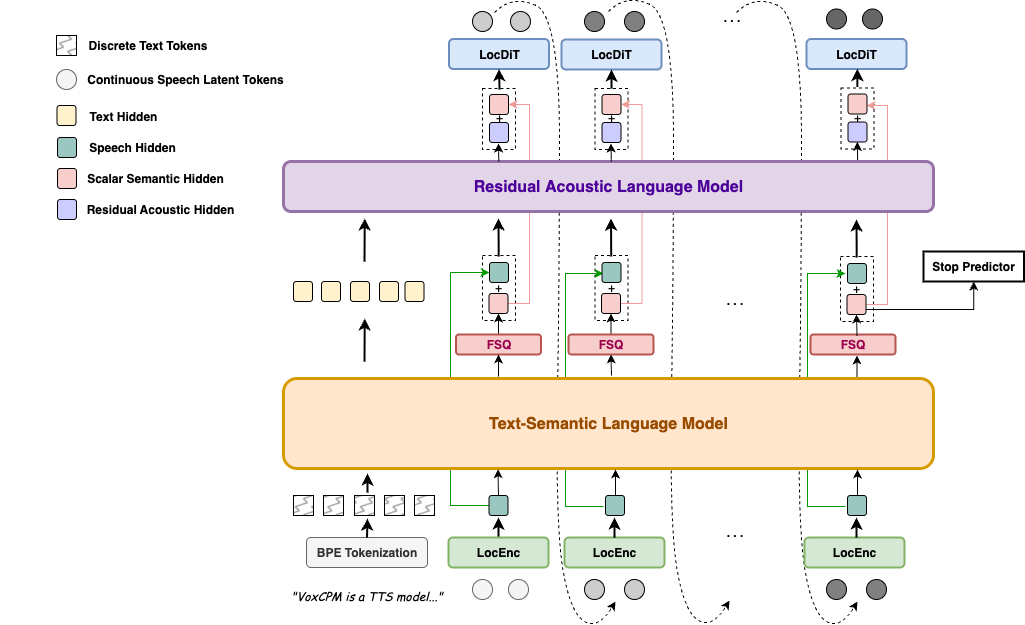

Function Calling(함수 호출) 가이드도 별도로 제공하고 있는데, 이건 LLM이 외부 도구를 호출하는 방법을 설명하는 문서예요. 쉽게 말해서 AI가 "이 질문에 답하려면 위키피디아를 검색해야겠어"라고 판단하면, 미리 정의된 함수를 호출해서 결과를 가져오는 구조예요.

한국 개발자에게 주는 시사점

1. 프로토타이핑 도구로 바로 써보세요

"우리 서비스에 온디바이스 AI를 넣으면 어떨까?"라는 아이디어가 있다면, AI Edge Gallery를 설치해서 바로 테스트해볼 수 있어요. 예를 들어:

이런 시나리오들을 클라우드 API 없이 시뮬레이션해볼 수 있어요.

2. 에이전트 스킬 개발에 참여해보세요

프로젝트가 GitHub Discussions를 통해 커뮤니티 스킬 공유를 장려하고 있어요. 한국어에 특화된 스킬을 만들어서 공유하면 좋은 오픈소스 기여 경험이 될 수 있어요. 예를 들어 네이버 검색 연동, 한국어 맞춤법 검사, 한국 지도 서비스 연동 같은 스킬이요.

3. 한국어 성능 테스트

온디바이스 모델의 한국어 성능은 클라우드 모델에 비해 아직 부족한 경우가 많아요. Gemma 4가 한국어를 얼마나 잘 처리하는지 직접 테스트해보고, 부족한 부분이 있다면 파인튜닝(fine-tuning, 특정 데이터로 모델을 추가 학습시키는 것) 가능성을 탐색해볼 수 있어요.

4. 학습 로드맵 제안

온디바이스 AI에 입문하고 싶다면 이런 순서를 추천해요:

1. AI Edge Gallery 앱 설치 → 기본 기능 체험 (10분)

2. Prompt Lab에서 다양한 프롬프트 실험 (1시간)

3. 기존 Agent Skill 코드 읽어보기 (GitHub skills 디렉토리)

4. 간단한 커스텀 스킬 만들어보기

5. model_allowlist.json 구조 이해 → 다른 오픈소스 모델 연동 시도

5. 도입 시 주의할 점

앞으로 어떤 변화가 올까?

온디바이스 AI는 아직 초기 단계이지만, 방향은 분명해요. 몇 가지 전망을 해볼게요.

첫째, 하이브리드 AI가 표준이 될 거예요. 간단한 작업은 온디바이스에서 처리하고, 복잡한 작업만 클라우드로 보내는 하이브리드 구조가 보편화될 거예요. 마치 브라우저가 캐시를 활용하는 것처럼, AI도 로컬과 클라우드를 상황에 맞게 오가는 거죠.

둘째, 모델 경량화 기술이 더 발전할 거예요. 지금은 20억~90억 파라미터 모델이 폰에서 돌아가는 수준인데, 양자화와 지식 증류(Knowledge Distillation, 큰 모델의 지식을 작은 모델로 옮기는 기술) 같은 기술이 발전하면 더 강력한 모델도 폰에서 돌릴 수 있게 될 거예요.

셋째, 에이전트 생태계가 커질 거예요. AI Edge Gallery의 Agent Skills처럼, 온디바이스 LLM에 다양한 도구를 연결하는 에이전트 패턴이 모바일 앱 개발의 새로운 패러다임이 될 수 있어요. 지금의 앱스토어처럼 "스킬 스토어"가 생길 수도 있겠죠.

넷째, 프라이버시 규제와 맞물려 성장할 거예요. EU의 GDPR, 한국의 개인정보보호법 같은 규제가 점점 강화되면서, 데이터를 외부로 보내지 않는 온디바이스 AI가 규제 준수의 가장 확실한 방법으로 자리잡을 가능성이 높아요.

마무리: 내 폰이 AI 연구소가 되는 시대

Google AI Edge Gallery는 단순한 데모 앱이 아니에요. 온디바이스 AI의 현재 수준을 직접 체험하고, 가능성을 탐색하고, 나아가 직접 개발에 참여할 수 있는 열린 플랫폼이에요. 구글이 Gemma 4와 함께 이런 도구를 오픈소스로 공개한 건, 온디바이스 AI 생태계를 함께 키우겠다는 의지의 표현이기도 하고요.

특히 한국은 세계 최고 수준의 스마트폰 보급률과 모바일 앱 생태계를 갖고 있잖아요. 온디바이스 AI가 보편화되면 한국 개발자들이 만들어낼 수 있는 혁신의 영역이 훨씬 넓어질 거예요.

여러분에게 질문을 던져볼게요. 여러분이 만들고 있는 서비스에서, 인터넷 없이 폰 안에서만 처리되면 좋겠다 싶은 AI 기능이 있나요? 아니면 이미 온디바이스 모델을 실험해본 경험이 있다면, 어떤 점이 가장 아쉬웠는지도 궁금해요. 댓글로 이야기 나눠봐요!

🔗 출처: GitHub

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공