비싼 모델이 오히려 더 저렴하다? Opus로 LLM 비용을 줄인 역설적인 이야기

## 비싼 모델을 썼는데 비용이 줄었다고요? 보통 LLM(대규모 언어 모델, 우리가 흔히 말하는 GPT나 Claude 같은 AI 모델이에요)을 서비스에 붙일 때 가장 먼저 고민하는 게 비용이거든요. 토큰 단위로 돈이 빠져나가다 보니, 사용자가 늘...

ChatGPT는 어떻게 광고를 노출하나: 어트리뷰션 루프의 전말

## 검색 광고를 닮았지만 다른 무언가 많은 사람들이 "ChatGPT가 광고를 한다"는 말을 들었을 때, 처음엔 옛날 검색엔진처럼 결과 위에 "Sponsored" 배너가 뜨는 모습을 떠올려요. 그런데 실제로 OpenAI가 굴리고 있는 광고 모델은...

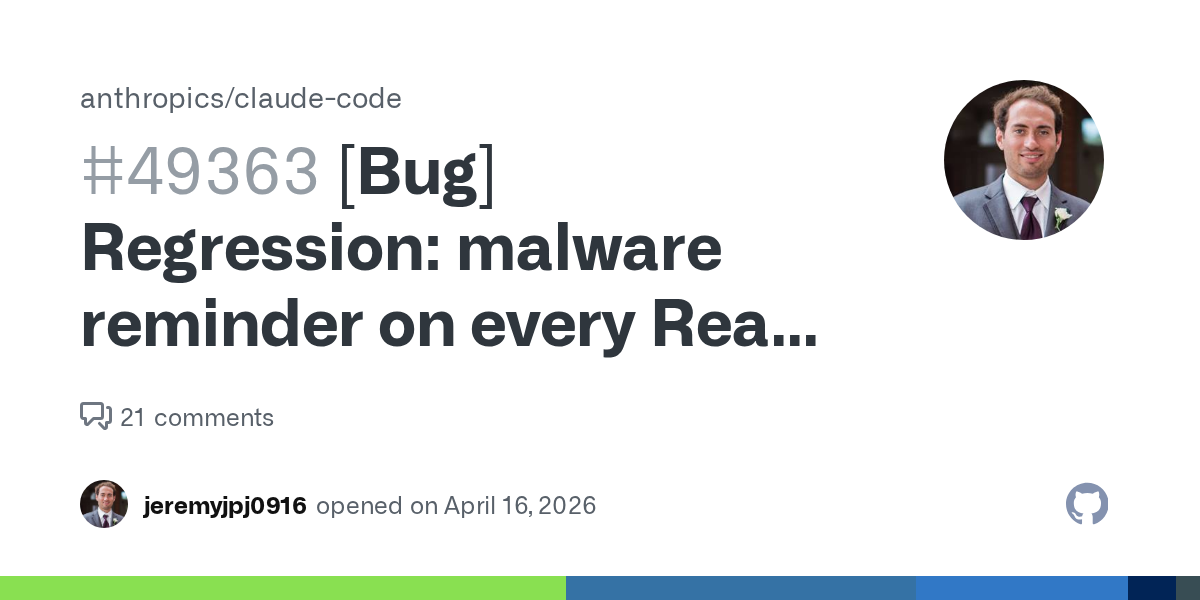

Claude Code 시스템 프롬프트 버그: 사용자 비용을 갉아먹는 조용한 문제

## 무슨 일이 있었나요 Anthropic의 공식 코딩 에이전트인 **Claude Code**에서 시스템 프롬프트 관련 버그가 보고됐어요. 이슈 트래커에 올라온 내용을 보면, 시스템 프롬프트가 의도치 않게 부풀려지거나 중복돼서 **사용자가 쓰지도...

AI가 의료 오픈소스에서 38개 CVE를 찾아냈다, OpenEMR 사태로 본 자동화 보안 감사의 현재

## 의료 소프트웨어에서 발견된 38개의 보안 구멍 보안 회사 **AISLE**이 의료용 오픈소스 EMR(전자의무기록) 시스템인 **OpenEMR**에서 무려 **38개의 CVE(공식 보안 취약점)** 를 발견했다고 발표했어요. CVE가 뭐냐면,...

테크 뉴스를 읽는 당신,

직접 만들어볼 준비 되셨나요?

17가지 수익 모델 실습 · 144+ 강의 · 자동화 소스코드 제공

macOS 자동화의 새 지평: 커서를 뺏지 않고 앱을 백그라운드에서 조작하기

## "자동화 돌릴 때 컴퓨터 못 쓰는 문제" 드디어 풀리나 macOS에서 GUI 자동화를 해본 분들은 이 답답함을 알 거예요. AppleScript든 Selenium이든 자동화 스크립트가 돌아가는 동안에는 마우스 커서가 자기 마음대로 움직이고,...

Intel Arc Pro B70, 워크스테이션 GPU 시장에 던지는 도전장

## Intel이 워크스테이션 GPU를 진지하게 들고 나왔어요 그동안 워크스테이션용 GPU 시장은 거의 NVIDIA의 RTX A/Ada 시리즈와 일부 AMD Radeon Pro가 점유해 왔어요. 게이밍 GPU와 달리 워크스테이션 GPU는 드라이버...

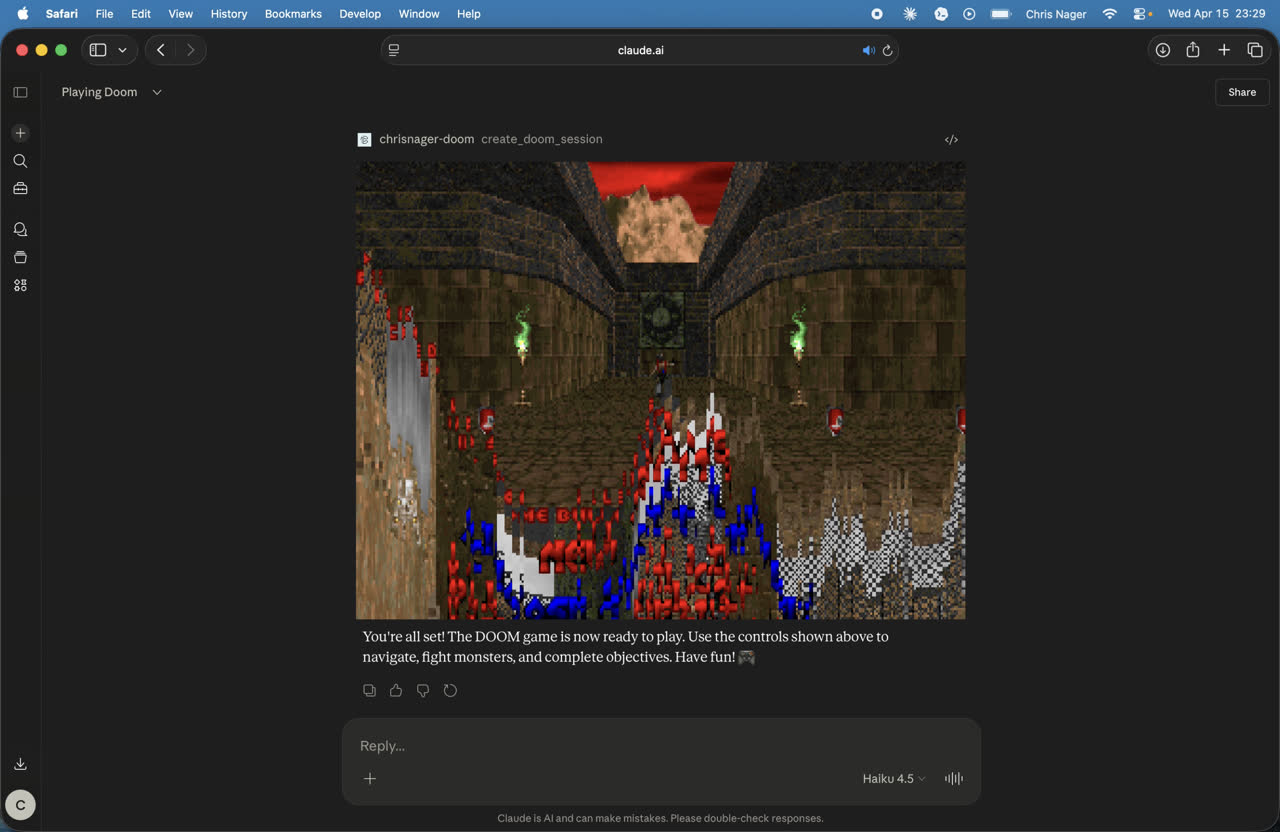

ChatGPT와 Claude 안에서 DOOM을 플레이한다 - MCP의 진짜 가능성을 보여준 실험

## 챗봇 안에서 게임을 한다고요? Chris Nager라는 개발자가 정말 재미있는 걸 만들었어요. **DOOM(둠)을 ChatGPT와 Claude 안에서 직접 플레이할 수 있는 MCP 앱**을 공개한 거예요. 1993년에 나온 그 전설의 FPS...

Ghostty가 GitHub을 떠난다 - Mitchell Hashimoto가 직접 밝힌 이유

## 무슨 일이 벌어진 건가요 HashiCorp의 공동 창업자이자 Terraform, Vagrant, Vault 같은 인프라 도구의 아버지로 불리는 Mitchell Hashimoto가 자신이 만든 터미널 에뮬레이터 **Ghostty**를 GitHub...

1930년 이전 책으로만 학습한 13B 모델 'Talkie' - 시간을 거슬러 만든 LLM

## 거꾸로 가는 LLM 요즘 LLM(거대 언어 모델) 얘기 들으면 GPT-5, Claude, Gemini, 죄다 최신 인터넷 데이터로 훈련해서 "어제 나온 뉴스도 알 정도"라는 게 자랑이잖아요. 그런데 일부러 거꾸로 가는 프로젝트가 등장했어요....

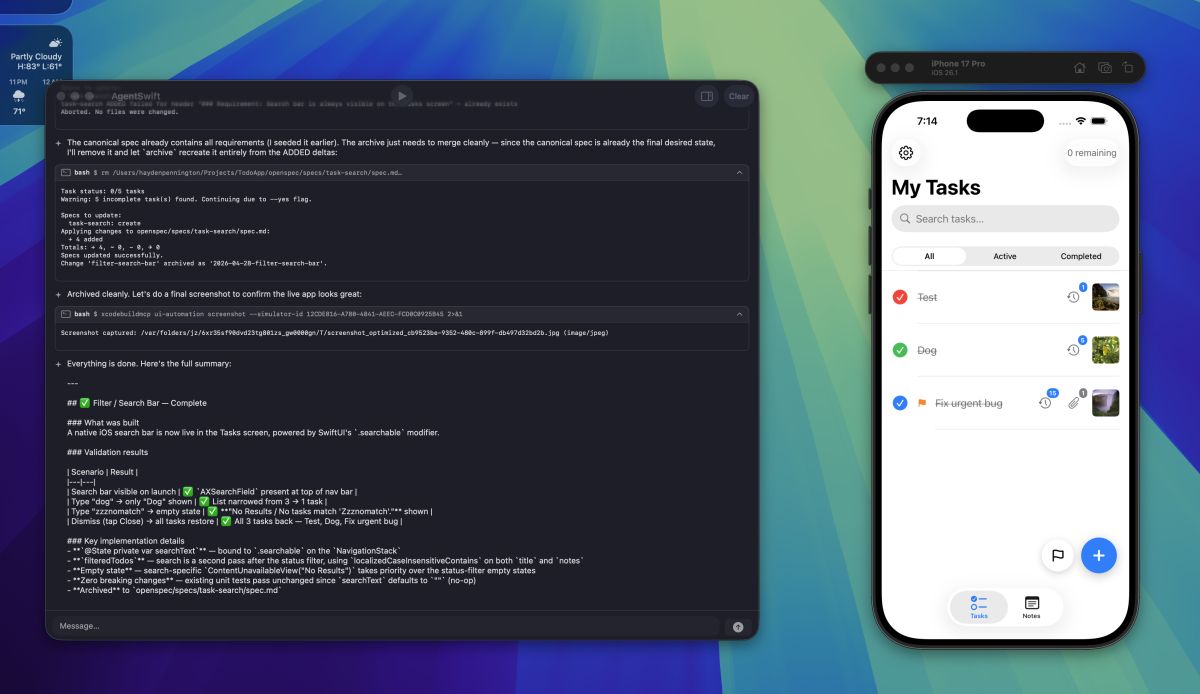

AgentSwift 공개 — AI가 직접 iOS 앱을 만들어주는 오픈소스 빌더 에이전트

## "앱 하나 만들어줘"가 진짜로 통하는 시대 ChatGPT나 Cursor에 "To-Do 앱 만들어줘" 했더니 코드가 좌라락 나오는 경험, 다들 한 번쯤 해보셨을 거예요. 그런데 그 코드가 정말로 빌드되고, 시뮬레이터에서 돌아가고, 디자인이 그...

RAM이 많다고 다 좋을까? 메모리 풍요가 만든 새로운 저주

## 메모리가 남아돌면 뭐가 문제일까 예전엔 "RAM 4GB도 사치"라고 하던 시절이 있었어요. 지금은 노트북도 16GB, 32GB가 기본이고 워크스테이션이라면 64GB, 128GB도 어렵지 않게 만나죠. 그런데 게임 개발자이자 글 잘 쓰기로 유명한...

GitHub Copilot, 정액제에서 사용량 기반으로 - 개발자 지갑에 무슨 일이?

## 정액제의 시대가 끝났습니다 2026년 4월, GitHub이 큰 발표를 하나 했어요. **Copilot의 요금 체계를 사용량 기반(usage-based billing)으로 전환**한다는 내용이에요. 그동안 우리는 월 10달러 또는 19달러를 ...

Super ZSNES 등장: GPU로 돌리는 SNES 에뮬레이터, 픽셀 단위 렌더링 시대 종료?

## 추억의 슈퍼 패미콤이 GPU를 만났어요 90년대에 슈퍼 패미콤(SNES)으로 마리오, 젤다, 파이널 판타지 했던 분들 많죠? 그 시절 게임을 PC에서 돌릴 수 있게 해준 전설의 에뮬레이터가 바로 ZSNES였어요. 1997년부터 개발돼서 20...

스스로 도구를 만들어 쓰는 AI 에이전트, Tendril은 무엇이 다른가

## 도구를 만들어 쓰는 에이전트? AI 에이전트 이야기가 정말 많이 나오죠. "에이전트"라는 게 뭐냐면, LLM이 그냥 답을 뱉는 게 아니라 **여러 도구(tool)를 직접 호출하면서 일을 진행하는 시스템**을 말해요. 예를 들어 "우리 회사 매출...

"그냥 Lean 쓰면 안 돼요?"라는 질문에 Isabelle 진영이 내놓은 진지한 대답

## 정리 증명기 세계의 작은 논쟁 수학을 컴퓨터로 증명하는 정리 증명기(theorem prover)라는 분야가 있어요. 종이와 연필로 쓰던 수학 증명을 형식 언어로 옮겨 적으면, 컴퓨터가 한 줄 한 줄 검증해서 "이 증명에 빈틈이 없다"는 걸 보장...

TurboQuant를 처음부터 차근차근, LLM 양자화의 새로운 접근법

## LLM은 왜 자꾸 "가벼워져야" 할까 요즘 우리가 쓰는 대형 언어 모델(LLM)은 어마어마하게 크잖아요. 파라미터가 수백억, 수천억 개에 달하다 보니 GPU 메모리에 통째로 올리는 것도 쉽지 않아요. 그래서 등장한 게 "양자화(Quantizat...

AI에게 '망각'을 가르치다 — 생물학적 기억 감쇠를 적용한 메모리 시스템

## 사람처럼 잊어버리는 AI, 왜 필요할까요? 요즘 ChatGPT나 Claude 같은 AI에게 '내가 누구인지', '뭘 좋아하는지'를 기억시키려고 메모리(Memory) 기능을 쓰는 분들 많으실 거예요. 그런데 이 메모리, 한 가지 큰 문제가 있...

구글이 'AI 칩'으로 승부수를 던졌다 - 클라우드 만년 3등 탈출 가능할까

## 갑자기 분위기가 바뀌었어요 클라우드 시장 얘기를 할 때 보통은 AWS와 Microsoft Azure 두 회사를 먼저 떠올리잖아요. 구글 클라우드(GCP)는 항상 "3등" 자리에 머물러 있었거든요. 그런데 요즘 분위기가 묘하게 바뀌고 있어요. 구...

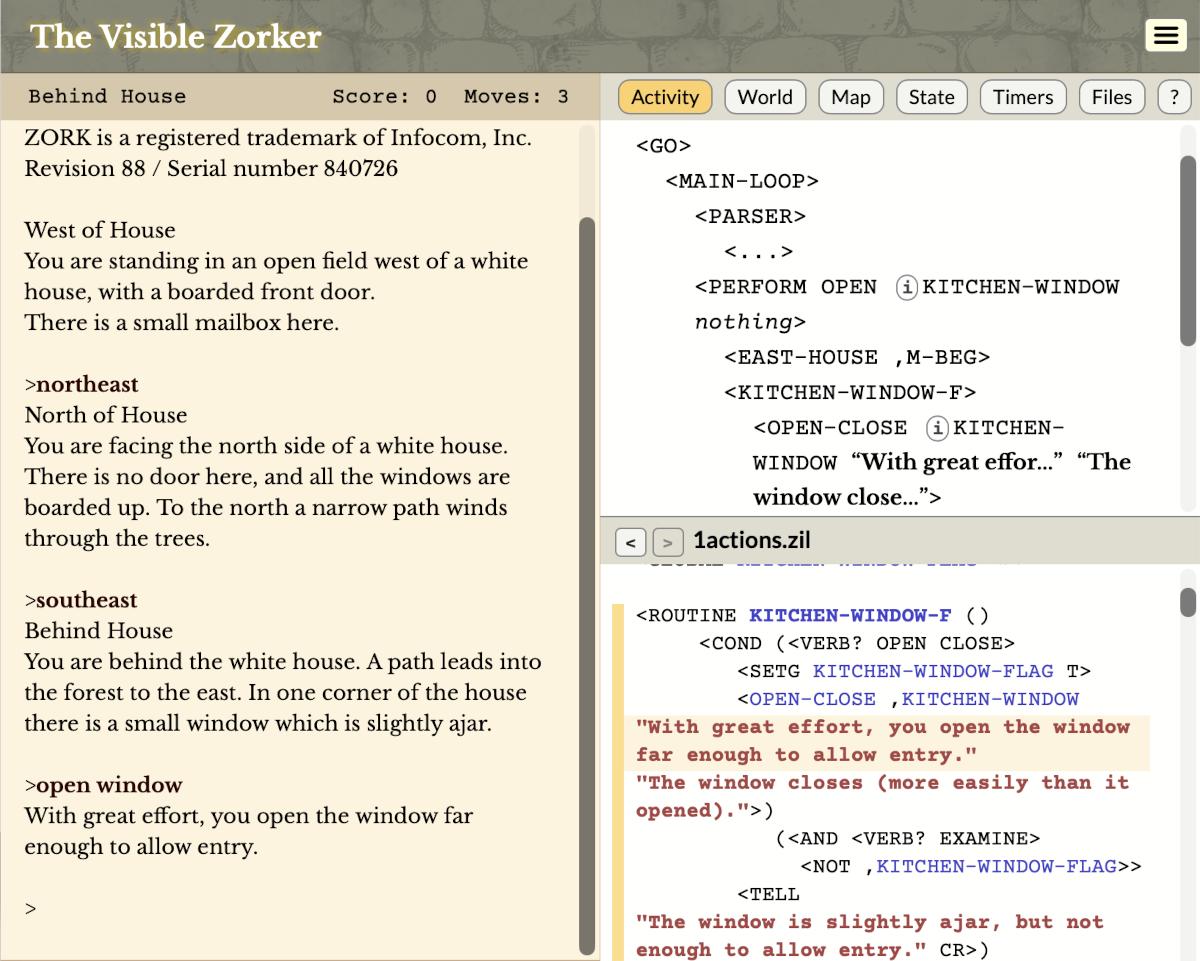

코드로 보는 1980년 전설의 게임, '비저블 조커(Visible Zorker)'가 공개됐어요

## Zork가 뭐예요, 왜 중요해요 게임 좀 오래 해본 분이라면 'Zork'라는 이름을 들어보셨을지도 몰라요. 1980년에 Infocom이라는 회사가 만든 텍스트 어드벤처 게임인데, 화면에 그래픽이 하나도 없고 모든 게 글자로만 진행돼요. '집...

OpenAI가 SWE-bench Verified를 버린 이유 - AI 코딩 평가의 한계가 드러나다

## 벤치마크가 "포화"되면 생기는 일 OpenAI가 자사 블로그에 흥미로운 글을 올렸어요. 한동안 AI 코딩 능력의 표준 척도로 쓰이던 **SWE-bench Verified**라는 벤치마크를, 더 이상 자기들 모델 평가의 주요 지표로 쓰지 않겠다는...