트랜스포머, 왜 회로 수준에서 이해해야 할까

GPT, Claude, Gemini 같은 대형 언어모델의 핵심 아키텍처인 트랜스포머(Transformer)는 놀라운 성능을 보여주고 있지만, 정작 "왜 이렇게 동작하는지"에 대한 이해는 여전히 부족합니다. 모델이 특정 답을 내놓을 때, 내부에서 어떤 연산이 일어나고 있는지를 설명하는 것은 전혀 다른 차원의 문제입니다. 이것이 바로 기계적 해석가능성(Mechanistic Interpretability) 분야가 풀려는 핵심 질문이며, 최근 Connor J. Davis가 정리한 "트랜스포머 회로에 대한 직관" 글이 이 분야에 입문하려는 개발자들에게 좋은 길잡이 역할을 합니다.

기계적 해석가능성이란, 신경망을 하나의 거대한 블랙박스로 취급하는 대신, 내부의 개별 뉴런과 어텐션 헤드가 어떤 "회로(circuit)"를 형성하여 특정 기능을 수행하는지를 역공학하는 접근법입니다. 마치 전자회로의 부품 하나하나를 분석해서 전체 기능을 이해하듯, 트랜스포머의 구성 요소를 하나씩 분석하는 것입니다.

잔차 스트림이라는 핵심 직관

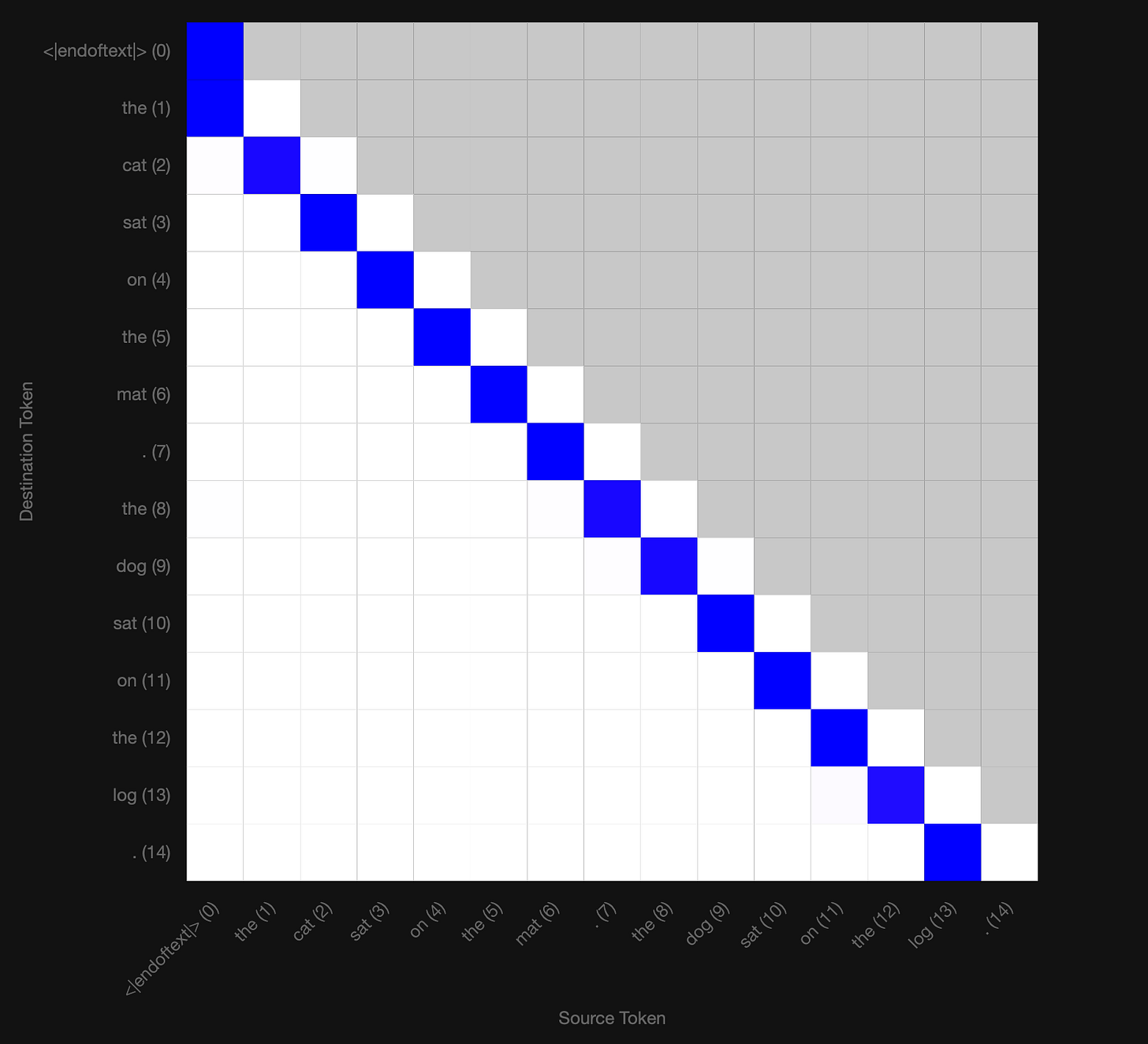

트랜스포머 회로를 이해하는 데 가장 중요한 직관 중 하나는 잔차 스트림(Residual Stream) 개념입니다. 트랜스포머의 각 레이어는 입력을 받아 처리한 결과를 원래 입력에 "더하는" 구조로 되어 있습니다. 이 잔차 연결(residual connection) 구조를 "스트림"으로 바라보면, 각 레이어의 어텐션 헤드와 MLP 블록은 이 스트림에서 정보를 읽고(read), 처리 결과를 다시 스트림에 쓰는(write) 독립적인 모듈로 이해할 수 있습니다.

이것이 왜 중요할까요? 기존에는 트랜스포머를 "레이어 1 → 레이어 2 → ... → 레이어 N"으로 순차적으로 처리되는 파이프라인으로 생각하기 쉬웠습니다. 하지만 잔차 스트림 관점에서 보면, 각 어텐션 헤드는 상대적으로 독립적으로 동작하며 서로 다른 "역할"을 수행합니다. 어떤 헤드는 문법적 관계를 추적하고, 어떤 헤드는 이전 토큰의 위치 정보를 복사하며, 어떤 헤드는 특정 패턴을 감지합니다.

수퍼포지션과 다의적 뉴런 문제

트랜스포머 회로 연구에서 가장 도전적인 부분 중 하나는 수퍼포지션(Superposition) 현상입니다. 인간이 이해하는 개념의 수는 모델의 뉴런 수보다 훨씬 많기 때문에, 모델은 하나의 뉴런에 여러 개념을 중첩해서 인코딩합니다. 이것은 마치 FM 라디오에서 여러 방송국이 서로 다른 주파수를 사용해 같은 전파 공간을 공유하는 것과 비슷합니다.

이 수퍼포지션 문제를 해결하기 위해 등장한 것이 희소 오토인코더(Sparse Autoencoder, SAE) 기법입니다. SAE는 모델의 내부 표현을 더 높은 차원의 희소한(sparse) 공간으로 확장하여, 중첩된 개념들을 분리해냅니다. Anthropic의 연구팀이 Claude 모델에서 "골든게이트 브릿지"나 "코드 보안" 같은 구체적인 개념에 대응하는 특성(feature)을 발견한 것이 대표적인 성과입니다.

실제로 발견된 회로들

이런 분석 도구를 활용해 연구자들이 실제로 발견한 회로들이 있습니다. 대표적인 예가 간접 객체 식별(Indirect Object Identification, IOI) 회로입니다. "Alice가 Bob에게 공을 건넸다. 그녀가 공을 건넨 사람은"이라는 문장에서 모델이 "Bob"을 정확히 예측하려면, 주어와 간접 목적어를 구분하고, 반복된 이름을 억제하는 등 여러 단계의 추론이 필요합니다. 연구자들은 이 과정을 수행하는 구체적인 어텐션 헤드 조합을 식별하는 데 성공했습니다.

이런 회로 수준의 이해가 쌓이면, 단순히 "모델이 이상한 답을 내놨다"를 넘어서 "모델의 어떤 회로가 오작동했는지"를 진단할 수 있는 가능성이 열립니다.

한국 개발자에게 주는 시사점

AI 안전성(AI Safety)과 해석가능성은 단순한 학술 연구를 넘어 실무적으로도 중요해지고 있습니다. EU AI Act나 한국의 AI 기본법 논의에서도 고위험 AI 시스템에 대한 설명가능성 요구가 포함되어 있어, 모델이 왜 특정 결정을 내렸는지 설명할 수 있는 능력은 규제 준수의 핵심이 될 수 있습니다.

또한 LLM 기반 서비스를 운영하는 한국 스타트업이나 기업에서도, 모델의 내부 동작을 이해하면 프롬프트 엔지니어링이나 파인튜닝을 더 체계적으로 접근할 수 있습니다. "왜 이 프롬프트가 잘 동작하는지" 직관적으로 이해하는 것과 맹목적으로 시행착오를 반복하는 것은 생산성에서 큰 차이를 만듭니다.

트랜스포머 회로 연구는 아직 초기 단계이지만, 앞으로 AI 시스템의 신뢰성과 제어가능성을 높이는 핵심 기반 기술이 될 것입니다. 이 분야에 관심이 있다면 Anthropic의 "Transformer Circuits Thread" 시리즈와 Neel Nanda의 TransformerLens 라이브러리를 함께 살펴보는 것을 추천합니다.

마무리

핵심 한줄: 트랜스포머를 블랙박스가 아닌 분석 가능한 회로의 집합으로 바라보는 관점이, AI를 이해하고 제어하는 다음 단계의 열쇠입니다.

여러분은 LLM을 사용하면서 "왜 이런 답이 나왔지?"라고 궁금했던 경험이 있으신가요? 해석가능성 연구가 실무에서 어떤 가치를 줄 수 있을지 의견을 나눠보면 좋겠습니다.

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공