로컬 AI 추론의 한계를 다시 쓰다

최근 AI 모델의 크기는 기하급수적으로 커지고 있지만, 대부분의 개발자가 실제로 이런 거대 모델을 로컬에서 돌려볼 기회는 거의 없었습니다. 수천억 개의 파라미터를 가진 모델을 실행하려면 수백 GB의 VRAM을 갖춘 GPU 클러스터가 필요하다는 것이 상식이었죠. 그런데 Flash-MoE라는 프로젝트가 이 상식에 도전합니다. 48GB RAM을 탑재한 Mac에서 무려 3970억(397B) 파라미터 규모의 모델을 실행할 수 있다고 합니다.

이것이 어떻게 가능한지 이해하려면, 먼저 MoE(Mixture of Experts) 아키텍처가 무엇인지 알아야 합니다.

MoE 아키텍처란 무엇이고, 왜 중요한가

MoE는 "전문가 혼합" 모델이라는 뜻으로, 하나의 거대한 모델 안에 여러 개의 "전문가(Expert)" 서브네트워크를 두는 아키텍처입니다. 핵심은 모든 입력에 대해 모든 파라미터가 활성화되지 않는다는 점입니다. 각 토큰이 들어오면 라우터(Router)가 해당 토큰에 가장 적합한 소수의 전문가만 선택해서 활성화합니다. 예를 들어 397B 파라미터 모델이라도 실제로 한 번의 추론에 활성화되는 파라미터는 전체의 일부분, 예컨대 수십B 수준에 불과할 수 있습니다.

이 특성이 바로 Flash-MoE가 활용하는 핵심입니다. 전통적인 Dense 모델(예: LLaMA 70B)은 추론 시 모든 70B 파라미터가 계산에 참여하므로 전체를 메모리에 올려야 합니다. 하지만 MoE 모델은 현재 필요한 전문가만 메모리에 올리고 나머지는 디스크에 두는 전략이 가능합니다.

Flash-MoE의 작동 방식

Flash-MoE는 이 "선택적 로딩" 전략을 극한까지 밀어붙입니다. 전체 397B 파라미터를 한꺼번에 RAM에 올리는 것이 아니라, 추론 과정에서 라우터가 선택한 전문가 네트워크만 SSD에서 RAM으로, 그리고 필요하다면 Apple Silicon의 통합 메모리로 빠르게 스왑합니다.

Apple Silicon Mac이 이 작업에 특히 유리한 이유가 있습니다. M 시리즈 칩은 CPU와 GPU가 동일한 통합 메모리(Unified Memory)를 공유합니다. 일반적인 PC에서는 시스템 RAM에서 GPU VRAM으로 데이터를 복사하는 PCIe 버스가 병목이 되지만, Apple Silicon에서는 이 복사 과정 자체가 불필요합니다. 또한 최신 Mac의 SSD 읽기 속도가 매우 빨라서, 디스크에서 전문가 가중치를 로드하는 지연시간도 상대적으로 짧습니다.

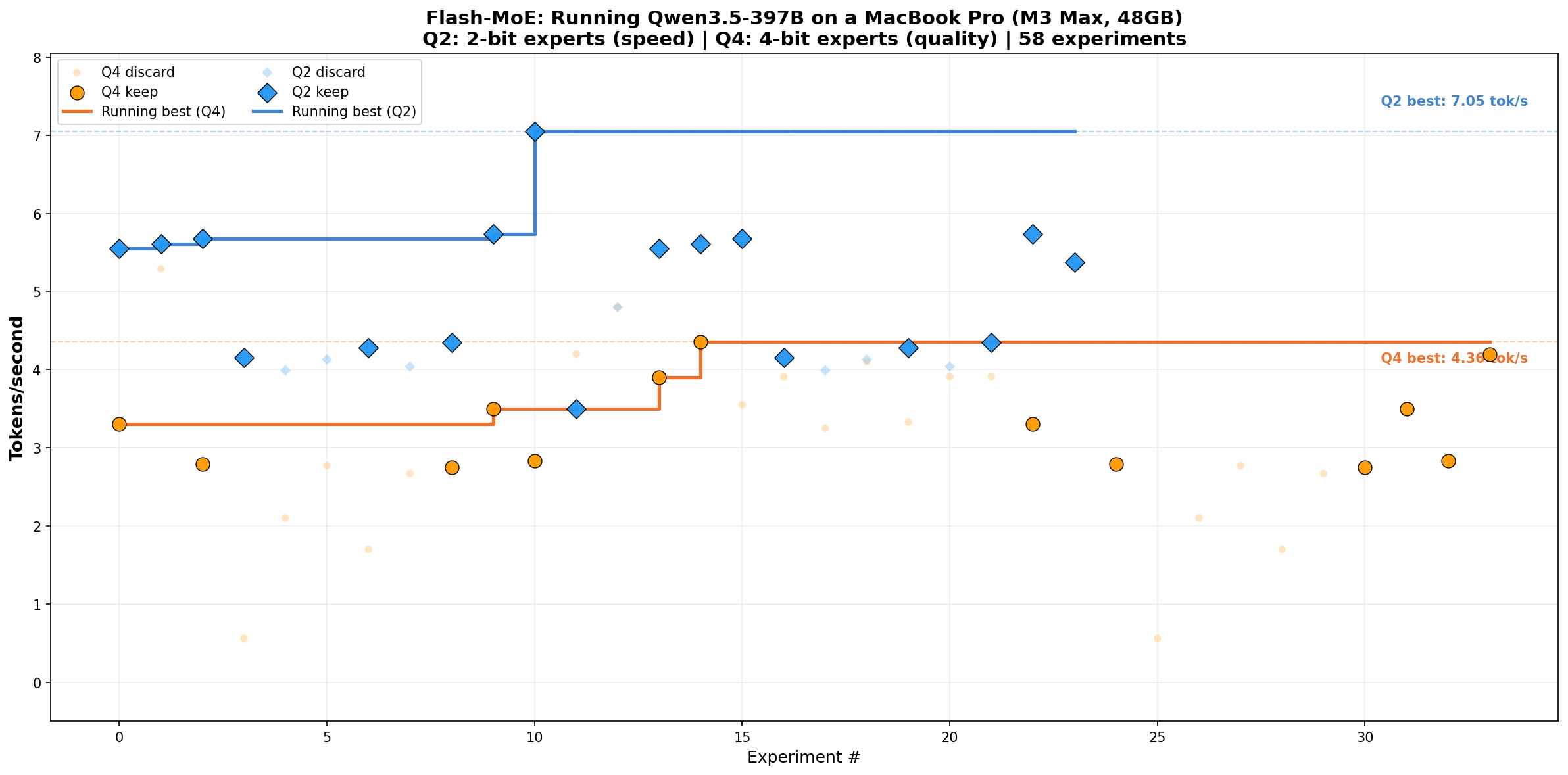

물론 속도 면에서 클라우드 GPU 클러스터와 비교할 수는 없습니다. 초당 생성하는 토큰 수는 제한적일 수밖에 없고, 실시간 대화형 애플리케이션보다는 실험과 프로토타이핑 용도에 가깝습니다. 하지만 핵심은 "클라우드 API 없이, 내 로컬 머신에서 초거대 모델을 직접 실행할 수 있다"는 가능성 자체입니다.

로컬 AI 추론 생태계의 현재 위치

로컬 LLM 실행은 이미 활발한 생태계를 형성하고 있습니다. llama.cpp는 양자화된 모델을 CPU에서 효율적으로 돌리는 데 사실상의 표준이 되었고, Ollama는 이를 더 쉽게 사용할 수 있는 인터페이스를 제공합니다. MLX는 Apple Silicon에 최적화된 머신러닝 프레임워크로 빠르게 성장 중이고요.

하지만 이들 도구로 실행 가능한 모델의 크기에는 한계가 있었습니다. 일반적으로 16GB RAM Mac에서는 7B~13B 모델, 32GB에서는 30B 정도, 64GB에서도 70B 모델을 4비트 양자화해서 겨우 돌리는 수준이었습니다. 397B 규모의 모델을 48GB 장비에서 돌린다는 것은, MoE의 특성을 활용한 전혀 다른 접근법이 없으면 불가능한 일입니다.

경쟁 구도를 보면, Mixtral 8x7B, DeepSeek-V3, Qwen MoE 등 MoE 기반 오픈 모델들이 속속 등장하고 있습니다. 이 모델들은 Dense 모델 대비 같은 품질을 더 적은 연산 비용으로 달성할 수 있어서, 앞으로 MoE가 대형 모델의 기본 아키텍처로 자리잡을 가능성이 높습니다. Flash-MoE 같은 도구는 이런 MoE 모델을 로컬에서 실험할 수 있는 진입장벽을 크게 낮춰줍니다.

한국 개발자에게 주는 시사점

실무 관점에서 Flash-MoE의 의미를 생각해봅시다. 첫째, 보안이나 규정 때문에 클라우드 API를 사용할 수 없는 환경에서 초거대 모델을 실험할 수 있는 경로가 열립니다. 금융, 의료, 공공 분야에서 AI를 도입하려는 한국 기업들에게 이는 상당히 매력적인 선택지입니다.

둘째, 개인 개발자나 소규모 팀이 모델 평가와 비교를 로컬에서 수행할 수 있게 됩니다. 여러 MoE 모델의 응답 품질을 직접 비교하거나, 특정 도메인에서의 성능을 테스트하는 작업을 API 비용 부담 없이 할 수 있다는 의미죠.

셋째, Apple Silicon Mac이 AI 개발 장비로서 가지는 경쟁력이 다시 한번 확인됩니다. M4 Pro나 M4 Max를 탑재한 Mac을 이미 사용하고 있다면, 추가 장비 투자 없이 바로 실험을 시작할 수 있습니다.

마무리

Flash-MoE는 MoE 아키텍처의 특성과 Apple Silicon의 하드웨어 강점을 조합해, 로컬 AI 추론의 규모 한계를 한 단계 끌어올린 프로젝트입니다. 속도보다는 접근성에 방점을 둔 도구이지만, 로컬 AI 생태계가 어디까지 확장될 수 있는지를 보여주는 의미 있는 이정표입니다.

여러분은 AI 모델을 로컬에서 실행하시나요, 아니면 클라우드 API를 주로 사용하시나요? 로컬 실행의 실질적인 장점이 API 대비 어떤 상황에서 빛을 발한다고 생각하시는지 의견을 나눠주세요.

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공