GPU 메모리를 늘리는 게 정답일까?

요즘 AI 분야에서 가장 흔하게 듣는 이야기가 있어요. "모델이 너무 커서 GPU 메모리가 부족하다"는 거죠. GPT 계열 모델이 수백억 개의 파라미터를 갖게 되면서, VRAM 80GB짜리 H100을 여러 장 묶어야 겨우 돌아가는 세상이 됐거든요. 그래서 업계의 해법은 늘 같았어요. 더 큰 메모리, 더 많은 GPU, 더 거대한 클러스터. 하지만 여기서 한 가지 근본적인 질문이 나와요. "정말 하드웨어를 늘리는 게 유일한 방법일까?" 어쩌면 우리가 놓치고 있는 건 수학적인 접근, 그러니까 알고리즘 자체를 더 똑똑하게 만드는 방법일 수 있어요.

트랜스포머의 메모리 병목, 어디서 생기는 걸까

이걸 이해하려면 먼저 트랜스포머(Transformer)가 어떻게 동작하는지 간단히 알아야 해요. 트랜스포머는 현재 대부분의 대형 언어 모델(LLM)의 기본 구조인데요, 핵심에 "어텐션(Attention)"이라는 메커니즘이 있어요. 이게 뭐냐면, 문장에서 각 단어가 다른 모든 단어와 얼마나 관련 있는지를 계산하는 과정이에요. 예를 들어 "고양이가 매트 위에 앉았다"라는 문장에서 "앉았다"가 "고양이"와 얼마나 연관되는지, "매트"와는 얼마나 연관되는지를 숫자로 매기는 거죠.

문제는 이 계산량이 입력 길이의 제곱에 비례한다는 거예요. 토큰(단어 조각)이 1,000개면 1,000 × 1,000 = 100만 번의 연산이 필요하고, 10,000개면 1억 번이 되는 거죠. 이 어텐션 행렬이 메모리를 엄청나게 잡아먹어요. 긴 문서를 처리하거나 컨텍스트 윈도우를 늘리려고 할 때 GPU 메모리가 터지는 주된 원인이 바로 이겁니다.

수학으로 풀어보는 새로운 접근법들

그래서 연구자들이 "하드웨어를 키우는 대신 수학을 바꾸자"는 방향으로 여러 시도를 하고 있어요. 대표적인 것들을 살펴볼게요.

첫 번째는 선형 어텐션(Linear Attention)이에요. 기존 어텐션이 O(n²)의 복잡도를 가진다면, 이걸 O(n)으로 줄이는 수학적 트릭이 있어요. 핵심 아이디어는 소프트맥스(softmax) 함수를 커널 함수로 근사해서, 행렬 곱셈의 순서를 바꾸는 거예요. 쉽게 말하면, 모든 단어 쌍을 일일이 비교하는 대신 중간 요약본을 만들어서 계산량을 확 줄이는 거죠. RetNet이나 RWKV 같은 모델이 이 방향으로 연구되고 있어요.

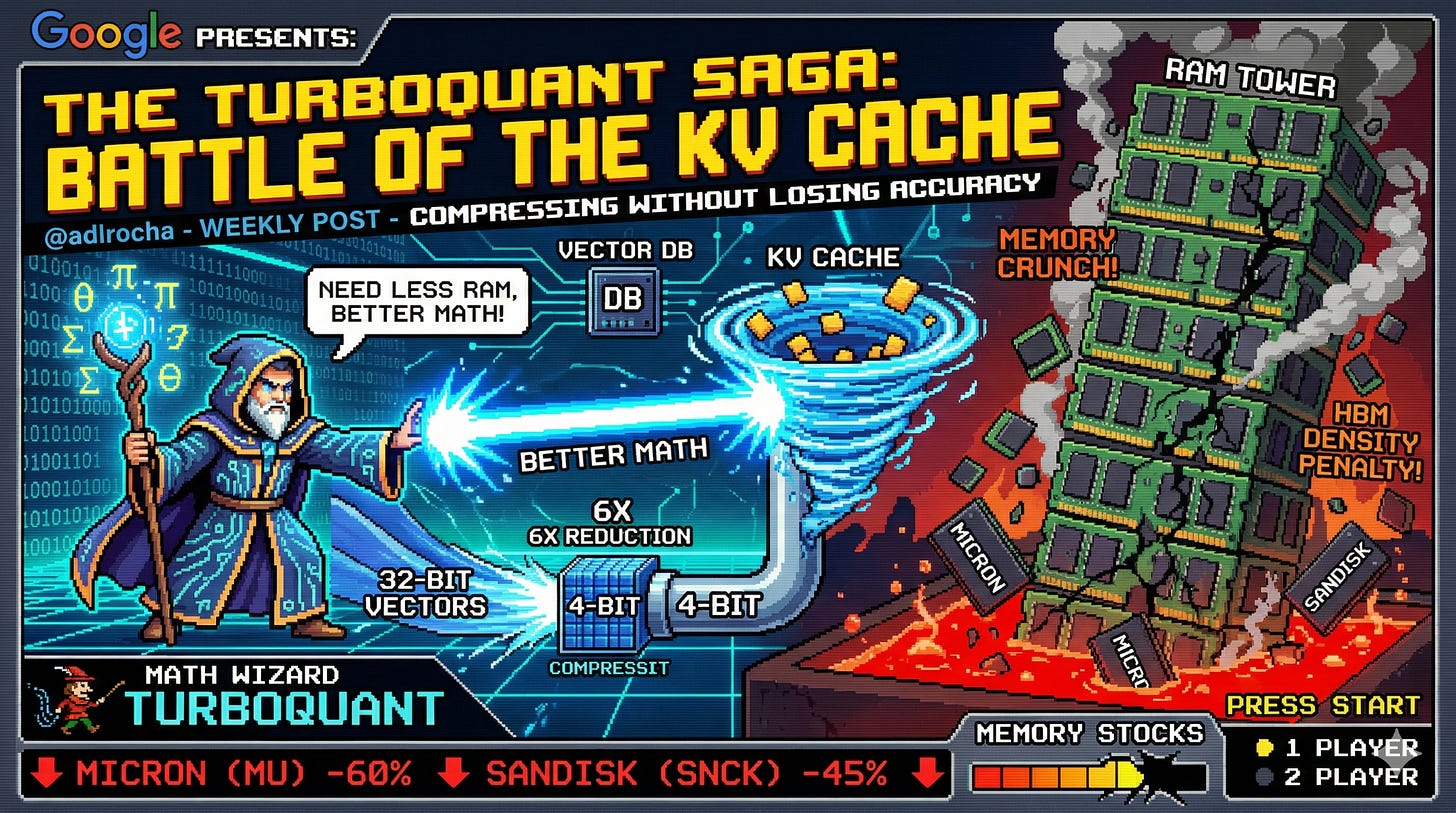

두 번째는 양자화(Quantization)와 저랭크 근사(Low-Rank Approximation)예요. 양자화는 모델의 가중치를 32비트 부동소수점 대신 8비트나 4비트 정수로 표현하는 건데요, 마치 고화질 사진을 적당히 압축해도 눈으로 보기엔 거의 차이가 없는 것처럼, 모델 성능은 크게 떨어지지 않으면서 메모리 사용량을 절반 이하로 줄일 수 있어요. 저랭크 근사는 거대한 행렬을 더 작은 두 행렬의 곱으로 분해하는 건데, QLoRA 같은 기법이 바로 이걸 활용해서 파인튜닝 시 메모리를 극적으로 아끼는 거예요.

세 번째는 스파스 연산(Sparse Computation)이에요. 모델의 모든 파라미터가 모든 입력에 활성화될 필요는 없다는 아이디어인데요, Mixture of Experts(MoE) 구조가 대표적이에요. 전체 파라미터가 수천억 개라도 실제로 한 번의 추론에 사용되는 건 일부분뿐이라 메모리와 계산 비용을 동시에 줄일 수 있어요.

업계에서는 이미 움직이고 있다

이런 수학적 접근은 이미 실전에서 성과를 내고 있어요. Mistral의 Mixtral 모델은 MoE 구조로 파라미터 대비 훨씬 적은 연산량을 달성했고, Meta의 LLaMA 시리즈는 양자화 기법을 적극 활용해서 개인 노트북에서도 돌릴 수 있는 길을 열었죠. 구글의 Gemini도 효율적인 어텐션 메커니즘을 꾸준히 연구하고 있고요.

반면에 NVIDIA, AMD 같은 하드웨어 업체는 당연히 "더 큰 메모리" 쪽에 투자하고 있어요. NVIDIA의 Blackwell 아키텍처는 HBM3E로 메모리 대역폭을 대폭 늘렸고, AMD도 MI300X에 192GB라는 압도적인 VRAM을 탑재했죠. 하드웨어를 키우는 것과 알고리즘을 개선하는 것, 이 두 흐름은 서로 대립하는 게 아니라 보완 관계에 있어요. 다만 하드웨어 확장에는 물리적·경제적 한계가 분명히 있기 때문에, 장기적으로는 수학적 효율성이 더 중요해질 수밖에 없다는 게 이 논의의 핵심이에요.

한국 개발자에게 주는 시사점

이 이야기가 왜 중요하냐면, 한국에서 AI 개발을 하는 환경을 생각해보면 바로 와닿아요. H100 한 장 가격이 수천만 원이고, 클라우드 GPU 비용도 만만치 않잖아요. 스타트업이나 개인 개발자 입장에서 하드웨어를 무한정 늘리는 건 현실적이지 않거든요. 그래서 양자화, LoRA, 스파스 모델 같은 효율화 기법을 제대로 이해하고 활용하는 능력이 실무에서 점점 더 중요해지고 있어요.

당장 실천할 수 있는 것도 있어요. Hugging Face의 bitsandbytes 라이브러리를 써서 4비트 양자화된 모델을 로컬에서 돌려보거나, QLoRA로 적은 자원으로도 파인튜닝을 해볼 수 있고요. vLLM이나 llama.cpp 같은 추론 엔진의 최적화 옵션들을 살펴보는 것도 좋아요.

정리하자면

"더 큰 GPU를 사세요"가 유일한 답이 아니라, 수학과 알고리즘을 개선해서 같은 하드웨어로 더 많은 걸 해내는 방향이 AI의 민주화에 진짜 중요한 열쇠라는 이야기예요. 여러분은 AI 모델을 다룰 때 하드웨어 스케일링과 알고리즘 최적화, 어느 쪽에 더 투자하고 계신가요?

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공