DAW와 LLM이 만나는 순간

요즘 개발 쪽에서 가장 뜨거운 키워드 중 하나가 MCP(Model Context Protocol)예요. 이게 뭐냐면, Anthropic이 제안한 "AI 모델이 외부 도구와 대화하는 표준 규격"이에요. 예전에는 각 AI마다, 각 도구마다 따로따로 연결을 만들어야 했는데, MCP를 쓰면 마치 USB처럼 "한 번 만들어두면 어디든 꽂을 수 있는" 식으로 도구를 노출할 수 있어요. Claude, IDE, 검색 도구, 데이터베이스, 그리고 이제는 음악 제작 소프트웨어까지 이 흐름에 들어왔어요.

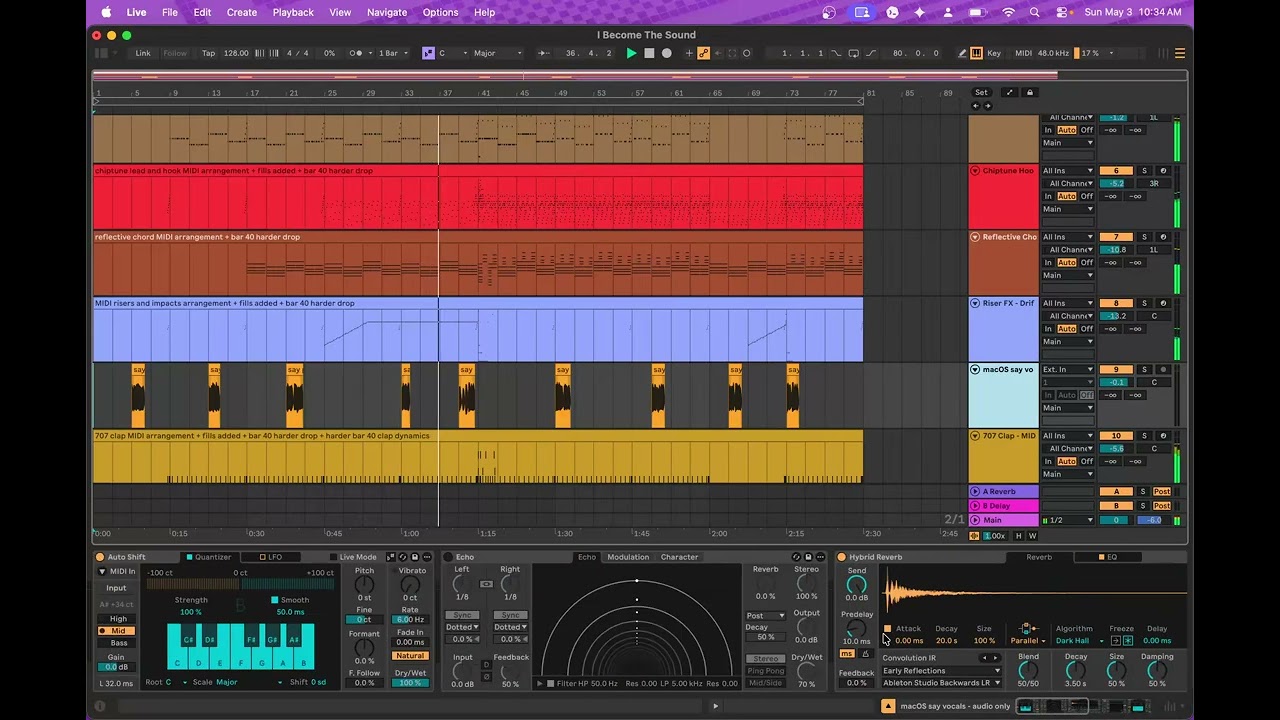

bschoepke라는 개발자가 GitHub에 공개한 Ableton Live MCP가 바로 그 사례예요. Ableton Live는 일렉트로닉 음악, 라이브 퍼포먼스, 영화 음악 등에서 가장 많이 쓰이는 DAW(Digital Audio Workstation, 음악 제작 프로그램) 중 하나예요. 이 프로젝트는 Ableton Live를 MCP 서버로 감싸서, AI 에이전트가 트랙을 만들고, 클립을 배치하고, 악기 파라미터를 조정할 수 있게 해줘요.

어떻게 동작할까

구조를 살펴보면 의외로 단순해요. Ableton Live에는 예전부터 Max for Live와 AbletonOSC 같은 외부 제어용 인터페이스가 존재했어요. OSC는 Open Sound Control의 약자인데, MIDI보다 더 풍부한 정보를 네트워크 너머로 주고받을 수 있는 프로토콜이에요. 이번 프로젝트는 그 위에 MCP 서버 레이어를 얹은 거예요.

작동 흐름은 이런 식이에요. 사용자가 Claude나 다른 MCP 호환 클라이언트에서 "드럼 트랙을 하나 만들어 주고, 4마디짜리 808 베이스라인을 깔아줘" 같은 요청을 보내요. 그러면 Claude가 MCP 서버에 정의된 "트랙 생성", "클립 추가", "노트 입력" 같은 도구들을 차례로 호출해요. 서버는 이 호출을 OSC 메시지로 변환해서 Ableton Live로 보내고, Live는 실제로 트랙을 만들고 노트를 찍어요. 사용자는 자기 화면에서 음악이 "실시간으로 만들어지는 모습"을 보게 되죠.

노출되는 도구의 예를 들면, 트랙 추가/삭제, 클립 생성, MIDI 노트 추가, 디바이스(악기, 이펙트) 파라미터 변경, 재생/정지, 템포 변경 같은 것들이에요. AI 입장에서는 "음악"을 직접 만드는 게 아니라, "DAW를 조작하는 사람의 손"이 되는 셈이에요. 이 점이 중요해요. AI가 음원을 직접 생성하는 Suno나 Udio 같은 서비스와는 결이 다르거든요.

기존 'AI 음악 생성'과 뭐가 다를까

요즘 AI 음악이라고 하면 대부분 "프롬프트 넣으면 완성된 노래가 뚝딱 나오는" 서비스를 떠올려요. Suno, Udio, Stable Audio가 대표적이죠. 이런 서비스는 결과물이 인상적이지만, 음악가가 그 결과물을 다시 손보기는 어려워요. 마음에 드는 베이스라인만 살리고 드럼은 바꾸고 싶어도, 통째로 다시 생성해야 하거든요. 결과는 멋지지만, 창작 과정의 통제권이 거의 없어요.

반면 Ableton Live MCP 같은 접근은 정반대예요. AI는 결과물을 통째로 뱉지 않고, 사람이 평소에 쓰는 도구를 대신 조작해요. 그래서 결과물이 마음에 안 들면 사람이 그 위에서 바로 수정할 수 있어요. 트랙, 클립, MIDI 노트가 다 그대로 남아 있으니까요. 이건 코딩 쪽에서 "코드를 통째로 생성해 주는 AI"와 "IDE 안에서 작은 단위로 수정 도와주는 AI"의 차이와 비슷해요. 후자가 실무에서 훨씬 협업하기 좋잖아요.

비슷한 흐름의 프로젝트도 있어요. Logic Pro나 Reaper 같은 다른 DAW에 대해서도 비공식 MCP 어댑터들이 등장하고 있고, Blender(3D), Figma(디자인), Photoshop처럼 "창작 도구를 AI 에이전트에 노출"하려는 시도가 늘고 있어요. 결국 창작 소프트웨어를 위한 표준 자동화 레이어로서 MCP가 자리 잡고 있는 모양새예요. 예전의 AppleScript, AutoHotkey, 매크로의 자리를 LLM 친화적인 형태로 다시 정의하는 셈이죠.

한국 개발자와 음악 하는 분들에게

우선 음악 작업을 하시는 분이라면, 이건 한 번 직접 깔아볼 만해요. 작곡 초기 단계에서 "드럼 패턴 4가지 빠르게 비교해 보고 싶어", "이 코드 진행에 어울리는 베이스 라인 몇 개 시안 만들어줘" 같은 요청을 자연어로 던지면, AI가 실제 프로젝트 파일 안에 시안을 만들어 줘요. 그중 마음에 드는 것만 골라서 이어서 작업하면 되니까, 아이디어 스케치 단계의 마찰이 크게 줄어들어요.

개발자 입장에서도 의미가 커요. MCP 서버를 만드는 좋은 학습 예제거든요. 코드를 읽어 보면, MCP의 핵심인 "도구 정의(JSON Schema)", "요청-응답 흐름", "외부 시스템과의 어댑터 패턴"이 작은 규모로 잘 드러나 있어요. 회사 내부 도구를 MCP로 감싸는 프로젝트를 시작하기 전에, 이런 도메인 특화 MCP 서버 코드를 읽어 보는 게 좋은 출발점이 될 수 있어요.

특히 한국에는 노션, 카카오톡, 지라, 사내 위키 같은 도구를 MCP로 연결해서 "우리 팀 전용 AI 어시스턴트"를 만들려는 시도가 늘고 있죠. 그런데 이런 비즈니스 영역뿐 아니라, 게임, 디자인, 영상, 음악 같은 창작 도구 영역의 MCP가 앞으로 빠르게 늘어날 거예요. 이 흐름을 일찍 잡는 사람들이, "AI와 함께 창작하는 다음 세대 워크플로우"를 정의하게 될 거고요.

마무리

Ableton Live MCP는 자체로도 흥미롭지만, 더 큰 그림에서 보면 "AI에게 결과를 시키지 말고, 도구를 쥐여 주자"는 패러다임의 좋은 예시예요. 완성품을 통째로 생성하는 AI가 아니라, 사람이 쓰는 도구를 함께 조작하는 AI 말이에요.

여러분이 매일 쓰는 도구 중에, 만약 MCP 서버로 감싸서 AI에게 맡길 수 있다면 어떤 작업을 시키고 싶으신가요? 그리고 그 일을 AI가 대신 했을 때, 정말로 "내가 한 작업"이라고 부를 수 있을지에 대해서는 어떻게 생각하세요?

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공