맥북으로 멀티모달 AI를 파인튜닝할 수 있게 됐어요

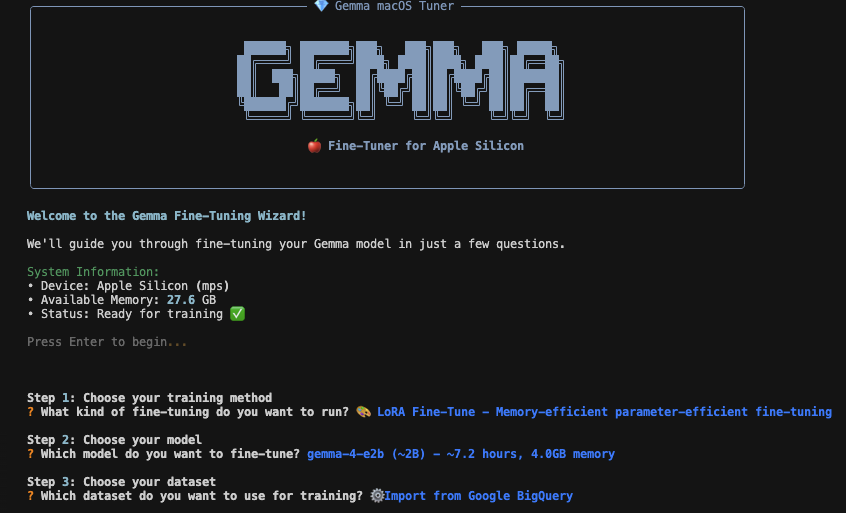

오픈소스 프로젝트 Gemma 4 Multimodal Fine-Tuner가 GitHub에 공개됐어요. 이름에서 알 수 있듯이, Google의 오픈소스 모델인 Gemma 4의 멀티모달 버전을 Apple Silicon Mac에서 파인튜닝할 수 있게 해주는 도구예요.

이게 왜 반가운 일이냐면, 멀티모달 모델의 파인튜닝은 보통 고가의 NVIDIA GPU가 탑재된 서버에서만 할 수 있었거든요. 개인 개발자가 클라우드 GPU를 빌려서 하려면 비용이 부담되고, 로컬에서 하려면 하드웨어 장벽이 높았어요. 이 도구는 M시리즈 칩의 Unified Memory를 활용해서 맥북에서도 파인튜닝이 가능하도록 만든 거예요.

멀티모달 파인튜닝이 뭔가요?

먼저 용어를 풀어볼게요. 멀티모달(Multimodal)이란 텍스트뿐만 아니라 이미지, 음성 등 여러 종류의 데이터를 함께 이해하는 능력을 말해요. Gemma 4 멀티모달은 텍스트와 이미지를 동시에 이해할 수 있는 모델이에요.

파인튜닝(Fine-tuning)은 이미 학습된 모델을 내 특정 목적에 맞게 추가 학습시키는 거예요. 비유하자면, 의대를 졸업한 의사(사전학습 모델)가 피부과 전문의 과정을 밟는 것(파인튜닝)과 비슷해요. 기본 능력은 갖추고 있으니까, 특정 분야에 맞는 데이터로 조금만 더 학습시키면 그 분야에서 훨씬 뛰어난 성능을 보여주는 거죠.

그래서 "멀티모달 파인튜닝"이란 이미지와 텍스트를 함께 이해하는 모델을, 내가 원하는 특정 작업(예: 제품 사진을 보고 설명을 작성, 의료 영상을 분석, 도면을 해석)에 맞게 추가 학습시키는 걸 말해요.

Apple Silicon에서 어떻게 가능한 건가요?

Apple Silicon(M1, M2, M3, M4 시리즈)의 가장 큰 특징 중 하나가 Unified Memory Architecture(UMA)예요. 일반적인 PC에서는 CPU 메모리(RAM)와 GPU 메모리(VRAM)가 물리적으로 분리되어 있어서, AI 학습 시 데이터를 GPU 메모리로 복사하는 과정이 필요해요. 그런데 Apple Silicon에서는 CPU와 GPU가 같은 메모리를 공유하거든요.

이 덕분에 M시리즈 맥에서는 전체 시스템 메모리를 AI 학습에 활용할 수 있어요. 예를 들어 M4 Pro 맥북 프로에 48GB 메모리가 있다면, 이 전체를 모델 학습에 쓸 수 있는 거예요. NVIDIA GPU는 24GB VRAM 모델이 100만 원이 넘는데, 맥북은 이미 갖고 있으니까 추가 비용이 없잖아요.

이 프로젝트는 Apple의 MLX 프레임워크를 기반으로 만들어진 것으로 보여요. MLX는 Apple이 자사 칩에 최적화해서 만든 머신러닝 프레임워크인데, PyTorch와 비슷한 API를 제공하면서 Apple Silicon의 성능을 최대한 활용할 수 있게 설계됐어요.

업계 맥락 — 로컬 AI의 부상

이 도구는 더 넓은 트렌드의 일부예요. 바로 "AI를 클라우드가 아닌 로컬에서 돌리자"는 움직임이요. Ollama, llama.cpp, LM Studio 같은 도구들이 인기를 끌면서, 개인 개발자도 자기 컴퓨터에서 LLM을 돌리는 게 당연해졌어요.

하지만 로컬에서 추론(Inference)을 하는 것과 학습/파인튜닝(Training)을 하는 것은 난이도가 꽤 달라요. 추론은 모델을 실행만 하면 되니까 상대적으로 자원이 적게 들지만, 학습은 역전파(backpropagation) 과정에서 훨씬 많은 메모리와 연산이 필요하거든요. 이 프로젝트가 의미 있는 이유가 바로 여기에 있어요. 파인튜닝이라는 더 어려운 작업을 맥북에서 가능하게 만들었다는 것이요.

Google의 Gemma가 좋은 선택인 이유도 있어요. Gemma는 상대적으로 작은 모델 크기로도 높은 성능을 내도록 설계되었고, 라이선스도 상업적 사용이 가능해서 파인튜닝해서 실제 서비스에 적용하기에 적합하거든요.

한국 개발자에게 주는 시사점

한국 개발자 중에 맥을 사용하는 분이 정말 많잖아요. 이 도구를 활용하면 별도의 GPU 서버 없이도 멀티모달 파인튜닝을 실험해볼 수 있어요. 특히 이런 경우에 유용할 거예요. 사내 문서 이미지를 분석하는 모델이 필요하거나, 한국어 + 이미지 데이터로 도메인 특화 모델을 만들고 싶거나, 클라우드 GPU 비용 없이 프로토타입을 빠르게 만들어보고 싶을 때요.

물론 대규모 학습은 여전히 클라우드 GPU가 필요하겠지만, 아이디어 검증이나 소규모 데이터셋으로의 파인튜닝은 맥북에서 충분히 할 수 있어요. "일단 되는지 확인해보자"라는 실험에 진입 장벽을 크게 낮춰주는 도구예요.

한줄 정리

멀티모달 AI 파인튜닝의 진입 장벽이 "NVIDIA GPU 필수"에서 "맥북이면 충분"으로 낮아지고 있어요.

Apple Silicon 맥에서 AI 모델을 돌려본 경험이 있으신 분, 성능이나 경험이 어땠는지 공유해주세요!

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공