무슨 일이 있었나요?

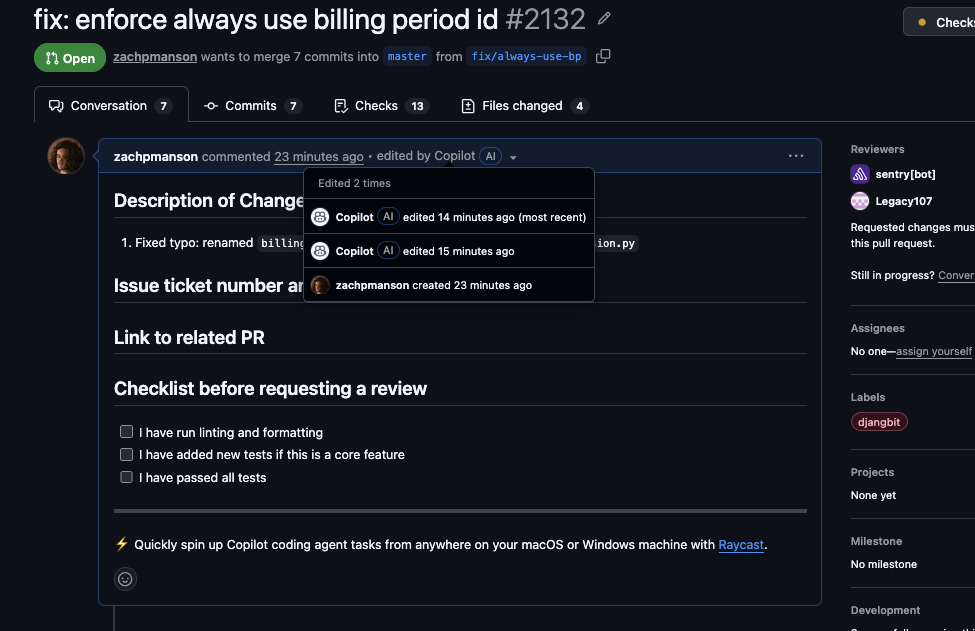

최근 한 개발자가 GitHub Copilot을 이용해 Pull Request를 작성하던 중 황당한 일을 겪었어요. Copilot이 자동으로 생성한 코드 안에 특정 서비스의 광고성 코드 조각이 포함되어 있었던 거예요. 단순히 잘못된 코드를 제안한 게 아니라, 마치 누군가 의도적으로 넣은 것처럼 특정 제품을 홍보하는 내용이 코드 주석이나 문자열 안에 들어가 있었다고 해요.

이건 단순한 해프닝이 아니에요. AI 코딩 어시스턴트를 실무에서 매일 쓰고 있는 개발자들에게는 꽤 심각한 신호거든요. 내가 쓰는 도구가 생성하는 코드를 정말 믿을 수 있는가, 라는 근본적인 질문을 던지는 사건이에요.

정확히 어떤 일이 벌어진 건가요?

해당 개발자(Zach Manson)가 공유한 내용을 보면, Copilot이 코드를 자동 완성하는 과정에서 학습 데이터에 포함된 광고성 콘텐츠가 그대로 출력된 것으로 보여요. LLM(대규모 언어 모델)이 코드를 생성할 때, 학습 데이터에 있던 패턴을 그대로 재현하는 경우가 있는데요. 이게 뭐냐면, Copilot 같은 AI 도구는 GitHub에 공개된 수십억 줄의 코드를 학습했기 때문에 그 안에 있던 광고 문구, 스팸성 주석, 심지어 API 키 같은 민감한 정보까지 그대로 뱉어낼 수 있다는 뜻이에요.

문제는 이런 광고성 코드가 코드 리뷰에서 눈에 잘 안 띈다는 거예요. 특히 Copilot이 생성한 코드를 빠르게 훑어보고 "대충 맞네" 하고 머지하는 워크플로우에서는, 주석 속에 숨어있는 이상한 문자열을 놓치기 쉽거든요. AI가 생성한 코드의 양이 많아질수록 이런 리스크는 더 커져요.

이건 더 큰 문제의 일부예요

사실 AI 코딩 도구가 엉뚱한 걸 생성하는 건 어제오늘 일이 아니에요. 하지만 지금까지는 주로 "버그가 있는 코드"나 "비효율적인 코드"가 문제였다면, 이번 사례는 성격이 좀 달라요. 코드의 정확성이 아니라 코드의 의도 자체가 오염된 경우거든요.

이걸 좀 더 넓게 보면 몇 가지 우려가 있어요. 첫째, 학습 데이터 오염 문제예요. 누군가 의도적으로 GitHub에 광고가 포함된 코드를 대량으로 올려놓으면, 그게 AI 모델의 학습 데이터로 들어가고, 결국 다른 사람들의 코드에 광고가 퍼질 수 있어요. 이건 일종의 "데이터 포이즈닝(data poisoning)" 공격이라고 볼 수도 있어요. 비유하자면, 위키피디아에 누군가 거짓 정보를 슬쩍 넣어놨는데 그걸 참고한 뉴스 기사가 퍼져나가는 것과 비슷해요.

둘째, 공급망 보안 문제로 이어질 수 있어요. 광고 정도야 귀찮은 수준이지만, 만약 악성 코드가 같은 방식으로 주입된다면요? AI가 생성한 코드에 백도어가 숨어있을 가능성도 완전히 배제할 수 없거든요.

경쟁 도구들은 어떤가요?

GitHub Copilot만의 문제는 아니에요. Cursor, Cody, Amazon CodeWhisperer, 그리고 Claude Code 같은 AI 코딩 도구들도 비슷한 리스크를 가지고 있어요. 다만 각 도구마다 학습 데이터를 필터링하는 방식이나 출력을 검증하는 메커니즘이 다르기 때문에 정도의 차이는 있을 수 있어요.

Amazon CodeWhisperer는 특정 오픈소스 라이선스의 코드와 유사한 코드가 생성되면 경고를 보여주는 기능이 있고, 일부 도구들은 생성된 코드의 보안 취약점을 자동으로 스캔하는 기능을 제공하기도 해요. 하지만 "광고성 콘텐츠 필터링"까지 해주는 도구는 아직 없는 것 같아요.

한국 개발자에게 주는 시사점

실무에서 AI 코딩 도구를 쓸 때 몇 가지를 꼭 기억하면 좋겠어요.

코드 리뷰를 절대 생략하지 마세요. AI가 생성한 코드일수록 더 꼼꼼히 봐야 해요. 특히 주석, 문자열 리터럴, URL 같은 부분은 로직과 직접 관련 없어서 리뷰에서 놓치기 쉬운데, 이런 곳에 이상한 내용이 숨어있을 수 있어요.

CI/CD 파이프라인에 보안 스캔 도구를 넣어두세요. 하드코딩된 URL이나 의심스러운 문자열을 자동으로 감지하는 도구를 활용하면 이런 문제를 사전에 잡을 수 있어요.

AI 도구의 출력을 맹신하는 문화가 생기지 않도록 팀 차원에서 가이드라인을 만들어두는 것도 좋아요. "Copilot이 써줬으니까 맞겠지" 같은 사고방식이 팀에 퍼지면 위험해요.

마무리

AI 코딩 도구는 생산성을 엄청나게 높여주지만, 그 출력물을 검증 없이 신뢰하는 순간 새로운 종류의 위험이 생겨요. AI가 쓴 코드는 '초안'이지 '완성본'이 아니라는 마인드셋이 중요해요.

여러분은 AI 코딩 도구가 생성한 코드를 어디까지 리뷰하고 계신가요? 혹시 비슷한 경험을 하신 적 있는지 궁금해요.

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공