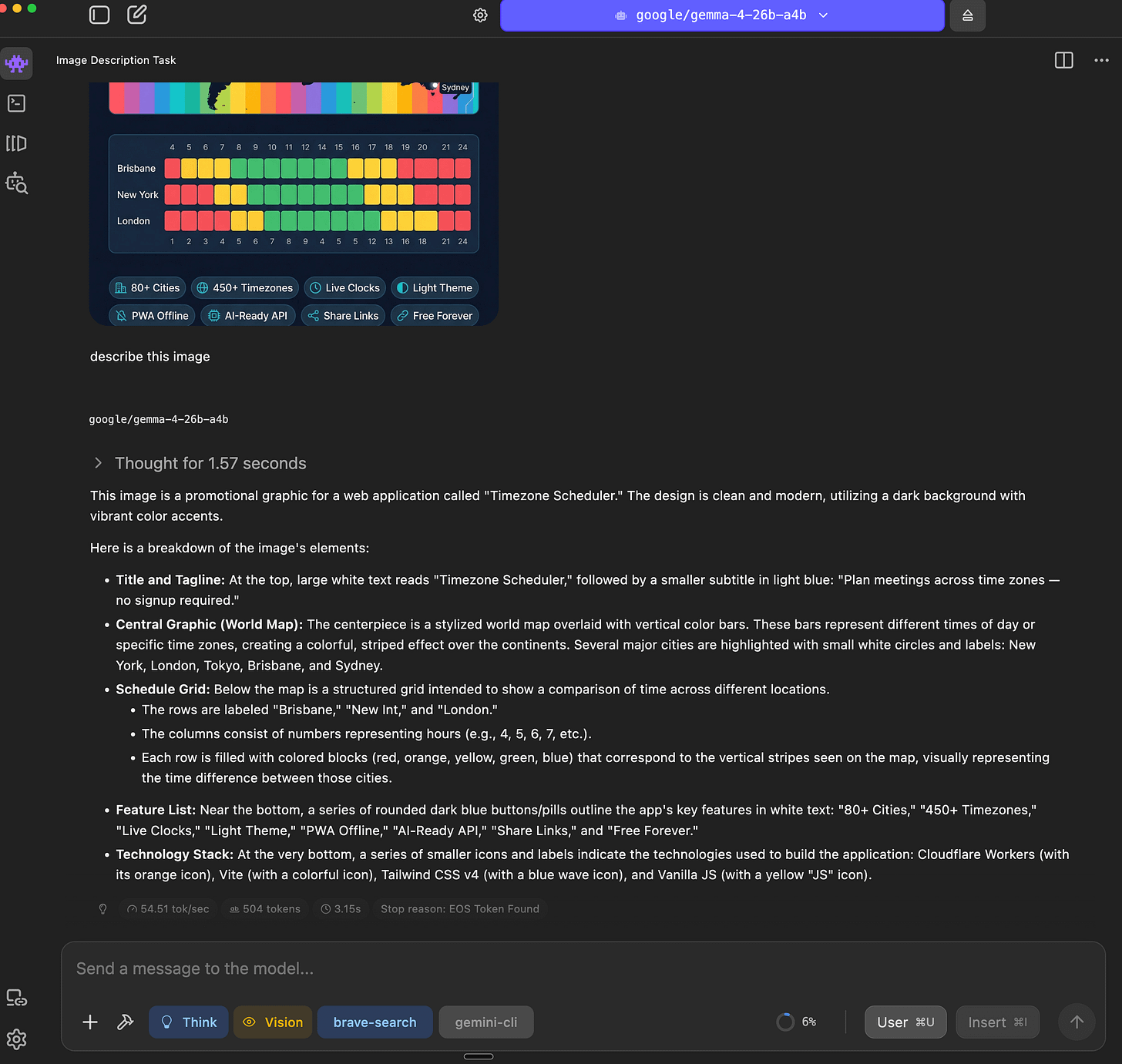

로컬 LLM, 이제 터미널에서 바로 띄운다

구글이 최근 공개한 Gemma 4를 내 컴퓨터에서 직접 돌려보고 싶다면, 이제 꽤 편한 방법이 생겼어요. LM Studio가 새로 추가한 헤드리스(headless) CLI 기능을 사용하면 GUI 창을 띄울 필요 없이 터미널 명령 한 줄로 로컬 LLM 서버를 띄울 수 있거든요. 여기에 Claude Code까지 연결하면 꽤 흥미로운 워크플로우가 만들어져요.

먼저 배경을 좀 설명하자면, Gemma는 구글이 오픈소스로 공개하는 경량 LLM 시리즈예요. "오픈 웨이트"라고도 하는데요, 이게 뭐냐면 모델의 가중치(모델이 학습한 결과물, 뇌의 시냅스 연결 같은 거라고 생각하면 돼요)를 누구나 다운로드받아서 자기 컴퓨터에서 실행할 수 있게 공개한다는 뜻이에요. Gemma 4는 이 시리즈의 최신 버전으로, 이전 세대보다 성능이 크게 올라갔어요.

LM Studio 헤드리스 CLI가 뭔데?

LM Studio는 원래 로컬에서 LLM을 쉽게 돌릴 수 있게 해주는 데스크톱 앱이에요. 예쁜 GUI가 있어서 모델을 검색하고, 다운로드하고, 채팅할 수 있죠. 그런데 개발자 입장에서는 GUI가 항상 편한 건 아니에요. 서버에서 돌리고 싶거나, 스크립트로 자동화하고 싶거나, 다른 도구와 연결하고 싶을 때는 CLI(Command Line Interface, 터미널에서 명령어로 조작하는 방식)가 훨씬 나으니까요.

이번에 새로 나온 헤드리스 CLI는 바로 이 니즈를 해결해줘요. "헤드리스"라는 말은 "화면(머리) 없이"라는 뜻인데요, 모니터나 GUI 없이 백그라운드에서 동작한다는 의미예요. 터미널에서 명령어 한 줄이면 LM Studio 서버가 뜨고, OpenAI 호환 API 엔드포인트가 열려요. OpenAI 호환이라는 게 중요한데, 이게 뭐냐면 OpenAI API 형식으로 요청을 보내는 모든 도구가 별다른 수정 없이 연결된다는 뜻이거든요.

구체적인 흐름은 이래요. 먼저 LM Studio CLI로 Gemma 4 모델을 다운로드하고, 서버를 시작하면 localhost:1234 같은 주소에서 API가 열려요. 그러면 이 로컬 엔드포인트를 다른 도구의 API 설정에 넣어주기만 하면 되는 거예요. 설치부터 서버 시작까지 터미널 몇 줄이면 끝나요.

Claude Code와 로컬 LLM의 조합

여기서 더 재미있는 건 이걸 Claude Code와 함께 쓰는 방법이에요. Claude Code는 Anthropic의 Claude를 터미널에서 코딩 어시스턴트로 쓸 수 있게 해주는 도구인데요, 기본적으로는 Anthropic의 API를 사용하지만 설정을 바꿔서 다른 모델을 연결할 수도 있어요.

이 조합이 의미 있는 이유가 있어요. Claude Code를 메인 코딩 어시스턴트로 쓰면서, 특정 작업(예를 들어 간단한 코드 자동완성이나 빠른 질의응답)에는 로컬에서 돌아가는 Gemma 4를 활용하는 식의 하이브리드 워크플로우를 만들 수 있거든요. 클라우드 API를 쓰면 비용이 발생하잖아요. 간단한 작업까지 전부 클라우드로 보내는 건 비효율적이니까, 가벼운 작업은 로컬 모델이 처리하고 복잡한 작업만 클라우드 모델에 맡기는 거예요.

또 하나 중요한 건 프라이버시예요. 회사 코드나 민감한 데이터를 다룰 때 외부 서버로 보내는 게 꺼려질 수 있잖아요. 로컬 LLM을 쓰면 데이터가 내 컴퓨터 밖으로 나가지 않으니까 이런 걱정이 없어요. 한국 기업들 중에서도 보안 정책 때문에 외부 AI API 사용이 제한되는 경우가 꽤 있는데, 로컬 LLM이 대안이 될 수 있는 거죠.

Ollama, llama.cpp와 뭐가 다를까

로컬 LLM을 돌리는 도구는 LM Studio 말고도 여러 가지가 있어요. 대표적으로 Ollama가 있는데요, 역시 터미널에서 모델을 다운로드하고 서버를 띄울 수 있어요. ollama run gemma4 같은 명령어 한 줄이면 되죠. 그리고 더 로우레벨로 가면 llama.cpp가 있어요. 이건 C++로 작성된 LLM 추론 엔진인데, 성능 최적화가 잘 되어 있어서 같은 하드웨어에서 더 빠르게 돌릴 수 있어요.

LM Studio의 장점은 이 둘 사이의 적당한 지점에 있다는 거예요. Ollama만큼 간편하면서도 GUI와 CLI를 둘 다 제공하고, 내부적으로는 llama.cpp 기반이라 성능도 괜찮아요. 이번에 추가된 헤드리스 CLI로 Ollama와의 차이도 많이 줄었고요. 어떤 도구를 쓸지는 취향과 상황에 따라 다르지만, LM Studio는 "처음 시작하기 쉬우면서도 확장성이 있는" 포지션을 잘 잡고 있어요.

한국 개발자에게 주는 시사점

로컬 LLM 환경은 정말 빠르게 성숙하고 있어요. 1~2년 전만 해도 로컬에서 LLM을 돌리려면 복잡한 설정과 고가의 GPU가 필요했는데, 이제는 M시리즈 맥북 하나면 꽤 쓸만한 모델을 돌릴 수 있거든요. Gemma 4의 작은 버전은 16GB 램만 있어도 충분히 돌아가요.

실무에서 당장 활용할 수 있는 시나리오를 몇 가지 생각해보면요. 첫째, 코드 리뷰 보조로 로컬 LLM을 git hook에 연결해서 커밋 전에 간단한 검토를 돌리는 거예요. 둘째, 사내 문서 검색이나 Q&A 봇을 외부 API 없이 구축할 수 있어요. 셋째, CI/CD 파이프라인에 통합해서 자동화된 코드 분석을 추가할 수도 있고요. 이 모든 게 보안 정책을 위반하지 않으면서 가능하다는 게 핵심이에요.

특히 LM Studio 같은 도구가 OpenAI 호환 API를 제공한다는 건, 기존에 OpenAI API를 기반으로 만든 도구나 코드를 거의 수정 없이 로컬 모델로 교체할 수 있다는 뜻이에요. API 엔드포인트 URL만 바꾸면 되니까요. 이미 OpenAI API 기반 프로젝트를 운영하고 계신 분이라면 한번 테스트해볼 만해요.

정리하자면

LM Studio 헤드리스 CLI + Gemma 4 + Claude Code라는 조합은 클라우드와 로컬의 장점을 모두 취하는 실용적인 워크플로우예요. 복잡한 작업은 클라우드, 간단한 작업과 민감한 데이터는 로컬에서 처리하는 하이브리드 방식이 앞으로 점점 더 일반화될 거예요.

여러분은 로컬 LLM을 실무에서 활용해본 경험이 있나요? 아니면 아직 클라우드 API만 쓰고 계신가요? 로컬 모델로 전환하거나 병행하는 데 어떤 장벽이 있는지 이야기 나눠봐요.

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공