단일 머신의 한계를 넘으려는 DuckDB

DuckDB를 아시나요? 최근 데이터 엔지니어링 쪽에서 가장 핫한 도구 중 하나인데요, 쉽게 말하면 내 노트북에서 바로 돌릴 수 있는 초고속 분석용 데이터베이스예요. SQLite처럼 서버 없이 임베디드로 동작하는데, 분석 쿼리(OLAP)에 최적화되어 있어서 수십 GB의 CSV나 Parquet 파일도 노트북에서 몇 초 만에 쿼리할 수 있어요.

그런데 DuckDB에는 태생적인 한계가 하나 있어요. 바로 단일 머신에서만 돌아간다는 거예요. 데이터가 수백 GB, 수 TB로 커지면 아무리 DuckDB가 빨라도 한 대의 컴퓨터로는 감당이 안 되죠. 메모리가 부족하거나, 쿼리 시간이 너무 길어지거나.

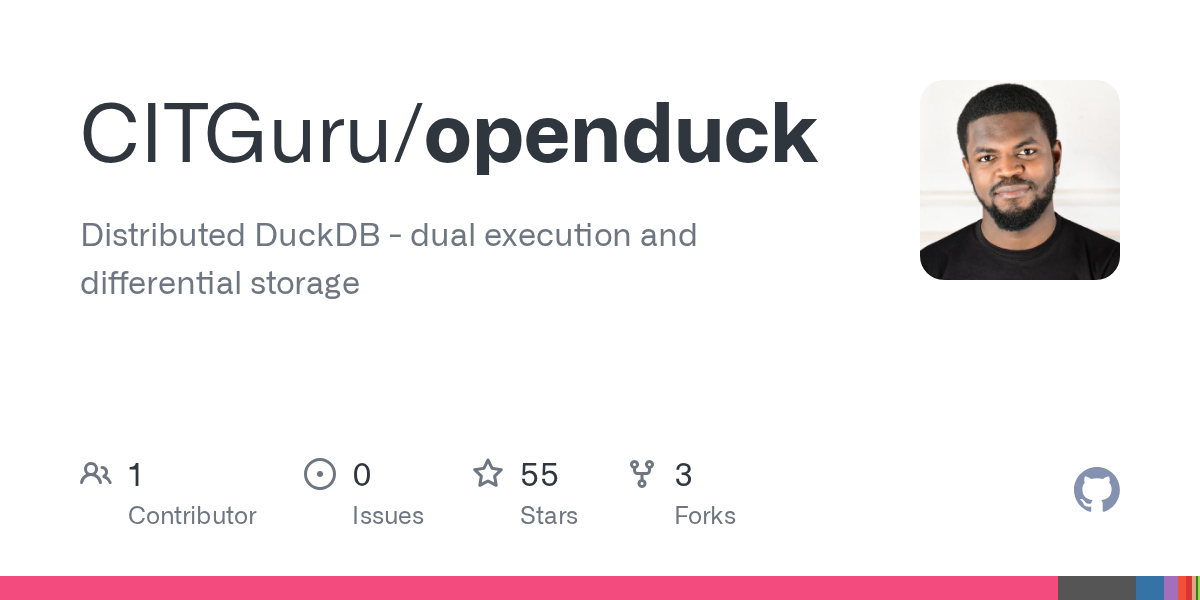

이 문제를 해결하려는 오픈소스 프로젝트가 등장했어요. OpenDuck이라는 프로젝트인데요, DuckDB 인스턴스를 여러 대의 서버에 분산시켜서 하나의 클러스터처럼 쓸 수 있게 해주는 도구예요.

OpenDuck은 어떻게 작동하나요

OpenDuck의 핵심 아이디어는 생각보다 단순해요. 여러 대의 서버에 각각 DuckDB 인스턴스를 띄우고, 이들을 코디네이터 노드가 조율하는 구조예요. 사용자가 SQL 쿼리를 날리면, 코디네이터가 그 쿼리를 분석해서 각 노드에 부분 작업을 할당하고, 결과를 모아서 돌려주는 거예요.

이게 뭐냐면, 비유를 들어볼게요. 도서관에서 책 한 권을 찾을 때 사서 한 명이 돌아다니면 오래 걸리잖아요? 그런데 사서 열 명이 각자 한 서가씩 맡아서 동시에 찾으면 훨씬 빠르죠. OpenDuck이 하는 게 바로 이거예요. 데이터를 여러 노드에 나눠 놓고, 쿼리가 들어오면 각 노드가 자기 담당 데이터만 처리하게 하는 거예요.

기술적으로 보면, OpenDuck은 DuckDB의 확장(extension) 시스템을 활용해요. DuckDB 자체를 수정하는 게 아니라, DuckDB 위에 분산 레이어를 얹는 방식이죠. 이 덕분에 DuckDB가 업데이트되어도 비교적 쉽게 따라갈 수 있어요. 데이터는 각 노드의 로컬 스토리지나 S3 같은 오브젝트 스토리지에 저장할 수 있고, Apache Arrow 형식으로 노드 간 데이터를 교환해요. Arrow는 메모리 내 데이터를 효율적으로 표현하는 포맷인데, 직렬화/역직렬화 비용을 최소화해서 노드 간 통신 오버헤드를 줄여줘요.

비슷한 시도들과의 비교

분산 분석 데이터베이스 시장은 이미 꽤 성숙해 있어요. Apache Spark, Trino(구 PrestoSQL), ClickHouse, BigQuery, Snowflake 같은 선택지가 있죠. 그러면 OpenDuck은 이들과 뭐가 다른 걸까요?

가장 큰 차이점은 DuckDB의 사용 경험을 그대로 유지한다는 거예요. Spark나 Trino를 쓰려면 클러스터를 별도로 구축하고, 그에 맞는 SQL 방언이나 API를 배워야 해요. 반면 OpenDuck은 기존에 DuckDB로 작업하던 코드를 거의 그대로 쓸 수 있어요. 로컬에서 프로토타이핑하다가 데이터가 커지면 클러스터로 스케일 아웃하는 경로가 자연스럽다는 거죠.

DuckDB 자체적으로도 분산 환경을 고려한 움직임이 있어요. MotherDuck이라는 서비스가 있는데, 이건 DuckDB의 클라우드 매니지드 버전이에요. 로컬 DuckDB와 클라우드 DuckDB를 하이브리드로 연결해서 쓸 수 있게 해주죠. 하지만 MotherDuck은 상용 서비스고, 자체 인프라에서 운영하고 싶은 팀에게는 선택지가 아니에요. OpenDuck은 바로 이 틈새를 노리고 있어요.

다만 솔직히 말하면, OpenDuck은 아직 초기 단계 프로젝트예요. 프로덕션에서 바로 쓰기에는 안정성이나 기능 완성도 면에서 검증이 더 필요해요. 쿼리 옵티마이저가 분산 환경에 맞게 얼마나 잘 동작하는지, 장애 복구(fault tolerance)는 어떻게 처리하는지 같은 부분이 아직 성숙하지 않을 수 있어요.

한국 개발자에게 주는 시사점

한국에서도 DuckDB를 데이터 분석이나 ETL 파이프라인에 활용하는 팀이 빠르게 늘고 있어요. 특히 스타트업이나 중소 규모 팀에서 BigQuery 비용이 부담될 때, DuckDB로 로컬에서 처리하는 패턴이 인기인데요.

데이터가 적을 때는 이 방식이 완벽하지만, 사업이 성장하면서 데이터가 커지면 결국 "이제 DuckDB로는 안 되겠다"라는 시점이 와요. 이때 Spark나 BigQuery로 넘어가면 비용과 복잡도가 급격히 올라가죠. OpenDuck 같은 도구가 성숙해지면, DuckDB를 계속 쓰면서도 스케일 아웃할 수 있는 중간 단계가 생기는 셈이에요.

당장 도입하기보다는, GitHub에 스타를 찍어두고 프로젝트의 성숙도를 지켜보는 게 좋을 것 같아요. 그리고 DuckDB 자체에 대한 학습은 지금 바로 시작해도 좋아요. 분산이든 단일이든, DuckDB의 SQL과 데이터 처리 패턴을 익혀두면 어떤 방향으로 발전하든 그대로 써먹을 수 있으니까요.

한줄 정리

OpenDuck은 DuckDB의 강력함을 단일 머신 너머로 확장하려는 실험적 프로젝트로, DuckDB 생태계의 빠른 성장을 보여주는 사례예요.

여러분은 분석용 데이터가 커졌을 때 어떻게 대응하고 계신가요? DuckDB에서 시작해서 어디로 스케일 아웃하는 게 가장 현실적일까요?

🔗 출처: Hacker News

TTJ 코딩클래스 정규반

월급 외 수입,

코딩으로 만들 수 있습니다

17가지 수익 모델을 직접 실습하고, 1,300만원 상당의 자동화 도구와 소스코드를 받아가세요.

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공