드디어 APU 한 대로 로컬 LLM을 돌리는 시대

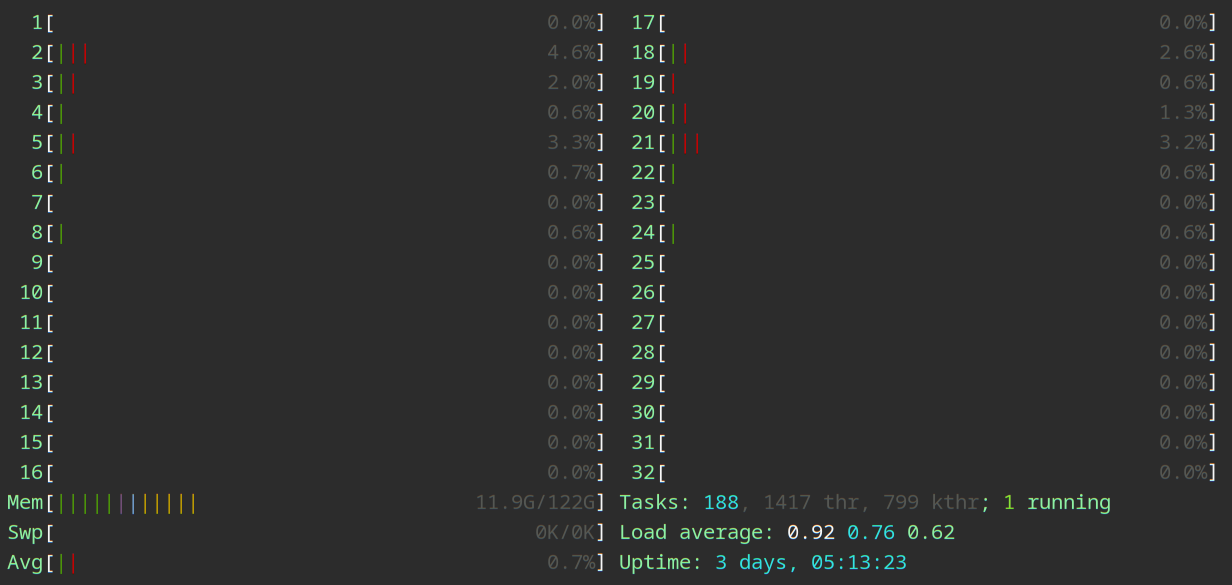

요즘 로컬에서 대형 언어모델(LLM)을 돌리고 싶다는 분들이 부쩍 늘었어요. GPU 하나 사자니 지갑이 울고, 클라우드 쓰자니 토큰 비용이 무섭고요. 그래서 AMD가 얼마 전 내놓은 Strix Halo가 꽤 관심을 모으고 있어요. 이게 뭐냐면, CPU와 강력한 통합 GPU, 그리고 최대 128GB의 통합 메모리를 한 칩에 묶은 APU예요. Apple Silicon의 통합 메모리 구조와 꽤 닮은 발상이죠. 큰 모델도 메모리에 올릴 수 있다는 점에서 매력적이에요.

문제는 소프트웨어예요. AMD 진영의 GPGPU 플랫폼인 ROCm은 CUDA의 대안으로 수년간 개발돼 왔는데, 실제로 써보면 여전히 갈 길이 먼 부분이 있어요. 오늘 소개할 글은 한 개발자가 Strix Halo가 탑재된 노트북에서 직접 ROCm을 깔고 PyTorch, llama.cpp 같은 걸 돌려본 솔직한 후기입니다.

설치부터가 모험이다

글쓴이가 가장 먼저 부딪힌 건 설치 단계였어요. ROCm은 공식적으로 지원하는 리눅스 배포판이 제한적인데, 그마저도 Strix Halo에 들어간 RDNA 3.5 계열 iGPU는 지원 매트릭스에서 빠져 있었어요. 결국 HSA_OVERRIDE_GFX_VERSION 같은 환경변수를 강제로 박아서 "비슷한 gfx 타겟인 척" 속이는 꼼수로 돌아가게 만들었다고 해요. 이게 뭐냐면, 드라이버에게 "이 GPU는 내가 지원하는 다른 아키텍처로 봐줘"라고 거짓말을 시키는 거예요. 운 좋으면 되고 운 나쁘면 커널 로그를 뒤져야 합니다.

그래도 일단 동작에 들어가면 성능은 나쁘지 않다는 게 글쓴이의 평가예요. llama.cpp의 ROCm 백엔드로 7B~13B급 모델을 돌렸을 때 CPU 전용 대비 훨씬 빠른 토큰/초를 뽑아줬고, 128GB 통합 메모리 덕분에 70B급 양자화 모델을 메모리 부족 걱정 없이 올려볼 수 있었다고 해요. 이 "통합 메모리에 큰 모델을 통째로 올릴 수 있다"는 점은 RTX 4090(24GB)이나 A6000(48GB) 같은 개별 GPU로는 따라오기 어려운 Strix Halo만의 강점이에요.

생태계 성숙도의 현실

하지만 PyTorch 쪽은 이야기가 좀 달라요. 공식 ROCm PyTorch 빌드는 있지만, 특정 연산자(operator)에서 CUDA 대비 명확한 성능 저하가 보이고, 서드파티 라이브러리(bitsandbytes, flash-attention, xformers 등)는 여전히 "CUDA 우선, ROCm은 뒤늦게" 패턴이에요. 최신 논문 구현을 돌려보려고 하면 "이 커스텀 커널은 CUDA만 지원합니다" 같은 메시지에 부딪히는 일이 많아요. 반면 일상적인 컨볼루션 신경망이나 순수 transformers 라이브러리로 추론하는 건 비교적 매끄럽게 돌아간다고 합니다.

업계 흐름: CUDA 독점에 도전하는 세 갈래

현재 CUDA의 대안은 크게 세 갈래예요. 첫째는 AMD의 ROCm/HIP이고, 둘째는 인텔의 oneAPI/SYCL, 셋째는 Apple의 Metal + MLX예요. 여기에 OpenAI Triton 같은 고수준 DSL, Modular의 Mojo, Google의 JAX+XLA 같은 우회 경로도 있어요. 이들은 공통적으로 "NVIDIA 단일 벤더 락인에서 벗어나자"는 업계의 의지를 반영해요. 특히 대형 클라우드 사업자들이 AMD MI300X 같은 데이터센터 GPU를 대량 도입하면서 ROCm에 진짜 돈과 엔지니어가 투입되기 시작했어요. 그래서 느리지만 1년 전과 비교하면 체감 개선이 분명하다는 평가가 많아요.

한국 개발자에게 주는 시사점

실무에서 당장 Strix Halo + ROCm으로 프로덕션 학습 파이프라인을 굴리라고 하긴 어려워요. 하지만 두 가지 맥락에서 주목할 만해요. 하나는 엣지/로컬 AI 워크스테이션이에요. 사내 데이터를 외부에 보내기 민감한 금융·의료·법률 쪽에서 70B급 모델을 로컬 박스 한 대로 돌릴 수 있다는 건 매력적이에요. 다른 하나는 CUDA 종속성 점검이에요. 여러분이 만드는 ML 코드가 암묵적으로 CUDA-only 라이브러리에 엮여 있는지, 추상화 층(예: PyTorch 기본 API)으로 빠져나올 수 있는지 점검해두면 미래의 이식성이 훨씬 좋아져요.

아직은 얼리어답터의 영역이지만, 방향은 분명해요. GPU 연산이 NVIDIA 한 곳에서만 돌던 시대는 서서히 막을 내리고 있어요. 여러분은 로컬 LLM 환경을 꾸민다면 어떤 조합을 고르시겠어요? Mac Studio, RTX 4090 박스, 아니면 이번 Strix Halo?

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공