구글이 또 새 TPU를 꺼냈어요

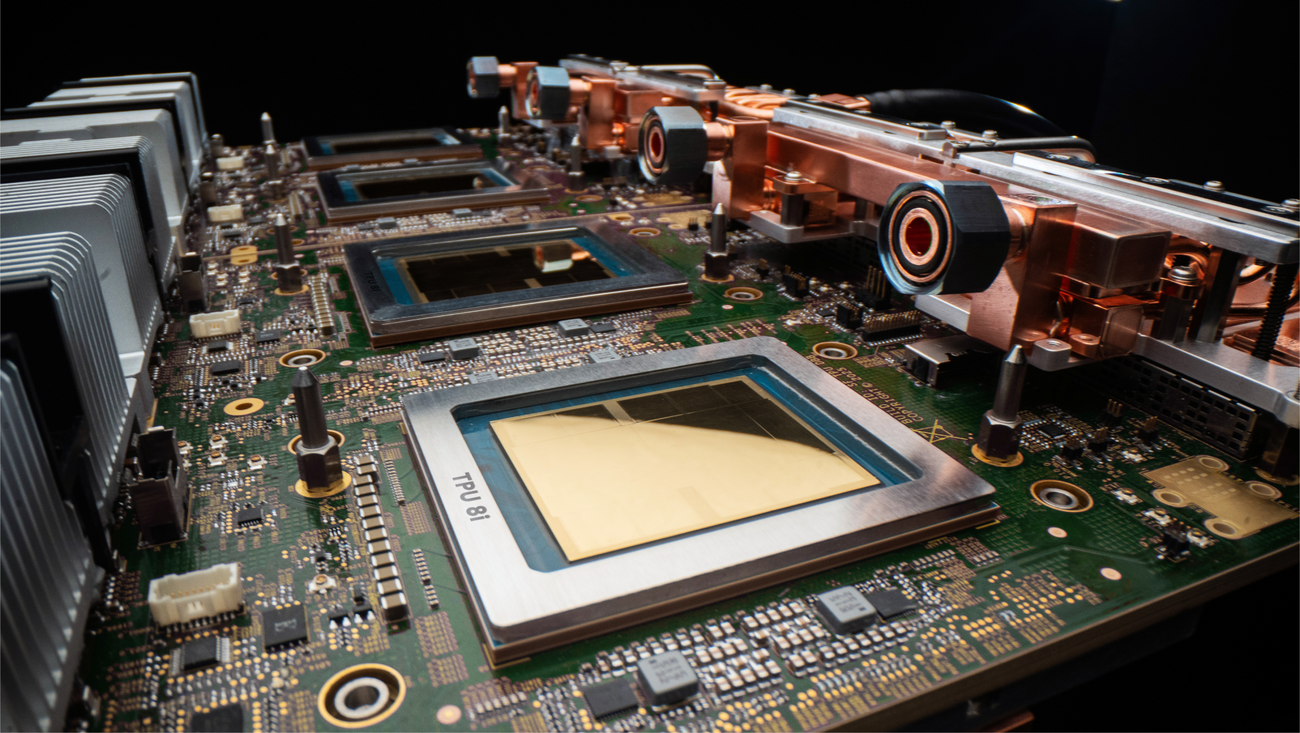

구글이 8세대 TPU를 공식 발표했어요. 이름은 Ironwood(아이언우드), 그리고 함께 등장한 Axion(액시온)이라는 Arm 기반 CPU까지, 두 칩을 한 세트로 묶어서 "에이전트(Agentic) 시대를 위한 인프라"라고 포지셔닝했어요. 지금 AI 업계의 가장 뜨거운 키워드가 에이전트, 즉 AI가 스스로 여러 단계를 계획하고 도구를 써서 일을 처리하는 방식이잖아요. 구글이 이걸 칩 레벨에서 받쳐주겠다는 선언이에요.

TPU가 뭐냐면, 구글이 직접 설계한 AI 전용 가속기예요. NVIDIA GPU가 그래픽용으로 시작해서 AI에 활용되는 범용 병렬 프로세서라면, TPU는 처음부터 행렬 연산과 신경망에 특화해서 만든 칩이에요. 2016년 1세대가 알파고 뒤에서 돌아간 이후로, 구글은 자기 데이터센터와 클라우드에서 TPU를 핵심 무기로 써왔죠.

Ironwood는 뭐가 달라졌나

이번 세대의 포인트는 세 가지예요. 첫째, 추론(inference) 성능에 초점을 맞췄어요. 예전 세대들이 학습과 추론을 같이 노렸다면, Ironwood는 대규모 모델을 실제로 서비스할 때의 지연 시간(latency)과 처리량(throughput)을 크게 끌어올렸다고 해요. 이전 세대 대비 성능이 몇 배 수준으로 뛰었고, 전력당 성능(perf/watt)도 크게 개선됐다는 수치가 나왔죠.

둘째, 메모리 용량과 대역폭이 대폭 늘었어요. 요즘 AI 모델들은 파라미터도 크지만 컨텍스트 길이가 수십만에서 수백만 토큰으로 늘고 있거든요. 이걸 처리하려면 칩에 붙은 HBM(고대역폭 메모리)이 얼마나 많고 빠른지가 핵심이에요. Ironwood는 여기에 집중적으로 투자한 흔적이 보여요.

셋째, Pod 단위 확장성이에요. TPU는 한 칩만 쓰는 게 아니라 수천 개를 광학 스위치로 묶어서 하나의 거대한 컴퓨터처럼 쓰거든요. 이걸 TPU Pod라고 부르는데, Ironwood는 한 Pod에 연결할 수 있는 칩 수와 칩 간 대역폭이 또 한 단계 올라갔어요. 덕분에 단일 작업으로 조 단위 파라미터 모델을 한 방에 돌릴 수 있죠.

거기에 Axion CPU가 함께 온 게 흥미로워요. AI 워크로드라고 해도 전처리, 데이터 파이프라인, 조율(orchestration) 같은 일반 CPU 일이 많거든요. Arm 기반 맞춤형 CPU로 이 부분을 효율적으로 처리해서, GPU/TPU를 더 놀리지 않고 꽉 채워 쓰겠다는 전략이에요. 아마존의 Graviton과 같은 방향이죠.

경쟁 구도 속에서 보기

이 발표를 제대로 이해하려면 지금 AI 칩 시장의 지형을 같이 봐야 해요. 현재 NVIDIA의 H100, H200, 그리고 새로 나온 Blackwell 시리즈(B100/B200)가 시장의 압도적 표준이에요. 모두가 NVIDIA 칩을 사려고 줄 서 있고, CUDA 생태계라는 거대한 해자도 있죠. 여기에 AMD의 MI300 시리즈가 쫓아가고 있고, Cerebras, Groq 같은 스타트업들이 추론 특화 칩으로 틈새를 공략하고 있어요.

구글의 전략은 좀 달라요. TPU를 외부에 팔지 않아요. 대신 구글 클라우드와 자사 서비스(검색, Gemini, YouTube 등)에만 쓰거든요. 그러니까 이건 NVIDIA 칩을 '대체'하는 상품이 아니라, 구글이 엔비디아에 대한 의존도를 낮추고 자사 AI 서비스의 원가를 통제하는 수직 계열화 전략이에요. Anthropic이 TPU를 대규모로 쓴다는 얘기도 나왔고, OpenAI도 일부 워크로드에 구글 인프라를 검토한다는 소식이 있었죠. NVIDIA 칩 공급난이 워낙 심하니까 대안을 찾는 거예요.

에이전트라는 키워드를 칩 마케팅에 붙인 것도 주목할 만해요. 에이전트 워크로드는 단일 추론이 아니라 짧은 호출을 여러 번 반복하고, 도구를 호출하고, 상태를 유지하는 패턴이거든요. 그래서 지연 시간과 오케스트레이션이 중요하고, TPU+Axion 조합이 이걸 노린다는 메시지죠.

한국 개발자에게 어떤 의미인가

한국에서 TPU를 직접 다룰 일은 구글 클라우드(GCP)를 쓰는 팀 정도일 텐데, 그래도 알아둘 가치는 충분해요. 첫째, JAX와 PyTorch/XLA 같은 프레임워크가 TPU를 지원하니까, 대규모 학습이나 추론을 할 때 GCP에서 TPU를 빌리면 GPU 대비 가성비가 좋은 경우가 많아요. 특히 Gemini 같은 모델을 파인튜닝하거나 대형 배치 추론을 돌릴 때요.

둘째, 추론 최적화의 흐름이 이제 업계 전체의 화두라는 점이에요. 모델 학습은 끝났고, 이제는 이걸 얼마나 싸고 빠르게 서빙하느냐의 게임이 시작됐어요. 한국에서도 네이버, 카카오, LG AI연구원이 각자 자체 모델을 서빙하고 있는데, vLLM, TensorRT-LLM, 양자화, KV 캐시 최적화 같은 주제가 실무에서 엄청 중요해졌거든요.

셋째, 칩과 소프트웨어 스택의 결합이라는 관점이에요. 구글은 하드웨어뿐 아니라 컴파일러(XLA), 프레임워크(JAX), 그리고 모델(Gemini)까지 수직으로 엮었죠. 한국의 사피온, 퓨리오사AI 같은 AI 반도체 회사들도 비슷한 통합을 고민하고 있는데, 구글의 사례가 좋은 참고가 돼요.

마무리

에이전트 시대의 인프라는 단일 칩이 아니라 CPU+가속기+네트워크+소프트웨어 스택 전체의 싸움이라는 게 이번 발표의 진짜 메시지예요. 여러분은 자사 AI 워크로드를 NVIDIA 외 다른 칩으로 옮겨볼 생각을 해보신 적 있나요? 아니면 CUDA 생태계의 해자가 너무 깊다고 느끼시나요?

🔗 출처: Hacker News

"비전공 직장인인데 반년 만에 수익 파이프라인을 여러 개 만들었습니다"

실제 수강생 후기- 비전공자도 6개월이면 첫 수익

- 20년 경력 개발자 직강

- 자동화 프로그램 + 소스코드 제공